패션쇼 사진을 이용한 런웨이 팔레트

무용수와 협업해 만든 리빙 아카이브

(AI타임스=박혜섭 기자) 구글이 최근 AI 알고리즘을 접목시켜 기존에 있던 앱을 새롭게 선보였다.

2011년 런칭한 구글 아츠&컬처(Google Arts&Culture) 앱 안에 패션분야 관련 런웨이 팔레트(Runway Pallette)와 무용분야 리빙 아카이브(Living Archive)를 개발한 것.

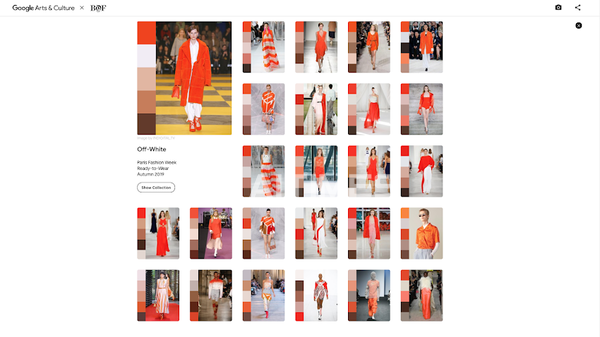

먼저 런웨이 팔레트를 만들기 위해 구글은 패션정보 매체 비즈니스 오브 패션(Business of Fashion, BOF)으로부터 약 140,000장의 패션쇼 사진을 제공 받았다. 그런 다음 AI 알고리즘을 이용, 사진을 1,000가지 이상의 스타일과 색상별로 나누어 하나의 거대 팔레트로 만들었다.

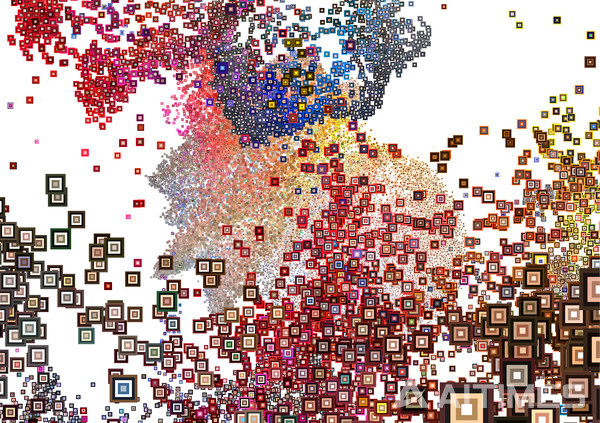

스마트폰 앱 혹은 인터넷 홈페이지로 접속하면 메인에 형형색색의 모자이크 그림이 나온다. 그림을 3D로 설정 할 수도 있고 확대하거나 축소도 가능하다. 아무 색상에 마우스를 대고 클릭하면 곧바로 AI가 분류해 놓은 대로 의상이 소개된다. 브랜드, 날짜, 패션쇼 장소 등의 정보도 볼 수 있다.

또한, 자신의 의상을 직접 찍어 업로드 하면 AI가 그 스타일에 매칭되는 패션쇼 사진을 제공한다.

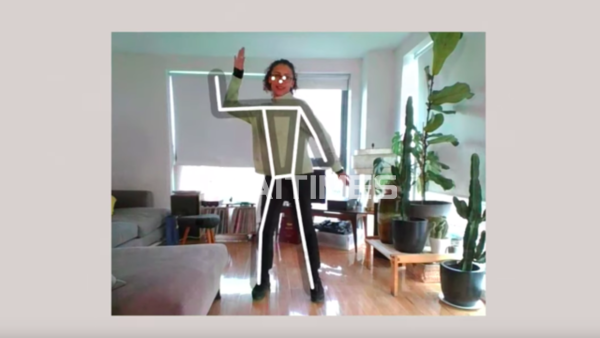

두번째 앱 리빙 아카이브는 영국출신의 세계적 현대무용가 웨인 맥그레거(Wayne McGregor)와 협업해 개발했다.

25년 경력의 맥그레거에게 영감을 얻은 구글은 AI를 활용해 그의 동작을 약 5십만개로 매핑해 나누었다. 그렇게 나눈 동작을 앱에 적용해 유저들이 게임을 하듯 동작을 따라할 수 있도록 재미를 더했다.

맥그레거는 “AI가 그동안 내가 춰 온 동작을 세분화 해 50만개로 나눈다는 것은 흥미로웠다”며 “이같은 첨단기술과의 작업으로 내가 해 온 것들이 묻히지 않는다는 점이 기쁘다”고 말했다.

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com