세계 100대 명문대 셰필드 대학 노엘 샤키 교수 가디언지와 인터뷰

현재 영국의 안면인식 프로그램은 백인 얼굴만 정확하게 구분 가능

신약 개발 때 제약 테스트와 같은 엄격한 기준을 AI 개발 때도 적용해야

(AI타임스=박혜섭 기자) 아일랜드 출신의 컴퓨터 과학자이자 셰필드 대학(University of Sheffield) AI 로봇공학부 노엘 샤키(Noel Sharkey) 교수가 최근 영국 가디언지와의 인터뷰에서 “영국의 AI 활용법은 인종차별주의적”이므로 “즉시 중단하고 새로 알고리즘을 구축해야 한다”고 주장했다.

인공지능 분야 개척자라고 불리는 한편 ‘킬러로봇(Killer Robot)’이라는 로봇 확산 반대 글로벌 단체에서 리더급 인사로 활약하고 있는 샤키 교수는 “지금까지 개발된 AI 알고리즘은 인간들을 상대로 편견만 더 부추겼다”고 평가했다.

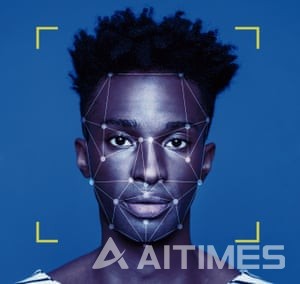

특히 영국의 안면인식 프로그램을 예로 들며 현재 AI 산업과 그를 기반으로 한 알고리즘에 대해 비판한 그는 AI 시대가 또다른 인종차별을 조장할 수 있다고 경고했다. 샤키 교수는 본인이 직접 연구실에서 실험을 한 결과 현재 개발되어 쓰이고 있는 안면인식 프로그램 대부분이 사람의 피부색이 어두울수록 정확하게 대상을 확인하지 못하는 것을 알게 됐다고 한다. “우리가 많은 연구를 통해 밝혀낸 것은 백인의 경우 수염을 길렀거나 안경을 썼다 해도 약 98% 적중률을 나타냈지만 피부색이 짙은 흑인이나 중동아시아인은 인식을 못하는 경우가 허다했다”고 샤키 교수는 덧붙였다.

이어 이같은 “오류 투성이” 프로그램이 서양국가 자본의 힘으로 전쟁에 쓰인다면 엄청난 무고한 희생의 원인이 될 것이라고 강한 우려를 내비쳤다. “알 카에다 같은 중동지역을 공격할 때 빠르고 정밀하단 생각에 이 결함뿐인 프로그램을 도입한다면 어떻게 되겠나”라고 반문한 샤키 교수는 “현재 군사 분야에서 지나치게 빠른 속도로 AI를 도입하려 하지만 그 전에 충분한 실험과 다양하고 상세한 알고리즘이 만들어져야 한다”고 말했다.

샤키 교수는 구글과 마이크로소프트 등 세계 최대 컴퓨팅 기업들과 이같은 AI 알고리즘의 선천적인 문제에 대해 함께 토론을 했다고 말했다. 그들 역시 문제의 심각성을 알고 몇 년간 해결책을 모색하고 있지만 실질적인 방법은 발견하지 못한 상황이다.

그렇다면 샤키 교수가 제안하는 솔루션은 무엇일까? 샤키 교수는 “적어도 세계 최대 기업들이 개선방법을 개발하기 전까지 제가 보고 싶은 건 ‘대규모 제약 테스트 형식’”이라고 말했다. “사람이 소비 할 신약 개발과 동일한 엄격한 테스트를 AI 알고리즘 개발에도 적용시켜야 한다”는 것이다.

한편 이 인터뷰가 공개 된 후부터 샤키 교수는 본인 SNS를 통해 여러분야의 사람들과 설전을 벌이는 중이다. 인류사회에서 항상 예민한 인종차별 문제와 더불어 AI가 또다른 편견을 조장할 수도 있다는 그의 주장은 지나치기 어렵기 때문에 많은 사람들이 질문을 던지고 있다. 샤키 교수는 “내가 바라는 세상은 첨단 산업기술의 발전과 함께 인간 고유의 원칙과 윤리가 바탕이 밑거름으로 받쳐주는 형태”라며 “나의 주장은 오랜 연구와 지식의 결과”라고 항변했다.

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com