연주자 몸짓 분석해 악기 소리 식별‧분리하는 AI 툴 개발

연주회에 가면 귀뿐만 아니라 눈도 즐겁다. 간혹 귀로 구분할 수 없는 악기 소리를 연주자의 움직임으로 알아낼 때도 있지만 끝내 어떤 악기에서 나는 소리인지 알기 어려울 때가 많다. 이제 인공지능(AI)이 연주자들의 몸짓을 통해 각 악기의 소리를 구별해줄 수 있게 됐다.

MIT-IBM 왓슨 AI 연구소(MIT-IBM Watson AI Lab) 연구진이 연주자들의 몸짓 언어를 분석해 개별 악기의 소리를 식별‧분리할 수 있는 인공지능(AI) 툴을 개발했다고 매사추세츠공과대학교(MIT)가 25일(현지시간) 밝혔다.

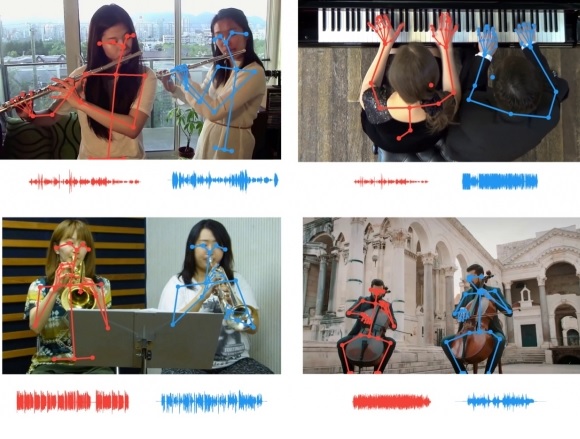

이 AI 툴은 컴퓨터의 가상 눈과 가상 귀로 인간도 구별해내기 힘든 비슷한 소리를 식별해낸다. 각 연주자의 주요한 신체 골격 지점을 통해 연주자의 움직임을 개별 파트 템포에 맞추면서 AI의 청취‧식별 성능을 개선, 여러 악기들 가운데 각 악기 소리를 분리할 수 있도록 했다.

AI 시스템은 다중 감지 방식을 이용할 경우 더 적은 데이터로 더 빨리 학습할 수 있다. 이번 연구의 공동저자인 안토니오 토랄바 MIT 교수는 마치 인간이 모든 감각을 통해 배우는 것처럼 ”다중감각 처리는 보다 복잡한 업무를 수행할 수 있는 AI 시스템을 구현하기 위해 필요하다“고 설명한다.

이번 연구 성과는 여러 작업 영역에서 적용될 수 있을 것으로 보인다. 사운드 믹싱을 하거나 녹음에서 악기의 볼륨 조절하는 일부터 화상회의 시 소통을 원활하게 하는 일까지. 더 나아가 연구진은 이 같은 오디오-비디오 데이터로 훈련된 딥러닝 모델 기반 기술이 다양한 분야로 확대되길 기대하고 있다.

해당 연구는 이번 달 가상으로 열린 국제 컴퓨터 비전 및 패턴 인식 학회(CVPR)에서 소개됐다.

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com