페이스북·텍사스대·카네기멜론대 공동 연구

FB 오픈 플랫폼 AI해비탯에서 시뮬레이션

물소리·전자레인지 소리로 욕실·주방 위치 파악

페이스북과 미 텍사스 오스틴대, 카네기멜론대학 연구진이 시각과 오디오만으로 평면도를 재구성하는 AI기술을 연구 중이다.

7일(현지시간) 벤처비트에 따르면 3D 센서와 카메라로 전체 공간을 촬영해야 하는 기존 프로세스를 좀더 간편하고 효율적으로 만드는 기술이다. 짧은 비디오 클립만 있으면 촬영하지 않고도 AI를 활용해 평면도를 만들 날이 머지않은 듯하다.

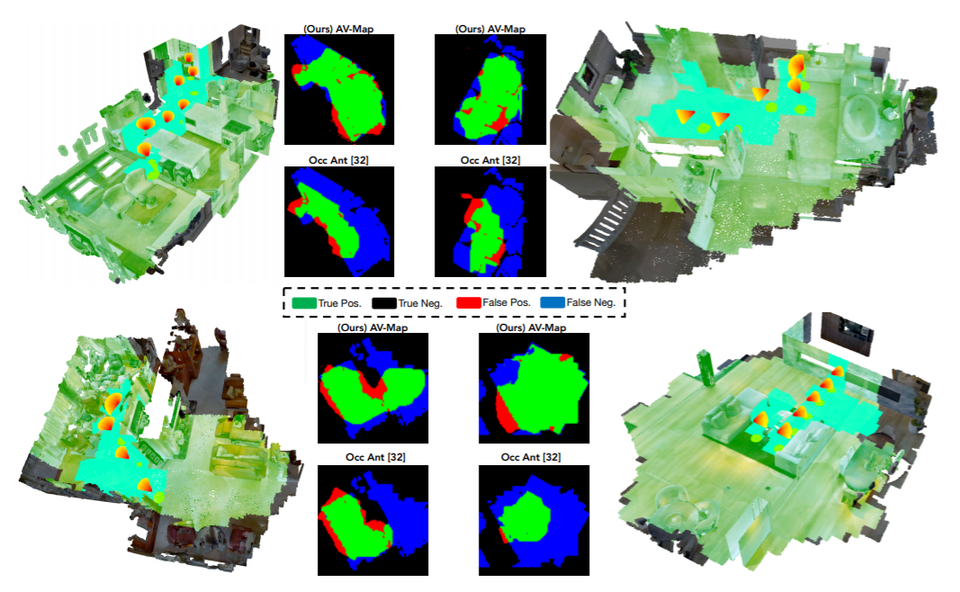

합동 연구팀은 이 방법을 AV-맵이라고 이름 지었다. AV-맵은 오디오가 들어있는 짧은 비디오를 2차원 평면도로 변환한다. 이를 위해 필요한 머신러닝 모델은 소리와 시각적 데이터 시퀀스를 활용해 평면도 구조를 파악한다. 이후 디코딩 구성요소를 사용해 소리와 시각적 데이터 정보를 융합한다. AV-맵이 생성하는 평면도는 일반적으로 비디오에서 직접 관찰할 수 있는 영역보다 더 넓게 포착해 공간을 보여줄 수 있다.

연구팀은 AV-맵 기능을 시험하기 위해 페이스북의 AI해비탯을 이용했다. AI해비탯은 AI 기반 시청각 시뮬레이션 플랫폼이다. 팀은 가상 카메라를 사용해 소리를 내보냈고, 다음으로 모델하우스 안에 물건이나 사람이 내는 자연발생적 소리에 집중했다.

실험 결과 연구팀은 AV-맵이 AI해비탯 내 85개 멀티룸 환경에서 기존 맵핑을 능가하는 것을 발견했다. 화면에 실제로 표시돼 사용자 눈에 보이는 가시영역도 더 넓었다. AV-맵은 전체 공간 면적 가운데 26%에 대한 시각적 이미지만으로 전체 공간을 알아서 측정했다. 단 몇 개의 보기(example)만으로 전체 면적을 66%의 정확도로 추정했다.

AV-맵은 영상 속 샤워소리를 듣고 욕실 방향을 나타낸다. 전자레인지 신호음을 통해 주방 위치를 파악하는 등 물체가 내는 소리에 집중해 움직인다. 여러 방에서 동시에 내는 소리도 레이아웃을 다르게 노출시켜 각 방이 어디쯤 있는지 집어내 그릴 수 있다.

AV-맵에 대해 기술한 논문에서 연구팀은 “소리만으로 숨겨진 영역의 기하학적 특성을 파악하고 평면을 유추하는 데 탁월한 기능을 자랑한다”고 강조했다. 또 “향후에도 평면도가 필요한 로봇 제조업체와의 협업 등 AV-맵을 필요로 하는 기업과 연계해 상용화에 앞장서겠다”고 덧붙였다.

AI타임스 박혜섭 기자 phs@aitimes.com

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com