자연어 공공데이터 구축 시급...국립국어원 말뭉치 중단에 큰 곤란

AI 윤리 문제 일으킨 기업에 법적 처벌도 방법...매출과 맞먹을 요인

정부 내 AI 윤리 전담 컨트롤타워로 중복 규제 혼선 막아야

정부 차원에서 가장 서둘러야할 일은 ▲자연어처리(NLP) 연구를 위한 공공데이터 구축이라는 것이 전문가들의 주장이다. ▲윤리 문제 발생 시 사업에 불이익을 줄 수 있는 법적 처벌책과 ▲정부 내 AI 윤리를 전담하는 컨트롤타워가 필요하다는 의견도 나왔다.

한국인공지능법학회와 서울대 인공지능정책 이니셔티브는 4일 ‘이루다 사건으로 본 인공지능 거버넌스: AI의 일탈을 어떻게 막을 것인가?’라는 제목의 온라인 토론회를 열었다.

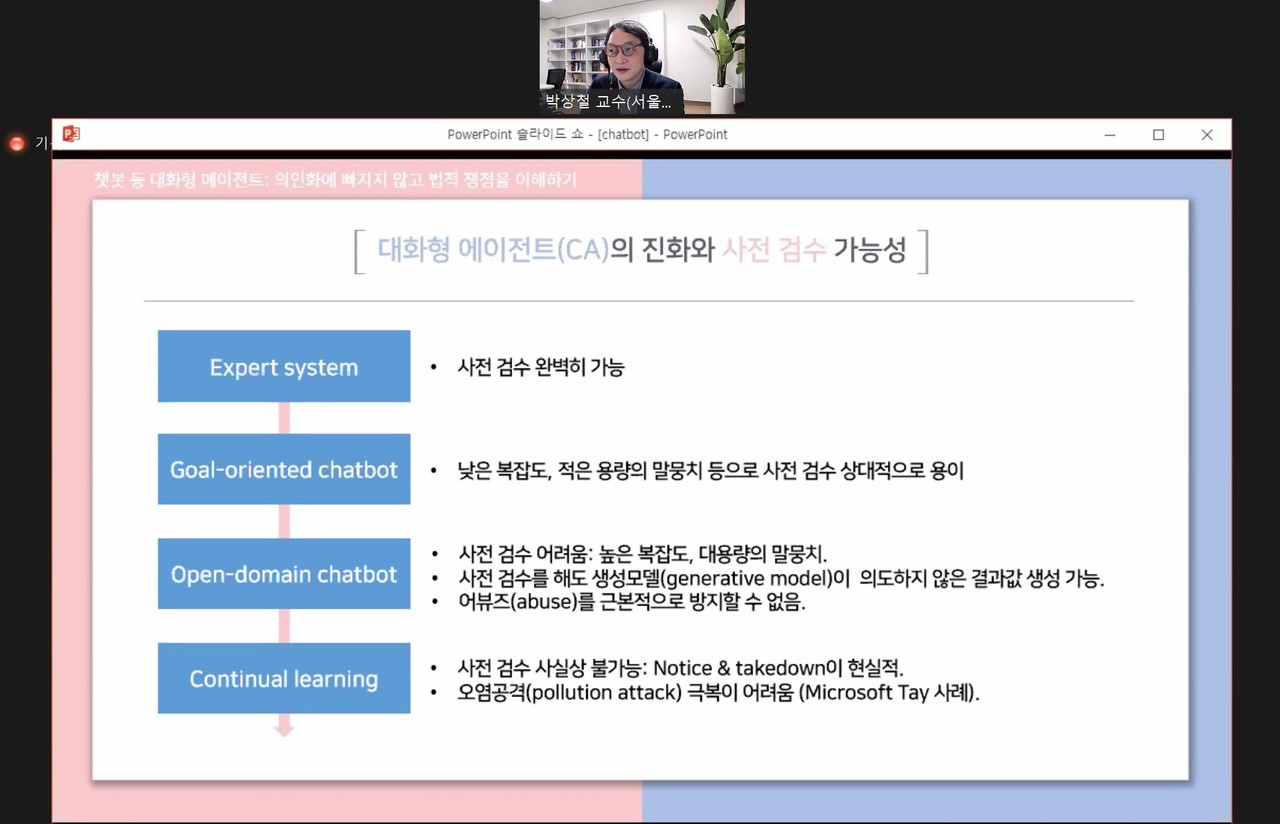

이날 행사에서는 고학수 서울대 법학전문대학원 교수가 사회를 맡고 이준환 서울대 언론정보학과 교수, 박상철 서울대 법학전문대학원 교수, 한애라 성균관대 법학전문대학원 교수가 발표했다.

대기업 내 AI 윤리 방침을 소개하기 위해 정교화 한국마이크로소프트 대표변호사가, 국내 스타트업 입장을 전하는 데는 정미나 코리아스타트업포럼 정책실장이 참여했다. 김경만 과기정통부 인공지능기반정책과장도 참석해 정부 입장을 밝혔다.

①공공데이터 마련, 가장 시급한 정부 과제

AI 챗봇 윤리를 위해 가장 시급한 정부 대책으로는 자연어 데이터 구축 사업을 꼽았다. 스타트업이 사용할 수 있는 양질의 데이터가 부족하다보니 무리해서 AI 학습 데이터를 수집했다는 것이다.

박상철 서울대 법학전문대학원 교수는 “AI 윤리에 대해 정부가 할 일이 많은데 가장 중요한 것은 양질의 구어 말뭉치를 구축하는 것이다. 결국 이루다 사태와 같은 일이 일어난 근본 원인은 쓸만한 말뭉치가 없어서다”라고 비판했다.

더불어 “최근 국립국어원 말뭉치 서비스가 중단됐는데 개선이 아닌 올스탑이 필요한가 의문이다. 당장 교수들도 연구에 국립국어원 말뭉치가 필요한데 대안이 없다”고 강조했다.

정미나 코리아스타트업포럼 정책실장도 “공공 말뭉치에 들어간 비용이 대략 3000억원 정도로 예상된다. 이런 것 없이는 스타트업은 서비스를 전혀 진행할 수가 없다. 정부 공공 차원에서 질과 양을 모두 고려해 데이터를 잘 제공해줘야 한다. 국회자료와 같이 가공할 수 없는 형태의 공공데이터를 활용할 수 있게 해주는 시스템이 갖춰지면 좋겠다”고 전했다.

②형사 처벌 등 AI 윤리 문제에 강력 처벌도 고려해야

윤리적 문제를 일으킨 AI에 강력한 법적 제재를 요구하는 목소리도 등장했다. 기업이 상업성 이외 처벌 가능성을 의식해 잘 팔리는 AI와 윤리적인 AI를 함께 고려할 수 있도록 강력한 대책이 필요하다는 것이다.

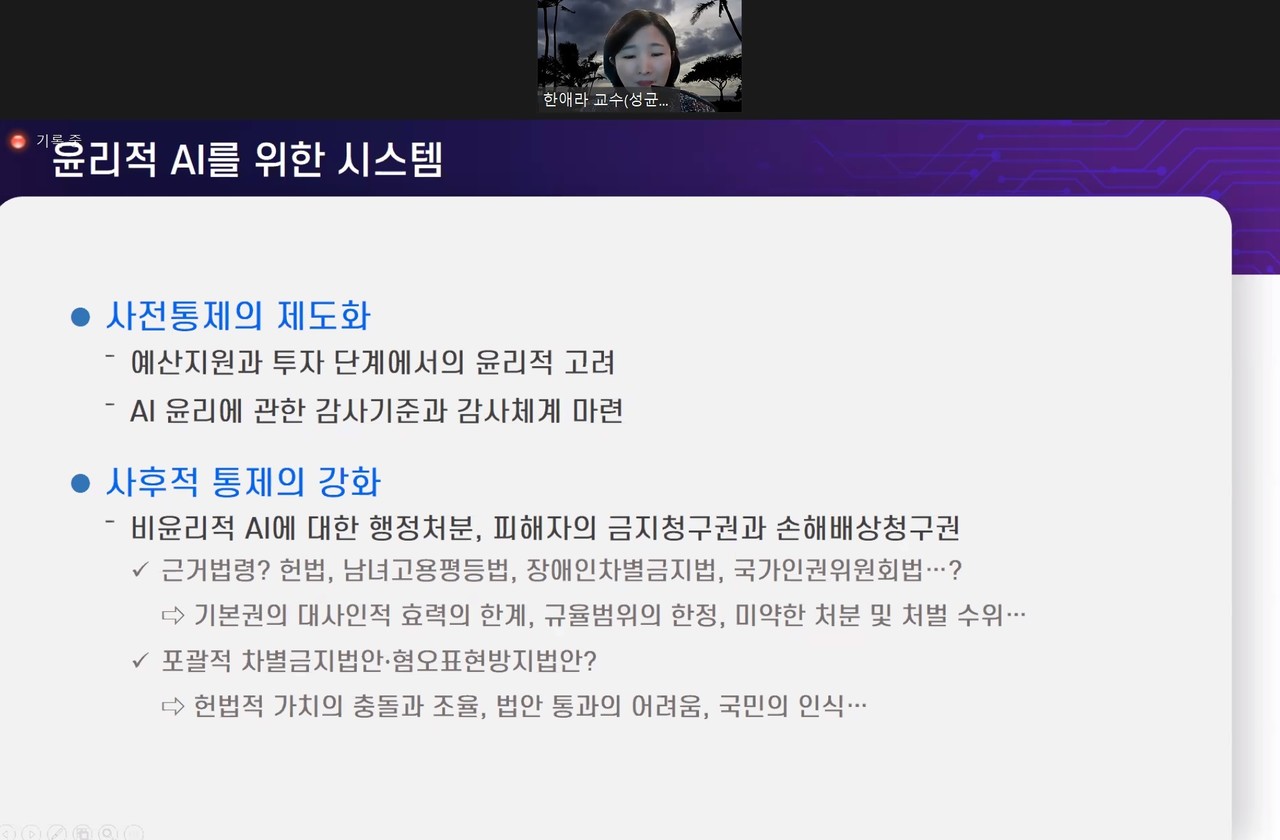

한애라 성균관대 법학전문대학원 교수는 “AI 개발 현장에서 윤리적 문제 제기가 나오더라도 사업성과 대비해 윤리는 희생될 가능성이 높다. 특히 매출에 대한 압력이 높은 중소기업은 윤리문제를 의식하고 있더라도 위험을 안고 실행하자는 결정을 할 수 있다”고 말했다.

그는 “자율검증, 인식제고 다 좋지만 결국 상업적으로 불이익을 당할 수 있는 제도를 만들어야 즉각 반영된다. 법적 처벌책이 필요한 것”이라고 강조했다.

③전담 컨트롤타워 필요...중복 규제 혼선 막아야

AI 윤리 사안이 중요한 만큼 전담 컨트롤타워가 필요하다는 제안도 나왔다. 관련 부처에서 각자 규제책을 제시하면 기업 입장에서는 제대로 판단하고 따르기 어렵다는 것이다.

정교화 변호사는 “관련된 부처가 많은데 담당자들이 각자 규제를 쏟아내면 혼란스럽다. 정부 내 하나의 컨트롤타워를 만들어 관련 현장의 다양한 의견을 듣고 판단해 일관된 메시지를 줘야 한다”고 말했다.

이에 대해 김경만 과기정통부 인공지능기반정책과장은 “규제와 진흥을 병행하더라도 우리는 진흥에 무게를 두고 싶다. 개보위, 방통위와 우리가 다른 점이다. 컨트롤타워가 없어 이중 규제를 받도록 하는 일 없게 하겠다”고 밝혔다.

그러면서 “큰 기업은 자체 윤리 규정이 많은데 문제는 중소기업이다. 중소기업, 스타트업은 하고 싶어도 능력이나 자금이 없다. 이들 대상으로 데이터 사용과 알고리즘 개발에서의 윤리 사항 체크리스트를 만들겠다”고 전했다.

AI타임스 박성은 기자 sage@aitimes.com

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com

http://blog.daum.net/macmaca/3154