AI 알고리즘에 최적화된 고속 데이터 전송 구조 설계가 필수...그 결과로 NPU 개발

가격과 크기, 전력 효율 필요로 하는 엣지나 게이트웨이에 주로 채택

엔비디아 추론용 AI 가속기 젯슨 자비에, 성능 우수하나 크기, 비용면 큰 단점

인텔 하바나랩스, 화웨이 외 하일로, 로직스 등 스타트업도 뛰어들어

[편집자주]인공지능(AI) 기술의 중심은 소프트웨어(SW) 기술이라고 하지만, 복잡한 AI SW를 구현하기 위해서는 높은 성능의 하드웨어(HW)가 필수적이다.

80년대에도 AI가 활발히 연구됐지만 실제 구현은 불과 몇 년밖에 안됐다. 컴퓨팅 성능이 그만큼 받쳐주지 못했기 때문이다.

HPC(고성능컴퓨팅), AI 가속기, AI 프로세서, 고성능 메모리장치 등이 등장하면서 본격적인 AI 시대가 문을 열게 된 것.

칩러닝(ChipLearning)을 통해 AI를 구현하는 HW, 반도체 또는 '칩'이라고 불리는 HW 산업과 기술을 알아보자.

지금 개발된 고도화된 AI 기술 구현에는 GPU(그래픽처리장치)의 공이 컸다.

GPU의 원래 목적은 컴퓨터 그래픽 처리다. AI용으로 GPU를 쓰는 이유는 그래픽 처리와 AI 연산이 비슷한 방법으로 이뤄지기 때문이다.(관련기사 = [AI칩러닝] AI의 핵심, GPU… 딥러닝의 유행을 불러오다 ①)

다만 전문가들은 GPU의 원래 목적이 AI 연산은 아니기 때문에 비용이나 전력소모 등 비효율적인 부분이 발생한다고 지적한다.

이를 극복하기 위해 최근에는 FPGA를 사용하거나 NPU, TPU 등 새로운 프로세서를 개발해 사용하고 있다. 일부에서는 뉴로모픽(neuromorphic), 양자 컴퓨터 등 차세대 기술을 개발하는 중이다.

(이 기사는 [칩러닝] GPU를 대신할 새로운 AI 반도체는? ① FPGA에서 이어집니다.)

◇ 인공지능 '전용' 프로세서 필요해…NPU 등장의 이유

GPU와 FPGA의 단점은 가격이다. AI를 처리하기에 적합한 성능을 지녔지만 필요 없는 성능을 포함해 비싸고, 비효율적이다. AI 처리만을 위한 프로세서 개발이 필요하다는 것.

한국전자통신연구원(ETRI)은 지난해 발표한 '인공지능 프로세서 기술 동향'에서 "다양한 응용에 적용할 수 있도록 일반화된 구조를 가지는 GPU는 AI 알고리즘 처리에 필요하지 않은 블록이나 데이터 패스를 포함하고 있다"며 "성능개선의 여지가 있고 전력 면에서도 불필요한 소모가 있다"고 지적했다.

이어 "AI 알고리즘은 연산 과정에서 필수적인, 대량의 데이터 전송에 드는 시간이 전체 동작 성능을 좌우한다"며 "AI 알고리즘에 최적화된 고속 데이터 전송 구조 설계가 필수적"이라고 덧붙였다.

그 결과 나온 것이 바로 NPU(Neural Processing Unit, 신경망처리장치)다. 인공신경망(Neural Network)을 이용해 AI 연산을 더 효율적으로 수행하기 위한 목적에서 만들어졌다.

NPU는 AI 연산만을 위한 목적이기 때문에 GPU보다 범용성이 적다.

엔비디아 GPU는 자사의 쿠다(CUDA)를 이용해 자유롭게 활용할 수 있으며, 다른 GPU도 다른 API를 통해 AI 알고리즘을 개발할 수 있게 지원한다.

NPU는 구조상 다른 AI 알고리즘을 습득하기 어렵다. AI 알고리즘의 딥러닝 네트워크를 구성하는 신경망을 하드웨어로 구현했기 때문이다. 구조가 다른 알고리즘을 구현할 때 오히려 더 큰 시간과 비용이 들 수 있다.

다만 원래 용도에서 NPU는 GPU 대비 높은 효율을 보인다. 또한 ASIC(주문형반도체)의 장점인 대량생산을 통한 '가격 경쟁력' 확보가 뛰어나다.

이에 대규모 데이터센터보다 가격과 크기, 전력 효율을 필요로 하는 엣지(Edge)나 게이트웨이(Gateway)에서 NPU를 주로 채택하고 있다.

대부분 NPU는 스마트폰에 쓰인다. 영상·이미지·음성 인식 등 AI 기반 기술이 스마트폰에 필수적으로 쓰이면서, 이를 처리하기 위한 전용 프로세서를 개발·도입한 것.

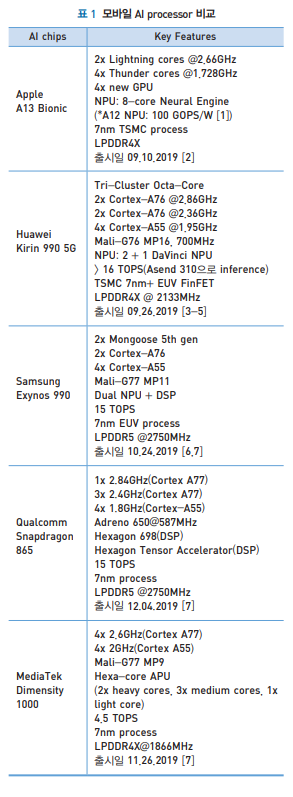

이에 주로 모바일 NPU는 스마트폰 AP(애플리케이션 프로세서) 기업들이 개발한다. AP 프로세서 IP를 다수 보유한 Arm을 비롯해, 삼성전자, 애플, 퀄컴, 화웨이 등이 대표적이다.

올해 삼성전자는 엑시노스2100 AP를 발표하며 3개의 차세대 NPU 코어와 불필요한 연산을 배제하는 가속기능 설계 등을 통해 26TF(1TF=초당 1조번 연산) 이상의 AI 성능을 확보했다고 밝혔다.

퀄컴도 지난해 말 스냅드래곤 888을 발표하며 AI 연산 속도도 26TF를 달성했다. 그에 앞서 지난해 9월 A14 바이오닉을 공개한 애플은 11TF 연산의 16코어 뉴럴엔진을 개발했다고 밝힌 바 있다.

이밖에 화웨이 자회사 하이실리콘은 기린(Kirin)에 자사의 다빈치(DaVinci)코어를 개발하고, 중저가 시장에서 전 세계에서 가장 많은 AP를 제공하는 미디어텍도 자체 NPU를 개발하고 있다.

모바일 외에도 음성이나 영상인식은 스마트공장, 스마트빌딩, 스마트시티 등 다양한 곳에서 사용된다. 그 영역이 다른 만큼 필요한 성능도 다르다. 모바일보다 칩의 크기, 전력 효율, 비용 등 각각 조건마다 여유로울 수 있다는 것.

대표적인 엔비디아 추론용 AI 가속기 젯슨 자비에는 성능은 우수하지만 크기, 비용에서는 큰 단점을 보이고 있어, AI 가속기 개발 업체들은 틈새 시장을 노리고 있다.

인텔 하바나랩스(Habana Labs), 화웨이 등이 관련 NPU 시장에 뛰어들었으며, 스타트업들로는 이스라엘 하일로(Hailo), 미국 플렉스 로직스(Flex Logix), 그로크(Groq)데이터센터 등 대규모 딥러닝에서도 NPU가 쓰이고 있다.

구글이 서버용으로 개발한 TPU(Tensor Processing Units)도 일종의 NPU라고 할 수 있으며, 한국의 퓨리오사AI(대표 백준호)도 서버에 사용될 고성능 추론 NPU 개발을 진행 중이다.

AI타임스 양대규 기자 yangdae@aitimes.com

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com