윤리분과·기술분과·교육분과 등 3개 위원회로 구성

고학수 서울대 법학전문대학원 교수, 위원장 임명

전 국민 대상 AI 윤리 교육 위한 콘텐츠 개발 나서

AI 발전 양상·국제 동향 고려한 윤리과제 발굴 예정

정부가 인공지능(AI)의 윤리적 개발과 활용을 촉진하기 위해 나섰다. 과학기술정보통신부는 정보통신정책연구원(KISDI), 한국정보통신기술협회(TTA)와 24일 '제1기 인공지능 윤리 정책 포럼'을 출범시켰다. 포럼은 전 국민 대상 AI 윤리 교육과 윤리 정책의 방향 등을 제시해나갈 계획이다.

AI 윤리는 'AI 관련 이해관계자들이 준수해야 할 사회 규범'으로 정의할 수 있다. AI 기술개발 과정에서 사람의 프라이버시를 침해하거나 AI가 잘못된 판단으로 편견과 차별을 조장하는 등 사회적 규범에 반하는 결과를 도출하지 않기 위한 조치다.

과기정통부가 주도한 이 포럼은 AI 윤리 향상을 위해 전 국민 윤리 교육을 위한 콘텐츠를 개발한다. AI 기술발전 양상, 국제 동향, 실제 사례 등을 고려한 신규 윤리 과제를 발굴해 국내 AI 윤리 정책 방향도 제시할 예정이다. 우선 지난해 11월 '인공지능 신뢰성 제고를 위한 세미나'에서 논의한 '인공지능 윤리 자율점검표' 및 '신뢰할 수 있는 인공지능 개발안내서'를 공개한다.

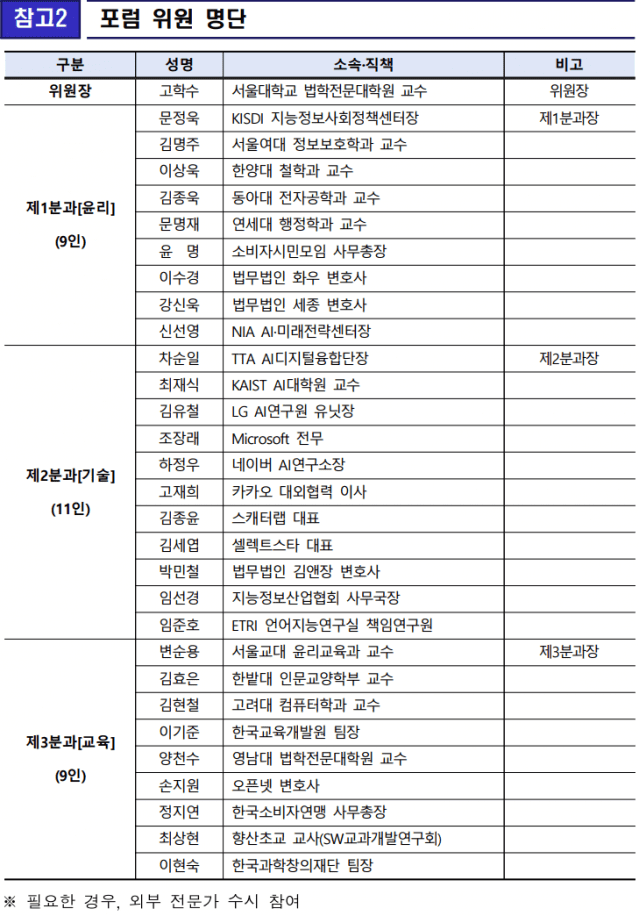

포럼 위원장은 고학수 서울대 법학전문대학원 교수가 맡는다. 또 AI, 철학, 교육, 법, 공공 등 분야별 전문가와 시민사회 전문가 등 30명이 포럼 위원으로 활동할 예정이다. 포럼은 운영 효율성과 논의 전문성을 높이기 위해 3개의 전문분과위원회로 구성된다. ▲인공지능 윤리체계 확산(윤리분과) ▲인공지능 신뢰성 확보 기술 기반 마련(기술분과) ▲인공지능 리터러시 및 윤리 교육 강화(교육분과) 등이다.

윤리분과는 '인공지능 윤리 자율점검표'에 대한 의견수렴, 현장 적용 등을 통해 AI 윤리 발전 방향을 모색한다. 고위험 인공지능 기준 정립, UNESCO 인공지능 윤리 권고 등 국내외 동향을 고려한 AI 윤리 과제를 다룰 예정이다.

기술분과는 AI 개발 과정에서 참고할 수 있는 기술적 요구사항·검증 항목을 담은 '인공지능 개발안내서'를 중심으로 AI 신뢰성 확보를 위한 정책적·기술적 지원 방안을 논의한다. 현장의 목소리를 반영해 개발안내서의 개정안을 마련할 방침이다. 업체 또는 서비스별로 맞춤형 개발안내서를 마련하고 컨설팅을 제공하는 등 활용 방안도 모색한다.

교육분과는 AI 윤리 교육 현황을 공유하고 초·중·고교생 및 일반 시민 대상의 인공지능 윤리 교육 콘텐츠 개발에 나선다. 지난해 마련한 '인공지능 윤리 교육 콘텐츠 개발 기준'을 기반으로 대상별 특성에 맞추어 실제 현장에서 활용 가능한 교재를 개발·보급할 방침이다.

박윤규 과기정통부 정보통신정책실장은 "AI 강국 실현을 위해서는 AI 개발부터 활용까지 전 단계에서 사회적 신뢰를 확보하는 것이 선행돼야 한다"며 "인공지능 윤리 정책 포럼이 AI의 윤리적인 개발·활용에 대한 국민 인식을 제고하고 이해관계자들의 의견을 수렴해 사회적 합의를 마련하는 데 중추적 역할을 수행해 주기를 바란다"고 당부했다.

AI타임스 김동원 기자 goodtuna@aitimes.com

[관련기사][단독인터뷰] 팀닛 게브루 박사가 한국에 던진 질문 "한국 빅테크 기업 개발자는 자신의 소신을 밝힐 수 있는가"

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com