9월 1일부터 적용...서비스 제공어버체 BM 변화 불가피

오픈소스 늘어나 경쟁 격화된 것이 배경...세부 조정한 GPT-3 모델은 제외

인공지능(AI) 업체 오픈AI(OpenAI)가 거대언어모델)LLM) 서비스인 GPT-3 API(운영체제와 운영프로그램 사이의 통신에 사용되는 언어나 메시지 형식) 가격을 크게 낮췄다.

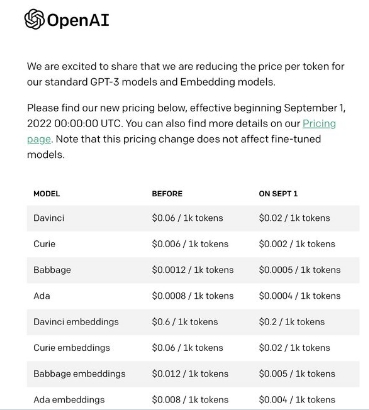

벤처비트는 31일 OpenAI가 다음달 1일부터 GPT-3 API 서비스의 가격을 3분의 2까지 인하하기로 했다고 보도했다.

이번 가격인하 조치로 서비스 제공업체들의 비즈니스 모델에 변화가 불가피할 것으로 예상된다. OpenAI API의 새로운 가격 책정은 이 시장에 변화가 일고 있다는 사실을 보여준다.

2017년에 도입된 트랜스포머 아키텍처는 현재의 대형 언어 모델을 위한 길을 열었다고 할 수 있다. 트랜스포머는 텍스트와 같은 순차적 데이터를 처리하는 데 적합하고, 이전의 프로세스보다 훨씬 효율적이다. 연구진은 대형 데이터세트 학습을 통해 트랜스포머가 더 강력하고 정확해지고 있다는 것을 입증해 왔다.

2020년 OpenAI 연구원들이 GPT-3를 선보이면서 LLM의 분수령이 됐다. GPT-3는 LLM이 기본적으로 추가 학습을 거치지 않고 즉석에서 몇 가지 예를 제시해 새로운 작업을 수행할 수 있다는 것을 보여줬다. OpenAI는 GPT-3를 오픈 소스 모델로 제공하는 대신, 연구 자금을 조달하기 위해 상용 API를 출시하기로 했다.

GPT-3는 LLM 응용 프로그램에 대한 관심을 높였다. 많은 기업과 신생 기업에서 GPT-3로 새로운 애플리케이션을 만들거나 기존 제품에 LLM을 통합하기 시작했다. GPT-3의 성공으로 다른 기업들도 자체적인 LLM 연구 프로젝트를 시작했다. 구글, 메타, 엔비디아 및 기타 대형 회사들이 LLM에 대한 개발 작업을 가속화했다.

현재 메타의 OPT-175B, 딥마인드의 친칠라(Chinchilla), 구글의 팜(PaLM) 및 엔비디아의 메가트론(Megatron) MT-NLG를 포함해 규모 또는 벤치마크 성능 면에서 GPT-3에 대등하거나 앞서는 LLM이 다수 등장했다.

GPT-3는 더 많은 사용자가 LLM을 이용할 수 있도록 하는 여러 오픈 소스 프로젝트 출시를 촉발시켰다.

빅사이언스(BigScience)의 블룸(Bloom)과 엘루테르AI(EleutherAI)의 GPT-J는 무료로 제공되는 오픈 소스 LLM이다.

OpenAI는 더 이상 LLM API 서비스를 제공하는 유일한 회사가 아니다. 허깅페이스(Hugging Face), 코헤어(Cohere), 휴먼루프(Humanloop)도 있다. 허깅페이스는 다운로드 가능한 오픈 소스 모델이나 API 호출을 통해 다양한 트랜스포머를 제공한다. 허깅페이스는 최근 MS 애저(Azure) 기반의 새로운 LLM 서비스를 선보였고, OpenAI는 GPT-3 API에도 이 서비스를 사용하고 있다.

LLM에 대한 관심이 높아지고 솔루션이 다양해지면서 API 서비스 제공업체들은 수익 마진을 줄여 시장을 보호하고 확장해야 한다는 압박을 받고 있다.

OpenAI를 비롯한 여러 기업들이 LLM에 API 액세스를 제공하기로 결정한 이유 중 하나는 모델을 학습시키고 실행하는 데 따르는 기술적인 문제다. 이는 많은 조직이 해결할 수 없는 과제다. 작은 머신 러닝 모델은 단일 GPU에서 실행할 수 있지만 LLM에는 수십 또는 수백 개의 GPU가 필요하다.

막대한 하드웨어 비용 외에도 LLM을 관리하려면 복잡한 분산 및 병렬 컴퓨팅에 대한 경험이 필요하다. 엔지니어는 모델을 여러 파트로 분할하고 여러 GPU에 분배해야 한다. 그러면 GPU가 병렬 및 시퀀스로 계산을 실행한다. 이 프로세스는 오류가 발생하기 쉽고, 다양한 모델 유형에 대한 즉석 솔루션을 필요로 한다.

그러나 LLM이 상업적으로 매력적으로 성장하면서 대형 신경망을 위한 특수 하드웨어를 제작해야 하는 필요성이 늘어나고 있다. OpenAI의 가격 페이지에 따르면 이 회사는 모델을 보다 효율적으로 실행하는 데 진전을 보이고 있다.

이전에는 OpenAI와 MS가 협력해 대규모 신경망을 위한 슈퍼컴퓨터를 제작했다. OpenAI의 새로운 발표는 연구소와 MS가 더 나은 AI 하드웨어 개발과 대규모 LLM 실행 비용 절감을 위해 더 많은 진전을 이룬 것을 시사한다.

OpenAI는 이 분야에서 경쟁에 직면해 있다. 예를 들어 세레브라(Cerebras)는 GPU 클러스터의 기술적 어려움 없이 적은 비용으로 수십억 개의 파라미터로 구성된 LLM을 학습시키고 실행할 수 있는 대규모 AI 프로세서를 개발했다.

다른 대형 기술 회사들도 AI 하드웨어를 개선하고 있다. 구글은 지난해 4세대 TPU(구글의 인공지능 전문 칩) 칩과 올해 TPU v4 pod를 선보였다. 아마존은 특수 AI 칩을 선보였고 페이스북은 자체 AI 하드웨어를 개발하고 있다. 다른 거대 기술 기업들이 LLM 시장 점유율을 확보하기 위해 자사 하드웨어 성능을 사용하는 것은 놀라운 일이 아니다.

OpenAI의 새로운 가격 책정 모델에서 흥미로운 것은 세부 조정된 GPT-3 모델에는 적용되지 않는다는 것이다. 세부 조정은 애플리케이션별 데이터 세트에 대해 사전 학습된 모델을 재학습하는 프로세스다. 세부 조정된 모델은 대상 응용 분야에서 신경망의 성능과 안정성을 개선한다. 세부 조정은 개발자가 특정 응용 프로그램에서 더 큰 기본 모델의 성능과 일치하도록 더 짧은 프롬프트나 더 작은 세부 조정된 모델을 사용할 수 있도록 해 추론 비용을 줄여준다.

예를 들어, 한 은행이 고객 서비스 챗봇에서 이전에 다빈치(Davinci, 가장 큰 GPT-3 모델)를 사용했다면, 회사 관련 데이터에서 더 작은 큐리(Curie) 또는 바베지(Babbage) 모델을 세부 조정할 수 있다. 이렇게 하면 적은 비용으로 동일한 수준의 성능을 얻을 수 있다.

현재 세부 조정된 모델의 가격은 기본 모델의 두 배에 달한다. 가격 변경 후 가격 차이는 4-6배 증가할 전망이다. 일부에서는 세부 조정된 모델이 OpenAI가 실제로 기업과 수익을 내는 곳이라고 보고 있어 가격이 그대로라는 추정도 나온다.

또 다른 이유는 OpenAI가 세부 조정된 모델의 비용을 줄일 수 있는 인프라가 아직 없기 때문일 수 있다(모든 고객이 동일한 모델을 사용하는 기본 GPT-3과 달리, 세부 조정된 모델은 고객당 하나의 GPT-3 인스턴스가 필요하다). 향후 세부 조정 가격도 떨어질 수 있을 것으로 예상할 수 있다.

AI타임스 이한선 객원 기자 griffin12@gmail.com

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com