AI 독순술의 진화…오류율 2.75~7.66%에 불과

청각장애인 위한 사회복지서비스 발전 기대

(AI타임스=윤영주 기자) 입모양을 읽어내는 AI 기술이 인간을 앞지른 데 이어 정확도도 나날이 발전하고 있다.

미국 IT 매체 벤처비트(VentureBeat) 등 최근 외신 보도에 따르면 중국 최대 전자상거래기업 알리바바(Alibaba)가 새롭게 선보인 AI 기반 독순술 시스템은 오류율이 2.75~7.66% 수준에 불과할 만큼 높은 정확도를 보이는 것으로 나타났다.

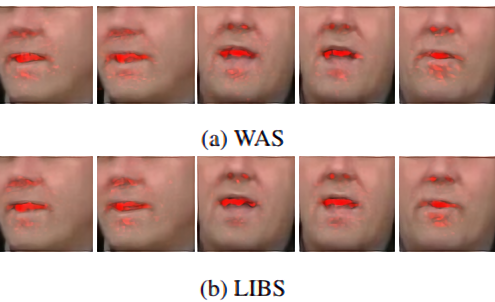

사실 지난 2016년에 이미 구글 인공지능 자회사 딥마인드(DeepMind)가 사람의 입모양을 읽어내는 AI 시스템을 개발한 바 있다. 당시 구글과 옥스퍼드대학교의 연구진들은 AI 기반 소프트웨어 ‘WLAS(Watch, Listen, Attend and Spell)’를 통해 비디오 영상 장면을 46.8%의 정확도로 읽어낼 수 있었다고 전했다. 이는 같은 상황에서 인간인 전문가가 12.4%의 정확도를 보인 데 비하면 놀라운 수준이었다.

이후 알리바바 연구진과 중국 저장대학교(Zhejiang University), 미국 스티븐스 공과대학교(Stevens Institute of Technology)의 연구원들이 음성 인식 기술을 활용해 ‘LIBS(Lip by Speech)’라는 새로운 AI 기반 시스템을 공동으로 고안했다.

연구원들은 영국 BBC에서 방송된 수천 시간에 달하는 영상의 45,000개 영어 문장과 중국 CNTV(China Network Television)에서 송출된 약 10만 개의 중국어 문장을 AI 소프트웨어에 학습시켰다. 또 딥러닝 기술을 통해 사전 정립된 데이터베이스를 기반으로 입술의 움직임을 읽는 훈련이 이루어졌다. 특히 알리바바의 독순술 프로그램은 음성 인식 시스템도 도입해 훨씬 정교하게 입술의 움직임을 읽어낼 수 있다. 그 결과 프로그램 오류율을 중국어의 경우 7.66%, 영어는 2.75%까지 줄일 수 있었다. 이전 방법들과 비교해 독순술의 정확도가 크게 개선된 셈이다.

현재 전 세계 인구의 약 5%에 해당하는 4억 6천6백만 명의 사람들이 청력 장애로 고통 받고 있다. 세계보건기구(WHO)에 따르면 이 수치는 2050년에 9억 명을 넘어설 것으로 추산된다. 즉 이처럼 날로 정교해져가는 AI 기반의 독순술 시스템을 잘 활용할 경우 주변 소음으로 인해 음성 인식이 어려운 상황에서 유용하게 쓰일 뿐 아니라 향후 청각장애인들을 위한 수화 통역 등 다양한 사회복지 서비스 발전에도 기여할 것으로 기대된다.

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com