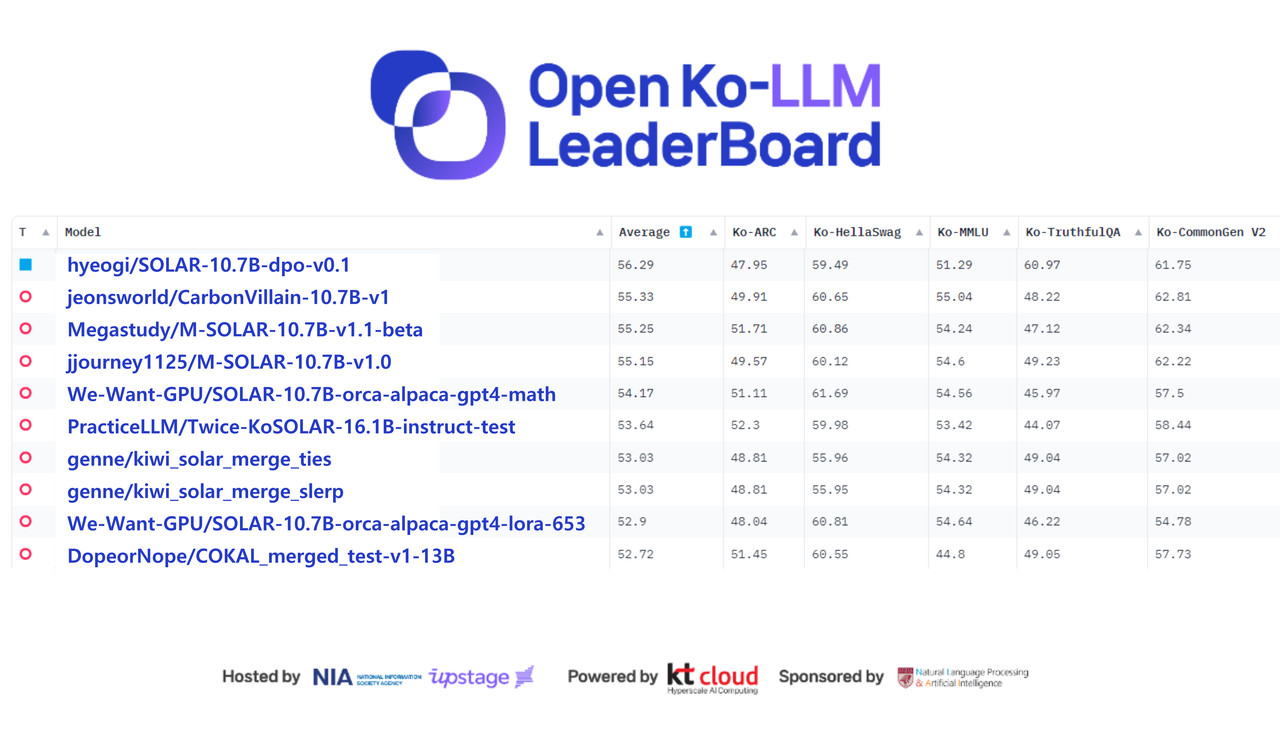

오픈 Ko-LLM 리더보드

업스테이지(대표 김성훈)의 소형언어모델(sLM) '솔라(Solar)'가 글로벌에 이어 국내 LLM 리더보드도 점령했다. 또 교육 전문 메가스터디교육(대표 손성은)이 단숨에 상위권에 등극, 새로운 강자로 떠올랐다.

업스테이지의 솔라는 지난주 허깅페이스의 오픈 LLM 리더보드 1~10위를 차지한 모델 전체의 베이스 모델로 파란을 일으켰다. 지난 29일 기준 1위 'kyujinpy/Sakura-SOLAR-Instruct'부터 10위 'rishiraj/meow'까지 10개 모델 전부가 솔라를 베이스로 한 미세조정 버전이다. 파운데이션 모델인 'SOLAR-10.7B-Instruct-v1.0'는 5위에 올랐다.

국내의 '오픈 Ko-LLM 리더보드'도 상황은 크게 다르지 않다. 1월1일 기준 상위 10개 중 8개가 솔라를 베이스로 한 모델이다. 기존 '라마 2'나 '미스트랄' 등 외산 LLM을 밀어내고, 명실상부 국내외 개발자들로부터 가장 많이 활용되는 'sLM의 교과서'가 됐다.

업스테이지 측은 "12월 5주차 기준 770개 이상의 모델이 제출됐다"라며 "솔라 10.7B 모델의 글로벌 1위 석권 이후 한국어 리더보드 상에서도 솔라 기반 모델의 확산세가 두드러졌다"라고 전했다.

또 "앞으로는 솔라의 한국어 성능이 더욱 고도화되는 만큼 더 많은 활용 모델이 상위권을 휩쓸 것"이라고 전망했다.

메가스터디교육이 단숨에 리더보드 강자로 자리 잡았다는 점도 주목할만 하다.

현재 4위인 'jjourney1125/M-SOLAR-10.7B-v1.0'는 바로 전날인 12월31일까지 1위를 유지한 모델이다. 이는 메가스터디교육과 프리딕션(대표 이인섭, 송근일), 마이스(대표 정성욱) 등 교육 전문 기업들의 협업 결과다. 업그레이드를 거친 'Megastudy/M-SOLAR-10.7B-v1.1-beta'는 3위까지 치고 올라왔다.

이와 관련, 메가스터디교육은 프리딕션과 최근 LLM 구축을 위한 전략적 협업을 밝힌 바 있다. 프리딕션은 기출 앱 '큐비'를 통해 연간 1억건 이상의 문제 풀이 데이터를 생성하며 주목받고 있다. 특히 OCR(광학문자인식) 분야 기술로, 문제은행 데이터베이스와 관련한 모든 업무 프로세스에 AI 기술을 적용 중이다.

메가스터디교육은 최근 음성인식과 영상 압축 분야에 AI 기술을 적극 도입해 업무 자동화를 추진하고 있다. 이번 공동 LLM 개발은 학생들의 학습 효율성을 극대화하는 새로운 서비스를 개발하기 위한 것이라고 밝혔다.

이번 모델 개발의 주역인 최의진 메가스터디교육 개발자는 "실제 프리딕션과 LLM 관련 프로젝트를 시작하며 효율적인 연구 방법을 고민하던 차에 오픈Ko-LLM 리더보드에 제출하게 됐다"라며 "이전부터 다수 대회를 참여하며 대규모 데이터셋을 전처리하다 보니 관련 스킬을 숙련시킬 수 있었다"라고 전했다.

특히 "메가스터디교육은 교육 도메인에 최적화한 AGI를 만드는 것이 목표"라며 "우리가 보유한 다양한 콘텐츠와 조합, 학생들에게 동기부여가 가능한 AGI를 만드는 데 집중하고 있다"라고 말했다.

개인적으로는 "AI를 처음 배우기 시작할 때 동료들과 10년 뒤에는 어떤 것을 개발하고 있을지 논의하던 것이 떠오른다"라며 "기술 발전이 엄청나게 빨라지는 지금, 마블 영화에 나오는 '자비스(Jarvis)' 같은 AGI를 만든다는 것도 허황한 말은 아닐 것"이라는 기대를 밝혔다.

리더보드에서는 1위보다 더 큰 목적을 가지고 있었다. 최의진 개발자는 "대회 참여 경험도 많고 전 직장에서는 대회 호스팅을 주로 담당한 지라, 1위는 금방 따라잡힐 것으로 예상했다"라며 "영어권 리더보드의 평균 점수 대비 한국어 언어모델의 리더보드 점수가 상대적으로 낮을 뿐더러 학습 데이터셋도 많이 부족한 상태라, 당분간은 많은 정보를 공유하고 한국어 언어모델 수준 전체를 끌어올리는 데 기여하고 싶다"라고 말했다.

이어 "오픈 LLM 리더보드의 경우 언어모델의 추론 능력, 상식 능력, 언어이해력, 환각방지 능력, 한국어 상식생성 능력 등을 측정하지만, 이보다 훨씬 더 많은 측정 항목을 가지고 평가할 필요가 있다고 생각한다"라며 "데이터 구축이 까다로운 만큼, 개발자를 넘어 콘텐츠 기획자, 서비스 기획자 등 팀 인원 전체가 참여해 개발을 진행하고 있다"라고 덧붙였다.

더불어 "기획자들은 오르카(Orca) 데이터셋을 일일이 번역하면서 고민 중"이라며 "학습용 데이터셋 구축을 위해 수능 문학, 비문학 강의를 듣는 인원도 있다"라고 비하인드를 전하기도 했다.

한편, 업스테이지와 한국지능정보사회진흥원(NIA)이 공동 주최하는 리더보드의 상세 내용은 NIA 홈페이지나 허깅페이스 홈페이지에서 확인할 수 있다.

장세민 기자 semim99@aitimes.com

무단전재 및 재배포 금지

기사제보 및 보도자료 news@aitimes.com