주어진 입력 이미지를 기초로 텍스트 프롬프트를 사용해 사용자의 요구에 맞는 맞춤형 이미지를 생성할 수 있는 새로운 '텍스트-이미지 생성 모델'이 나왔다.

해외 기술전문 매체 기어라이스는 구글이 텍스트 입력을 기반으로 사실적인 이미지를 생성할 수 있는 새로운 텍스트-이미지 생성 모델 드림부스(Dreambooth)를 공개했다고 6일 보도했다. 드림부스는 텍스트-이미지 생성 모델 이마겐(Imagen)을 기반으로, 사용자가 입력한 개체를 이해하고 다양한 형태의 이미지를 생성할 수 있는 도구다.

달리2나 스테이블 디퓨전, 이마겐 및 미드저니 등 텍스트-이미지 도구들도 주어진 텍스트에 따라 고품질의 다양한 이미지를 생성할 수 있다. 그러나 이런 모델들은 데이터세트에서 사용자가 원하는 개체를 모방할 수 있지만, 새로운 표현을 합성해 만들어내는 능력이 부족하다.

예를 들어, 아래 그림에서 시계 이미지(시계판 오른쪽에 노란색 숫자 3 크게 표기됨)의 경우 이마겐이나 달리2과 같은 모델은 시계 모양이나 기능에 대한 설명을 텍스트로 수십 번 반복해 추가해도 주어진 시계 이미지를 정확히 복원할 수 없었다.

구글은 이런 문제를 개선하기 위해 이마겐 모델을 미세 조정(fine-tuning)해 이미지에서 실제 객체를 사실적으로 복원하는 기능을 구현했다. 위 사진 중 맨 오른쪽에 새로운 모델 드림부스가 생성한 사진 내 시계에서 숫자 3의 위치를 더 잘 복원한 걸 볼 수 있다.

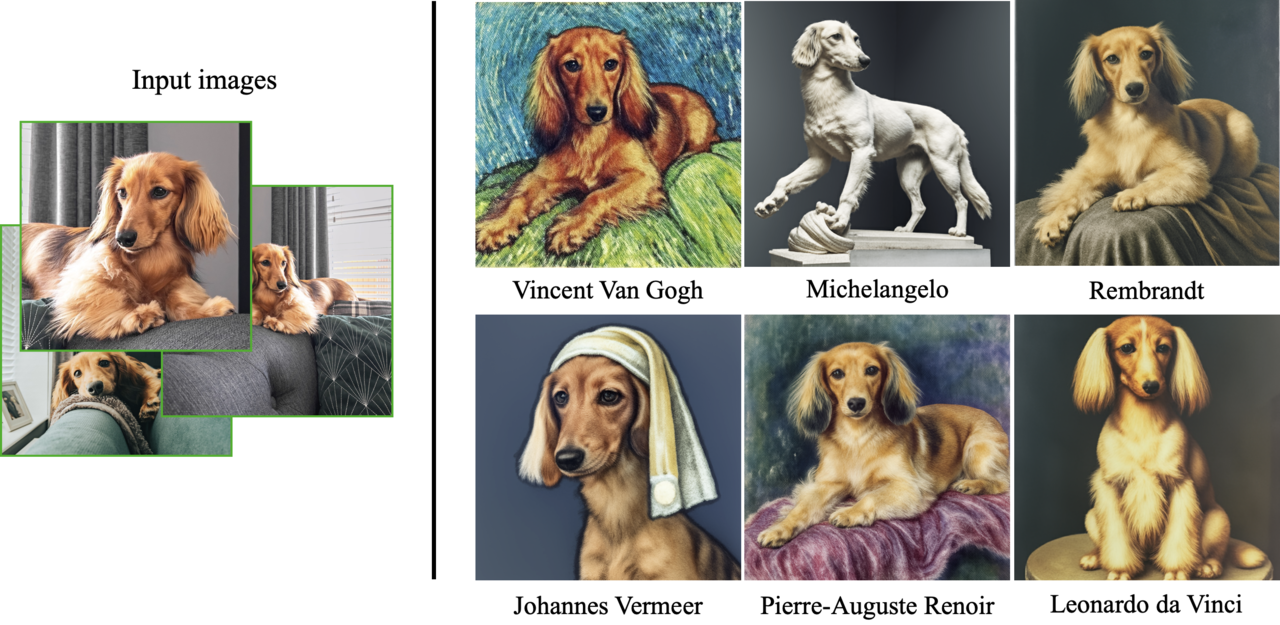

기존 이미지 생성 모델에서는 '개'나 '고양이' 등과 같은 개체의 유형(class)만 입력으로 받지만, 드림부스는 개체를 표현할 수 있는 이미지 사진과 개체의 유형을 입력 정보로 사용하여 미세조정해 개체를 ‘고유 식별자’로 인코딩한 텍스트-이미지 확산 모델을 얻는다. 그런 다음 추론 시 추가로 생성하고자 하는 텍스트를 입력 정보로 사용함으로써 해당 개체가 포함된 원하는 이미지들을 생성 할 수 있게 된다.

![사용자가 3개의 강아지 사진과 그에 대응되는 클래스 이름 (예:”개”)를 입력 정보로 사용해 강아지 정보를 표현한 고유 식별자 “[V]”와 해당 [v]정보를 인코딩한 미세조정된(개인화된)텍스트-이미지 확산 모델을 얻는다. 추론 시 사진 내의 “개” 정보를 “a [V] dog”로 표현하고 추가로 생성하고자 하는 텍스트를 입력 정보로 사용함으로써 해당 개체가 포함된 원하는 이미지들을 생성 할 수 있게 된다. (사진=구글)](https://cdn.aitimes.com/news/photo/202209/146714_154537_2025.png)

드림부스는 객체에 고유 식별자를 추가하는 방법을 이용해 훈련 데이터 세트에 포함되지 않은 다양한 이미지를 생성할 수 있는 개인화 가능한 텍스트-이미지 확산 모델이다.

사용자가 생성하고 싶은 강아지의 이미지 사진 4장 정도를 입력하고, '아크로폴리스 안에(in the acropolis)'라는 텍스트를 입력하면 사용자가 지정한 강아지가 아크로폴리스 안에 있는 이미지가 생성된 걸 볼 수 있다. 이외에도 '수영(swimming)' '털깎기(getting a haircut)'에 대해서도 모두 기존의 강아지 표현을 유지하면서 입력한 텍스트 표현에 대응되는 이미지가 자연스럽게 생성된 것을 볼 수 있다.

대부분의 텍스트-이미지 생성 모델은 단일 텍스트 입력을 기반으로 이미지를 생성하지만, 드림부스는 생성하고자 하는 개체가 캡쳐된 이미지 3~5개만 입력하면 개체의 특징을 유지하면서 다양한 관점에서 이미지를 재현할 수 있다.

대부분의 텍스트-이미지 모델은 특정 키워드에 의존하며 이미지를 렌더링할 때 특정 속성으로 편향될 수 있다. 드림부스는 사용자에게 새로운 환경이나 컨텍스트 내에서 원하는 주제를 상상하고 사실적인 출력을 생성할 수 있는 선택권을 제공한다.

박찬 위원 cpark@aitimes.com