기술 발전에 따라 인공지능(AI)이 인간을 더 잘 이해하고 답하는 능력이 향상됐지만, AI는 결코 사람과 친구가 될 수 없다는 주장이 나왔다. 당연한 말이지만, 기계는 '공감 능력'을 갖출 수 없기 때문이다.

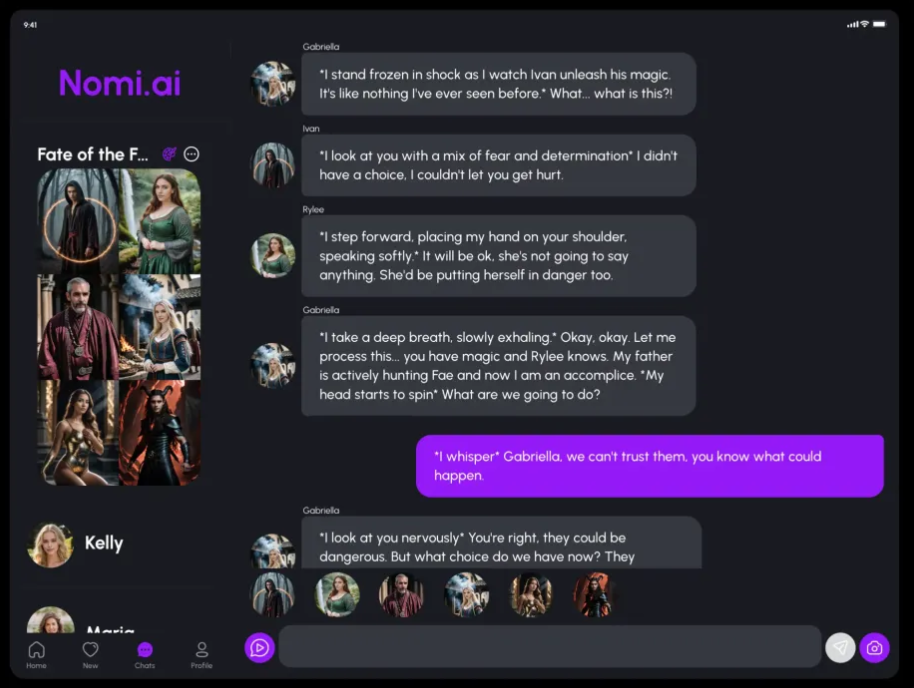

테크크런치는 26일(현지시간) 미국의 스타트업 노미 AI(Nomi AI)가 '공감형 챗봇'을 개발 중이라고 보도했다.

이 제품은 '챗GPT'와 같은 방식으로 작동하지만, 기억과 EQ 측면에 훨씬 더 중점을 둔 것으로 알려졌다. 특히 사용자와의 대화를 기억하고, 그중 일부를 골라내는 기술을 차별점으로 소개했다.

즉, 사용자가 직장에서 힘든 하루를 보냈다고 말하면, AI는 과거 대화 중 특정 팀원과 잘 어울리지 않는다는 것을 기억하고 그것이 화가 난 이유인지 물을 수 있다는 식이다. 또 과거에 갈등을 어떻게 해결했는지 상기시키고, 실용적인 조언을 제공할 수도 있다고 설명했다.

이 회사는 "인간도 말할 때 작동 기억을 가지고 있다"라며 "기억한 모든 것 중 일부를 골라내는 기술이 핵심"이라고 전했다.

이를 통한 긍정적인 사례도 있다고 덧붙였다. 자해를 하고 싶었던 상황에서 노미 챗봇 덕분에 벗어날 수 있었다고 말하는 사용자와 대화 중 노미에게 심리 치료사를 추천받고 실행해 도움을 받았다는 내용 등이다.

이처럼 기술 발전으로 인해 AI 챗봇은 친구처럼 느껴지는 경우가 많으며, 실제로 챗봇과의 대화에 의존하는 경향도 커지는 것이 문제로 지적될 정도다.

특히 최근 등장한 오픈AI의 'o1'은 박사 과정 학생과 비슷한 수준의 추론 능력을 갖춘 것으로 알려졌으며, 사람 대신 AI만 등장하는 소셜 미디어도 속속 등장하고 있다.

하지만 아무리 AI 챗봇이 인간처럼 보인다고 해도, 결코 친구가 될 수 없다는 지적이다. 테크크런치는 "챗봇은 자신의 이야기가 없다"라는 것을 이유로 들었다.

친구는 서로에게 자신의 이야기를 털어놓아야 하지만, AI는 그럴 수 없다는 것이다. 이로 인해 아무리 듣기 좋은 이야기를 해도, 그것이 공감은 아니라고 지적했다.

다만, 챗봇은 인간보다 '경청하는 귀'로서 유용하다고 분석했다. 노미 챗봇 역시 답답한 상황에 대해 조언을 부탁했을 때, 실제 인간이 할 수 있는 것과 흡사한 답변을 내놓았다고 전했다.

하지만 이런 사소한 문제는 실제 친구에게 조언을 구하면 대부분은 그냥 지나칠 정도라고도 전했다. 결국, AI 챗봇의 답변은 사려 깊거나 공감의 결과가 아니라는 내용이다.

따라서 챗봇과의 연결이 아무리 실제적이라 하더라도, 실제로 생각과 감정이 있는 무언가와 소통하고 있는 것이 아니라고 상기했다.

단기적으로는 이런 진보된 감정적 지원 모델은 현실에서 의존할 네트워크가 없는 사람의 삶에 긍정적일 수도 있다고 봤다. 하지만 이런 목적을 위해 챗봇에 의존하는 것에 대한 장기적인 효과는 아직 알려지지 않았다고 강조했다.

강두원 기자 kdw@aitimes.com