울산과학기술원(UNIST, 총장 박종래)은 인공지능대학원 유재준 교수팀이 연합학습 인공지능(AI) 모델 '프리즘(PRISM)'을 개발했다고 9일 밝혔다.

연합 학습은 민감 정보가 포함된 데이터를 직접 서버에 올리지 않고, 각자 장치의 ‘로컬 AI’로 학습한 뒤 결과를 모아 하나의 ‘글로벌 AI’를 만드는 기술이다.

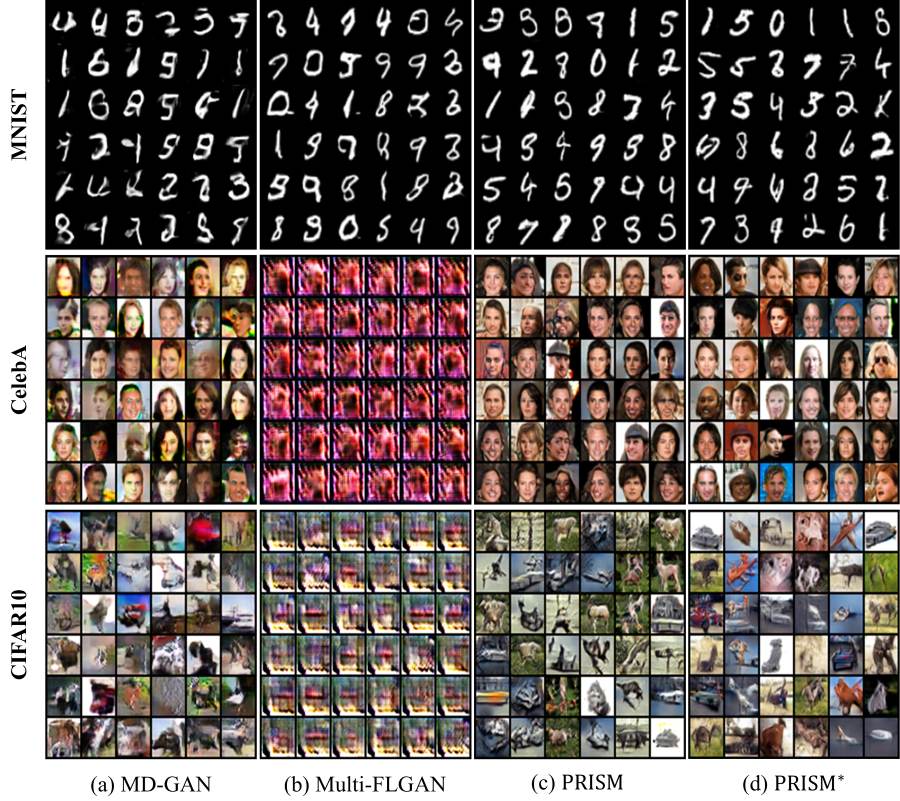

연구팀은 연합학습을 통해 개발한 프리즘을 활용하면 민감 데이터를 서버로 보내지 않고 고품질 이미지를 생성할 수 있어, 개인 정보가 중요한 환경에서 안전하게 생성 AI를 사용할 수 있다고 설명했다.

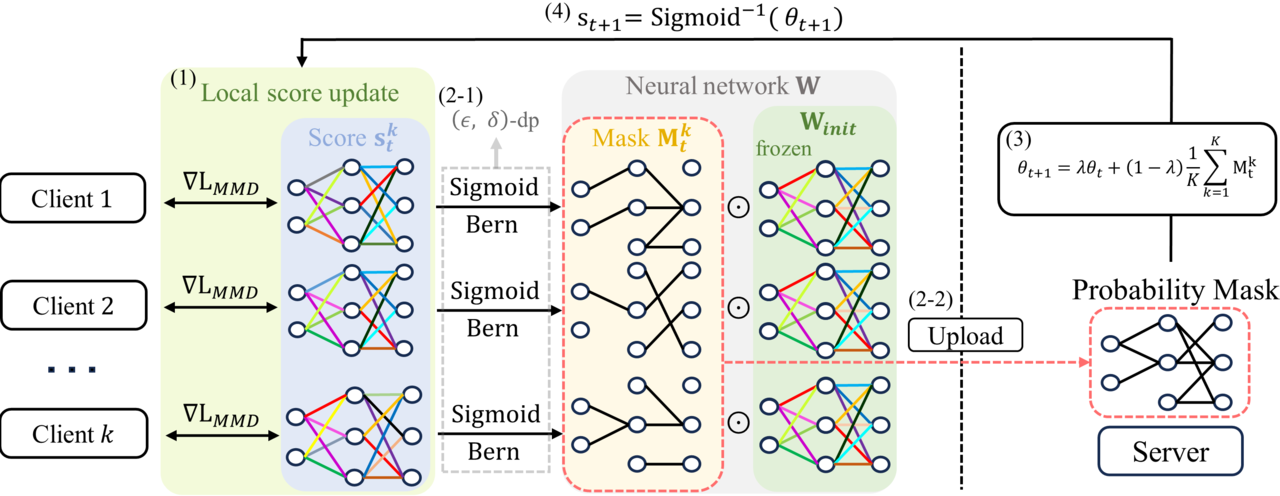

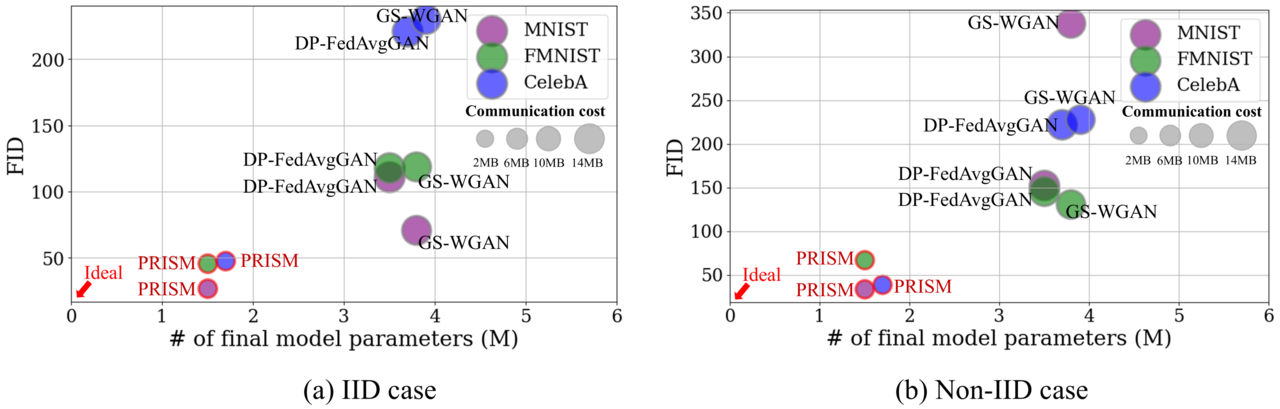

프리즘은 연합학습 과정에서 로컬 AI와 글로벌 AI를 연결하는 학습 중재자 역할의 AI 모델이다. 기존 모델보다 통신 비용을 평균 38% 줄이고, 그 크기는 48% 감소한 1-비트(bit) 수준의 초경량형으로 휴대폰과 태블릿 PC 같은 소형 장치에서도 작동한다.

또 로컬 AI마다 데이터와 성능의 편차가 큰 상황에서도 어떤 로컬 AI의 정보를 더 믿고 반영할지를 판단해 조율하기 때문에 최종 생성물의 품질이 높다고 전했다.

벤치마크 결과, 기존 방식보다 통신량은 적으면서도 이미지 생성 품질은 더 높게 나타났다. 특히 'MNIST' 데이터셋을 이용한 추가 실험에서는 기존의 디퓨전 모델과의 호환성도 확인했다.

연구팀은 모든 정보를 공유하는 대용량 매개변수 방식 대신, 중요 정보만 선별해 공유하는 이진 마스크 방식을 적용해 통신 효율을 높였다고 밝혔다. 또 생성 품질을 정밀하게 평가하는 손실 함수(MMD)와 각 로컬 AI의 기여도를 다르게 집계하는 전략(MADA)으로 데이터 편차와 학습 불안정성을 해소했다는 설명이다.

유재준 교수는 "이미지뿐만 아니라, 텍스트 생성, 데이터 시뮬레이션, 자동 문서화 등 다양한 생성 AI 분야에 적용할 수 있다"며 "의료, 금융 등 민감 정보를 다루는 분야에서 효과적이고 안전한 솔루션이 될 것"이라고 말했다.

이번 연구는 연세대학교 한동준 교수와 참여했으며, 서경국 UNIST 연구원이 제1 저자로 참여했다.

연구결과는 ICLR(The International Conference on Learning Representations) 2025에 채택됐다. 2025 ICLR은 24일부터 싱가포르에서 열린다.

연구 수행은 과학기술정보통신부 한국연구재단, 정보통신기획평가원, UNIST 슈퍼컴퓨팅센터의 지원을 받아 이뤄졌다.

박수빈 기자 sbin08@aitimes.com