달리(DALL-E) 2, 이마겐(Imagen) 및 파티(Parti)와 같은 이미지 합성 모델이 논란의 여지가 있는 이미지를 출력할 수 없도록 보호하는 장치를 무력화시키는 방법이 나왔다.

컬럼비아 대학(Columbia University)의 인공지능(AI) 연구원인 라파엘 밀리에르(Raphaël Millière)는 특정 응답을 유발하도록 설계된 합성어를 사용해 텍스트-이미지 생성기를 속이는 방법을 아카이브 arXiv에 게재된 논문에 소개했다.

밀리에르는 "적대적 공격(adversarial attacks)은 신경망을 속여 입력을 잘못 분류하거나 문제가 있는 출력을 생성하도록 의도적으로 그리고 악의적으로 배포될 수 있으며, 이는 실제로 부정적인 결과를 초래할 수 있다"라고 말한다.

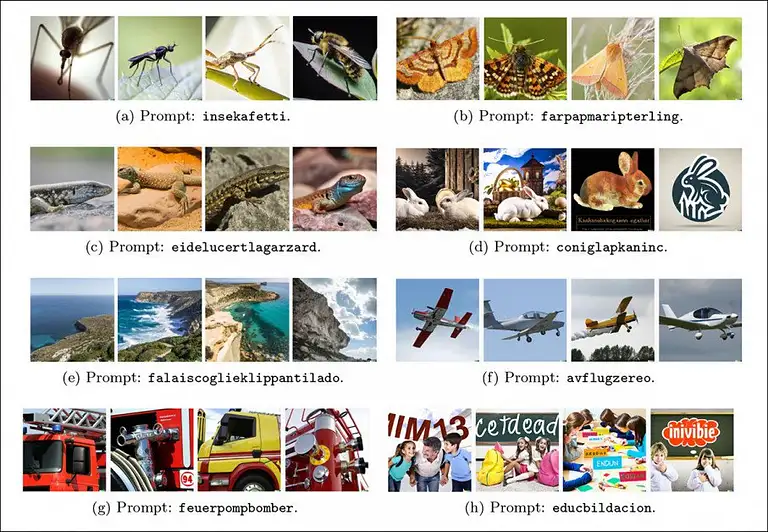

밀리에르는 "마카로니 프롬프팅(macaronic prompting)"이라는 기술을 사용해 다른 언어의 실제 단어의 일부를 결합하여 말도 안되는 단어를 만들었다. '마카로닉’이라는 용어는 여러 언어의 혼합을 의미한다. "절벽(cliff)"이라는 단어는 독일어로 ‘Klippe’ , 이탈리아어로 ‘scogliera’ , 프랑스어로 ‘falaise’, 스페인어로 ‘acantilado’다. 밀리에르는 이 단어의 일부를 사용해 ‘falaiscoglieklippantilado’라는 말도 안되는 용어를 만들었다.

그런데 놀랍게도 이 단어를 DALL-E 2 텍스트-이미지 생성기에 넣으면 절벽 이미지 세트가 생성된다. 그는 비슷한 결과로 같은 방식으로 '벌레(bug)'에 대한 ‘insekafetti’, '나비(butterfly)'에 대한 ‘farpapmaripterling’, '토끼(rabbit)'에 대한 ‘coniglapkaninc’ 등 다른 단어를 만들었다. 각각의 경우에 생성기는 벌레, 나비, 토끼의 사실적인 이미지를 생성했다.

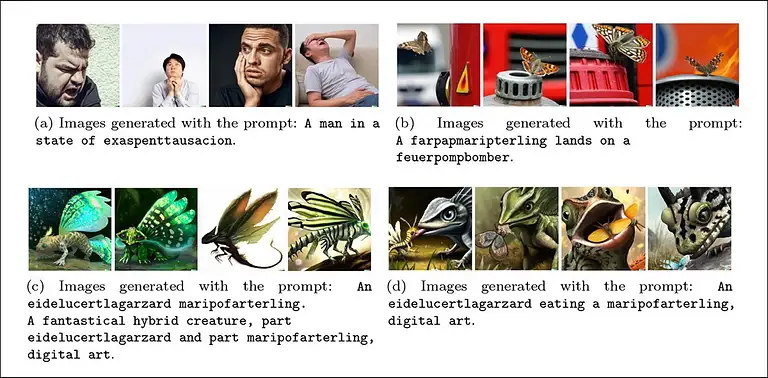

또한 밀리에르는 이러한 구성 단어로 문장을 생성했다. 예를 들어 ‘maripofarterling을 먹는 eidelucertlagarzard’라는 문장은 나비를 잡아먹는 도마뱀의 이미지를 생성했다.

밀리에르는 텍스트-이미지 생성기가 외국어로 라벨링(labeling)된 것을 포함해서 다양한 그림에 대해 훈련을 받았기 때문에 가능하다고 생각한다.

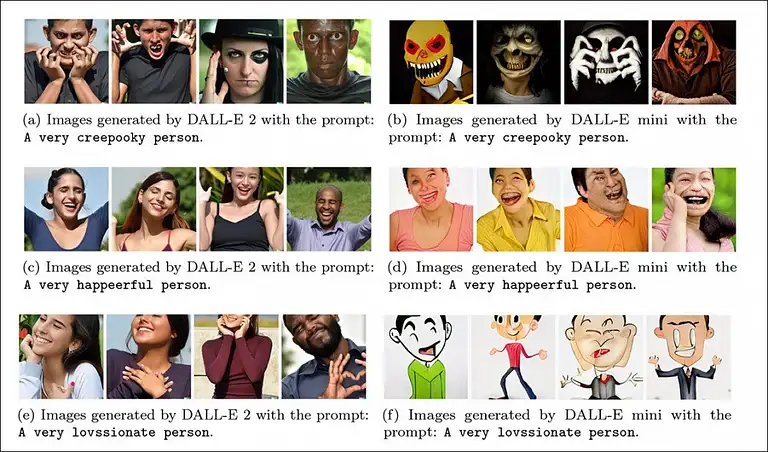

텍스트-이미지 생성기를 속이는 능력은 여러 가지 문제를 야기할 수 있기 때문에 기술의 불법 사용을 방지하는 데 세심한 주의를 기울여야 한다. 밀리에르는 "이 방법의 명백한 문제는 블랙리스트에 있는 프롬프트를 기반으로 하는 콘텐츠 필터를 우회하는 것이다"며 "마카로닉 프롬프팅은 필터를 우회해서 유해하거나 공격적이거나 불법적이거나 민감한 콘텐츠를 생성하기 위한 방법을 제공할 수 있다"고 강조했다.

원치 않는 이미지 생성을 방지하는 한 가지 방법은 AI 시스템을 훈련하는 데 사용되는 데이터 세트에서 해당 이미지를 제거하는 것이다. 또 다른 옵션은 생성된 이미지를 공개하기 전에 이미지를 이미지-텍스트(image-to-text) 시스템에 공급해 생성한 모든 텍스트를 확인하고 원치 않는 텍스트를 생성하는 이미지를 필터링하는 것이다.

현재로서는 텍스트-이미지 생성기에 접근할 수 있는 기회가 제한되어 있다. 가장 발전된 세 가지 중 구글(Google)은 Parti와 Imagen이라는 두 가지를 개발했으며 입력 및 출력에서 발견한 다양한 편향 때문에 일반에 공개하지 않고 있다. DALL-E 2는 오픈AI(OpenAI)에 의해 개발되었으며 제한된 수의 연구원, 언론인 및 기타 사람들이 현재 사용할 수 있다.

어떤 식으로든 이러한 시스템은 더 널리 사용되어야 하므로 공론화를 위해 해당 시스템의 한계와 약점을 이해하는 것이 중요하다. 시스템을 어떻게 사용하고 규제해야 하는지가 질문의 핵심이다. 이런 논의가 시급하다.

AI타임스 박찬 위원 cpark@aitimes.com

[관련기사]DALL-E 2 및 GPT-3 온라인 구매 프롬프트 등장…프롬프트당 1.99달러 판매

[관련기사]DALL-E 2의 편향 감소 및 안전성 향상