메타버스가 미래 기술 사회 키워드로 부상하면서 뇌공학 분야 KAIST 교수들이 관련 연구에 주력하는 모습이다.

KAIST 바이오및뇌공학과 박성준 교수 연구팀은 가상공간에서 촉각 구현을 가능하게 하는 인공 감각 인터페이스 시스템을 12일 공개했다.

카이스트 같은 과 동료교수로 대중적으로 잘 알려진 정재승 교수는 뇌파를 활용해 생각만으로 로봇이나 기계를 움직이는 차세대 웨어러블 장치를 개발하기 위해 창업을 계획 중이다.

정 교수 연구실에서 진행 중인 다른 연구 주제로는 꿈을 제어하는 스마트 디바이스 개발을 꼽을 수 있다. 영화 ‘인셉션’ 속에서나 등장하던 꿈 편집이 현실에서도 가능할 것이라는 주장이다.

박성준 교수는 고려대 천성우 교수, 한양대 김종석 박사 공동 연구팀과 함께 인간 피부-신경 모사형 인공 감각 인터페이스 시스템을 개발했다. 해당 연구 결과는 국제 학술지 네이처 일렉트로닉스(Nature Electronics)에 6월 3일 게재됐다.

박성준 교수 연구팀이 발표한 논문 ‘인공 신경 촉각 감지 시스템(Artificial Neural Tactile Sensing System)’은 가상·증강 현실과 같은 메타버스 공간, 인공피부, 로봇형 의수·의족에 필요한 인공 감각 시스템에 대한 내용이다.

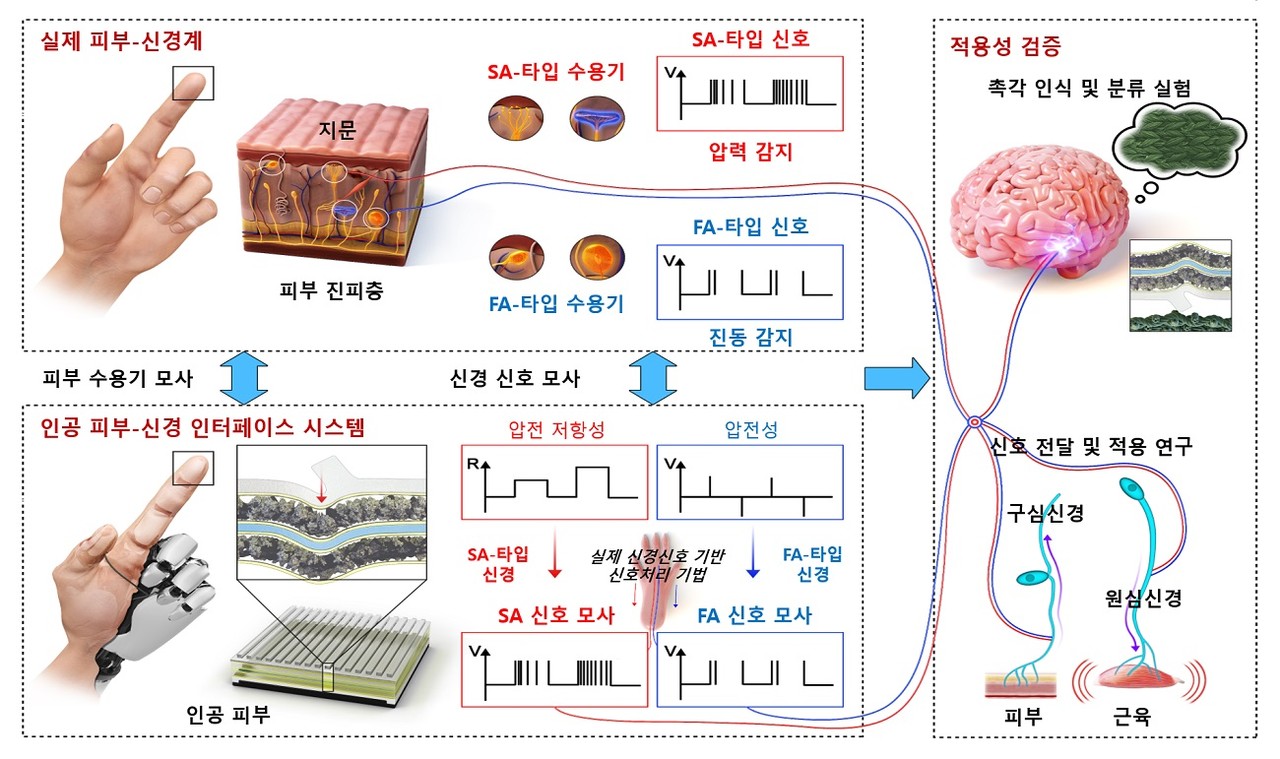

연구팀은 나노입자 기반의 복합 촉각 센서를 제작해 이를 실제 신경 패턴에 기반한 신호 변환 시스템에 연결했다. 연구팀이 만든 센서는 나노입자의 적절한 조합을 통해 피부 내의 압력을 감지하는 늦은 순응 기계적 수용기(SA mechanoreceptor)와 진동을 감지하는 빠른 순응 기계적 수용기(FA mechanoreceptor)를 동시에 모사할 수 있다.

해당 센서로 생성된 전위는 연구팀이 제작한 회로 시스템을 통해 실제 감각 신호와 같은 형태의 패턴으로 변환된다. 생체 내 상황을 최대한 모사하기 위해 실제 감각신경을 추출, 다양한 감각에 의한 신호를 측정해 함수화하는 방법을 사용했다.

연구팀이 개발한 인공 감각 시스템을 동물 모델에 적용했더니 인공 감각 시스템에서 발생한 신호가 생체 내에서 왜곡 없이 전달됐다는 설명이다. 근육 반사 작용과 같은 생체 감각 관련 현상들도 구현할 수 있었다.

연구팀은 “지문 구조로 만든 감각 시스템을 20여종의 직물과 접촉한 결과, 딥러닝 기법을 통해 직물의 질감을 99% 이상 분류할 수 있음을 확인했다”고 전했다.

박성준 교수는 “이번 연구는 실제 신경 신호의 패턴 학습을 바탕으로 한 인간 모사형 감각 시스템을 세계 최초로 구현했다는 데 의의가 있다”고 강조했다.

이어 “해당 연구를 통해 향후 더욱 현실적인 감각 구현이 가능할 뿐만 아니라, 연구에 사용된 생체신호 모사 기법이 인체 내 다양한 종류의 타 감각 시스템과 결합될 경우 더욱 큰 시너지를 낼 수 있을 것”이라고 말했다.

◆정재승 교수, 생각 구현하는 웨어러블 기기·꿈 편집 기술 개발 중

HCI(Human-computer interaction) 연구 권위자인 정재승 교수도 뇌파를 이용한 차세대 웨어러블 기기 개발을 핵심 연구 주제로 꼽았다.

뇌파를 포함한 뇌활동을 모니터링하고 의도를 파악해 생각만으로 로봇이나 기계를 움직이는 기술을 구현하겠다는 것이다. 창업을 계획하고 있는 스타트업 주제도 뇌공학을 접목한 새로운 웨어러블 디바이스 개발이다.

정 교수가 현재 주력 중인 다른 연구 주제도 메타버스와 관련된 것이다. 정재승 교수 연구실에서는 원하는 꿈을 꿀 수 있도록 꿈 내용을 컨트롤하는 디바이스 구현을 목표로 연구하고 있다.

정재승 교수는 “현재 수준으로는 시각, 청각 등 자극을 제시해 원하는 등장인물을 상정 가능하다. 전지현 배우 꿈을 꾸기 위해 관련 이미지를 신호 자극에 삽입하는 방식이다. 현재 10번쯤 꿈을 꾸면 3번 정도는 원하는 대상이 나오는 정도는 구현했다”고 말했다.

이어 “점차 정확도는 높아지겠지만 아직 대상이 등장하는 것 외에 꿈 내용을 만들지는 못하고 있다. 전지현 배우가 등장하더라고 로맨스가 될지 호러가 될지 모르는 것”이라고 덧붙였다.

머릿속 내용을 디지털화하는 기존 연구 중에서는 UC 버클리 갤런트 랩 성과가 대표적이라는 설명이다. 갤런트 랩 연구진은 유튜브 영상을 보여주며 사람의 뇌를 촬영한 후 뇌 활동만을 분석해 영상을 시각적으로 재현하는데 성공했다.

정재승 교수는 “20년쯤 지나면 꿈을 디지털 영상으로 저장하는 것도 가능해질 것이다. 밤에 자고 아침에 일어나면 10분 분량의 꿈 단편 영상이 4, 5개 저장되어 있는 식”이라고 전했다.

AI타임스 박성은 기자 sage@aitimes.com