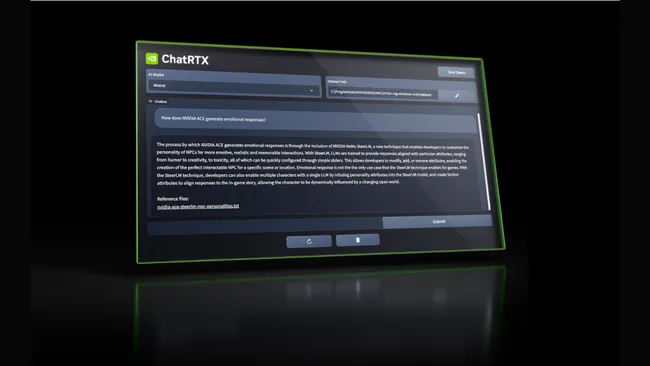

엔비디아가 자체 개발한 AI 챗봇 ‘챗RTX(ChatRTX)’에 텍스트 외에도 음성과 이미지, 새로운 모델에 대한 지원을 추가했다. 챗RTX는 RTX GPU가 장착된 PC에서 로컬로 실행되는 챗봇으로, 사용자가 보유한 데이터셋을 언어 모델에 연결해 음성이나 이미지 쿼리를 통해 상황에 맞는 답변을 제공할 수 있다.

벤처비트는 1일(현지시간) 엔비디아가 온디바이스 AI 챗봇 ‘챗RTX’을 업데이트했다고 보도했다.

이번 업데이트에는 지난 3월 ‘GTC 2024’에서 처음 공개된 챗RTX에 ▲AI 기반 음성 인식 ▲사진 검색 기능 ▲지원 언어모델 확장 등이 추가됐다.

먼저 텍스트 외에도 음성과 이미지를 지원하는 멀티모달 기능이 강화됐다. 사용자는 AI로 음성 언어를 처리하는 '위스퍼(Whisper)'를 통해 챗RTX와 대화할 수 있게 된다. 이 기능의 도입으로 챗RTX는 음성 언어를 이해하고 텍스트로 응답할 수 있다.

또 오픈AI의 '클립(CLIP)'을 통합, 개인 라이브러리에서 단어나 용어 혹은 구문을 사진을 검색할 수 있고 로컬에서 상호작용할 수 있다.

마지막으로 챗RTX에서 지원하는 언어모델에 구글의 최신 언어모델 ‘젬마(Gemma)’와 오픈 소스 모델 ‘챗GLM3(ChatGLM3)’을 추가, 사용자가 목적에 맞게 모델을 선택할 수 있도록 유연성을 강화했다.

챗RTX를 통해 사용자는 텐서RT-LLM 소프트웨어 및 엔비디아 RTX GPU 성능을 활용하여 RTX 기반 PC에서 생성 AI를 로컬로 실행할 수 있다. 모든 작업이 PC에서 로컬로 수행되기 때문에 데이터가 안전하다.

또 깃허브에서 챗RTX 프로젝트를 무료로 참조할 수 있어, 개발자들이 검색 증강 생성(RAG) 기술을 사용해 다양한 사용 사례에 대한 AI 애플리케이션을 탐색하고 확장할 수 있다.

박찬 기자 cpark@aitimes.com