아랍에미리트(UAE)가 간판 오픈 소스 소형언어모델(sLM) '팰컨(Falcon)'의 후속작을 공개했다. '트랜스포머'의 대안으로 꼽히는 '맘바(Mamba)' 아키텍처 기반 '상태 공간 모델(SSM, State Space Model)'로, 동급 최강의 성능을 보였다고 셜명했다.

벤처비트는 12일(현지시간) UAE 아부다비 정부의 첨단기술연구위원회(ATRC) 산하 기술혁신연구소(TII)가 ‘팰컨 맘바 7B(Falcon Mamba 7B)’를 오픈 소스로 출시했다고 보도했다.

이에 따르면 팰컨 맘바 7B는 트랜스포머 아키텍처의 약점을 보완하기 위해 맘바 SSM 아키텍처를 결합했다.

2017년 구글이 개발한 트랜스포머는 LLM 발전을 이끈 주역으로 꼽힌다. 하지만 한계도 명확하다. 입력되는 모든 정보를 처리하기 때문에 컨텍스트 창이 커지면 기하급수적으로 처리 속도가 느려진다.

또 컨텍스트 길이가 커질수록 훨씬 더 큰 메모리 공간을 필요로 하기 때문에 하드웨어 리소스 없이 긴 컨텍스트 창을 실행하기 어렵다.

예를 들어, 입력 크기를 토큰 1000개에서 2000개로 확장하면 입력을 처리하는 데 필요한 메모리와 계산 시간이 두배가 아닌 네배로 늘어나게 된다. 이는 텍스트 내 토큰들의 상관관계를 밝혀내기 위해 입력 정보를 병렬로 처리하는 어텐션 메커니즘 때문이다.

그래서 대안으로 등장한 것이 맘바 아키텍처다. 카네기 멜론 및 프린스턴대학교 연구진이 공개한 맘바 SSM은 트랜스포머보다 AI 성능을 키우고 어텐션 메카니즘의 단점을 줄이는데 초점이 맞춰져 있다. 언어, 오디오 등 다양한 유형들을 커버하는 SSM을 활용, 입력된 정보 중 중요 데이터에 선택적으로 집중할 수 있다.

맘바는 각 단계에서 어떤 정보에 집중하거나 무시할지 선택할 수 있는 특화된 레이어를 제공한다. 이 레이어는 동적으로 SSM 파라미터를 조정할 수 있도록 하는 선택 메커니즘을 사용한다. 이를 통해 모델은 트랜스포머의 어텐션 메커니즘과 유사하게 관련 없는 정보를 걸러내고 관련 정보는 무기한 기억할 수 있다.

또 모델은 추가적인 메모리나 컴퓨팅 자원 없이도 책 한권 분량의 텍스트 시퀀스를 처리할 수 있는 능력을 갖추게 된다.

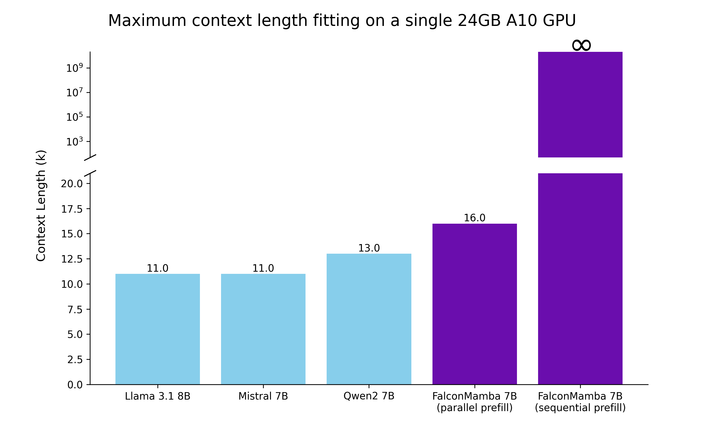

TII는 팰컨 맘바 7B가 처리 가능한 최대 컨텍스트 길이를 확인하는 테스트에서 SOTA 트랜스포머 기반 모델보다 더 큰 시퀀스를 처리했다고 밝혔다. 특히 "전체 컨텍스트 토큰을 토큰별로 처리하거나 GPU에 맞는 크기의 토큰 청크로 처리하는 경우, 이론적으로 무한한 컨텍스트 길이를 처리할 수 있다"라고 강조했다.

처리량 테스트에서도 모든 토큰을 일정한 속도로 생성하며 '미스트랄 7B'의 슬라이딩 윈도우 어텐션 아키텍처를 능가한 것으로 나타났다.

일반 벤치마크에서는 트랜스포머 모델은 물론, 기존 SSM보다 뛰어나거나 비슷한 성능을 기록했다. 추론(Arc), 환각방지(TruthfulQA), 수학(GSM8K) 벤치마크에서 각각 62.03%, 53.42%, 52.54%를 기록하며, '라마 3 8B'나 '라마 3.1 8B' '젬마 7B' '미스트랄 7B' 등 동급 모델을 확실하게 능가했다.

반면, 언어 이해(MMLU)와 상식(Hellaswag) 벤치마크에서는 나머지 모델보다 뒤처졌다.

SSLM은 추정, 예측 및 제어 작업과 같은 다양한 분야에서 응용 프로그램을 찾을 수 있습니다. 변압기 아키텍처 모델과 유사하게 자연어 처리 작업에서도 뛰어나며 기계 번역, 텍스트 요약, 컴퓨터 비전 및 오디오 처리에 적용할 수 있습니다.

하킴 하스드 TII 수석 연구원은 "이번 모델 출시는 AI 기술의 상당한 진전을 나타낸다"라며 "TII에서는 SSLM과 트랜스포머 모델의 경계를 넓혀 생성 AI의 혁신을 더욱 촉진하고 있다"라고 말했다.

또 전작인 팰컨 40B는 4500만번 이상 다운로드됐다고 밝혔다. 지난해 6월 출시한 팰컨 40B는 당시 허깅페이스 리더보드 1위에 오르는 등 큰 인기를 얻으며, 단번에 UAE를 중동 LLM의 핵심으로 만들어준 모델이다

현재 팰컨 맘바 7B는 허깅페이스에서 다운로드할 수 있으며, 상업적 용도로 사용이 가능하다.

박찬 기자 cpark@aitimes.com

- "트랜스포머 대체할 새 아키텍처 개발...더 많은 데이터 저비용 처리 가능"

- UAE, 인기 오픈 소스 모델 '팰컨' 후속작 출시...1년 새 3번째 LLM 공개

- UAE, 오픈소스 LLM '팰컨 40B' 출시...상업적 사용도 자유

- AI21랩스, 하이브리드 SSM-트랜스포머 모델 ‘잠바 1.5’ 공개

- 엔비디아, 비전 AI 능력 향상한 모델 '이글' 오픈 소스 공개

- 하이퍼라이트 "세계 최강 오픈 소스 모델 '리플렉션' 출시"

- '트랜스포머 대안' 맘바 아키텍처, 음성 복제 AI 모델 구축에도 활용

- UAE 대표 모델 '팰컨' 아랍어 전문·sLM 버전 출시...규모 줄이고 실용성 초점