엔비디아가 프론티어급 대형멀티모달모델(LMM)을 공개했다. 특히, 오픈AI의 'GPT-4o'와의 경쟁을 선언, 비상한 관심을 모으고 있다.

벤처비트는 1일(현지시간) 엔비디아가 매개변수 720억개의 LMM 'NVLM-D-72B'를 오픈 소스로 허깅페이스에 공개했다고 보도했다.

이 모델은 지난달 17일 아카이브를 통해 논문으로 발표했다. 그러나 별도의 발표가 없었기 때문에 주목받지 못하다가, 최근 X(트위터) 등에 관계자들의 호평이 잇따르며 주목받게 됐다.

연구진은 논문에서 "우리는 최첨단 결과를 시각 언어 작업에서 달성한 LMM을 소개한다"라며 "이는 GPT-4o와 같은 선도적인 독점 모델과 오픈 액세스 모델과 경쟁한다"라고 설명했다. 또 모델 가중치를 공개적으로 제공하고 훈련 코드도 공개하겠다고 약속했다.

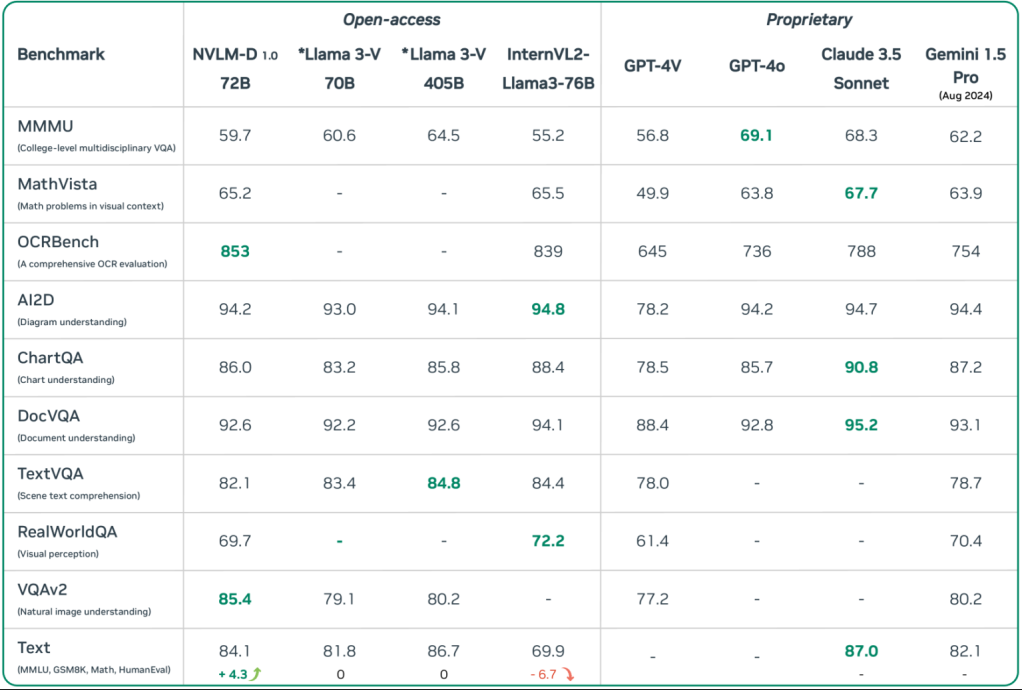

인상적인 벤치마크 결과도 공개했다. 대부분 벤치마크에서 GPT-4o나 '클로드 3.5 소네트', '제미나이 1.5 프로', '라마 3-V 405B' 등과 대등한 성능을 보이며, 시각적 질문 답변(VQA v2)과 광학 문자 인식(OCR)에서는 최고 점수를 획득했다.

특히 멀티모달 훈련 후 텍스트 전용 작업에서 성능을 개선한다고 강조했다. 이 경우 다른 모델은 텍스트 성능이 저하되는 반면, NVLM-D-72B는 주요 텍스트 벤치마크에서 정확도를 평균 4.3포인트 높였다고 전했다.

모델이 공개되자 전문가들은 호평을 내놓았다. 필(Phil)이라는 AI 연구자는 X(트위터)에 "와! 엔비디아가 방금 72B 모델을 공개했는데, 수학 및 코딩 평가에서 라마 3.1 405B와 동등하며 비전 기능도 갖추고 있다"라고 감탄했다.

엔비디아가 이처럼 강력한 모델을 오픈 소스로 출시함에 따라 그동안 폐쇄형 기업의 전유물이었던 LMM 분야의 연구가 급속화될 것이라는 예측이다. 메타도 지난 25일 '커넥트' 행사를 통해 매개변수 11B와 90B의 LMM '라마 3.2'를 공개했다.

특히 그동안 플랫폼에 집중했던 엔비디아가 직접 프론티어 모델 출시에 합류했다는 점에 관심이 모인다. 엔비디아도 그동안 대형언어모델(LLM) 모델을 출시하고 논문도 다수 발표했지만, 대부분 GPU에 최적화된 온디바이스 모델이거나 다른 모델의 배포를 지원하는 프레임워크, 합성데이터 생성 모델 등에 집중해 왔다.

이에 대해 벤처비트는 "엔비디아가 AI 산업에 샷을 날렸다"라며 "이 모델의 진정한 영향은 앞으로 몇달 안에 드러날 것"이라고 평했다.

임대준 기자 ydj@aitimes.com

- 메타, 첫 멀티모달모델 '라마 3.2' 출시..."오픈 소스로 폐쇄형 잡을 것"

- 엔비디아, LG AI연구원 AI '엑사원 3.0' 개발 지원

- 엔비디아, 비전 AI 능력 향상한 모델 '이글' 오픈 소스 공개

- AMD, 최초의 sLM 'AMD-135M' 오픈 소스 출시..."AMD 하드웨어에 최적화"

- 엔비디아, 폭스콘과 대만에서 가장 빠른 AI 슈퍼컴퓨터 구축

- 엔비디아, 오픈AI·앤트로픽 능가하는 LLM 공개...모델 중심 생태계 구축하나

- 엔비디아, 멀티모달 벤치마크 SOTA 달성한 검색 도구 ‘MM-임베드’ 공개

- 중국 칭화대, 엣지 디바이스에 최적화된 LMM ‘GLM-엣지’ 공개

- 사람처럼 인식·추론·기억을 동시에 처리하는 오픈 소스 LMM 등장