오픈AI가 새로운 'o1' 모델과 음성 지원용 API 개선, 새로운 미세조정 방법 등 개발자를 위한 업데이트를 공개했다.

오픈AI는 17일(현지시간) 12일 발표 이벤트 9일 차를 맞아 ▲API에 성능이 더 향상된 o1 제공 ▲리얼타임 API(Realtime API)를 위한 새로운 표준 도입 ▲새로운 미세조정 방법 등을 발표했다.

우선 API로 제공할 o1은 기존 'o1-프리뷰'를 대체하는 풀 버전으로, 함수 호출과 개발자 메시지, 구조화된 출력 및 비전 기능을 지원한다.

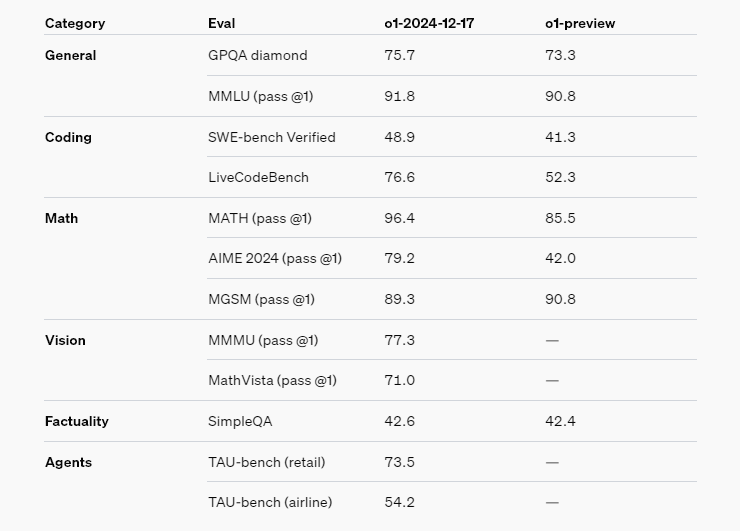

특히 이날부터 API 적용되는 'o1-2024-12-17' 버전은 2주 전 이벤트 첫날 발표한 o1 풀 버전을 사후 훈련으로 강화한 모델이다. 이를 통해 기존 API에 제공하던 o1-프리뷰보다 성능을 크게 끌어올렸다는 설명이다.

이번 출시를 통해 요금도 높였다. 추론 모델에는 더 많은 컴퓨팅 리소스가 들어가기 때문이라고 설명했다. 특히 새로 도입한 최고위 5단계 계층을 사용하기 위해서는 1000달러가 들어간다.

또 o1에 입력하는 단어 75만개당 15달러, o1이 출력하는 75만개당 60달러가 들어간다. 이는 'GPT-4o'의 6배다.

지난 10월 데브데이에서 공개한 리얼타임 API도 강화했다. 이는 기업과 개발자가 오픈AI 기술로 다른 앱에 음성 기능을 추가할 수 있도록 한 것이다.

이를 위해 '웹RTRC(WebRTC)'라는 표준을 도입, 개발자들이 자바스크립트 몇줄만 추가하면 다양한 제품군에서 리얼타임 API를 쉽게 적용할 수 있도록 했다.

또 리얼타임 API에 적용되는 GPT-4o를 최신 버전으로 교체하고 가격을 60% 인하했다고 발표했다. 'GPT-4o 미니'의 경우는 이전 오디오 속도의 10분의 1로 반응 속도가 빨라졌다고 전했다.

개발자가 오픈AI 모델을 미세조정할 때 사용하는 API는 '선호도 미세 조정(PFT)' 방식을 적용한다고 밝혔다. 이는 모델의 응답 쌍을 비교해 모델에 질문에 대한 선호도와 선호하지 않는 답변을 구별하도록 가르치는 방식이다.

기존 '감독 미세 조정(SFT)'이 엄격하고 정확한 출력에 초점을 맞췄다면, PFT는 창의적인 글쓰기나 요약처럼 주관적이며 더 향상된 답변을 생성하는 데 효과적이라는 설명이다.

이 외에도 오픈AI는 Go와 자바용 SDK 베타 버전을 출시, 프로그래밍 언어를 확장했다.

임대준 기자 ydj@aitimes.com