애플은 스스로를 인공지능(AI) 기업이라고 강조한다. 단순 제조업이 아닌 기술 기업으로 새로운 지향점을 제시한 셈이다.

존 지안난드레아 애플 AI 전략 수석부사장은 "iOS에서 AI를 사용하지 않는 기능을 찾아보기가 점점 어려워지고 있다"고 말했다. AI와 머신러닝(ML)은 애플이 생산하는 아이폰, 아이패드 등 거의 모든 생산품에 탑재돼 있다.

애플은 가장 많은 AI 경험을 소비자에게 제공하며, 가장 많은 AI 관련 부품을 사용하는 기업이고, 다만 일부 IT 경쟁사와 달리 자사의 이런 기술을 내세우지 않고 있다는 것이 차이가 있다고 주장한다.

◇애플은 왜 디바이스에 ML 기술을 탑재했나

애플은 자사의 대부분 ML 작업이 디바이스에서 직접 이뤄진다고 강조했다. 이를 통해 아이폰과 같은 디바이스에서 발생한 다량의 데이터를 직접 학습해 소비자들에게 맞는 사용자 경험을 제공할 수 있다는 것이다.

AI 리더 기업으로 불리는 구글, 아마존, 페이스북 등은 클라우드 인프라를 바탕으로 수집한 전 세계의 방대한 데이터를 이용하는 것과는 다른 모델이다. 업계 일부에서는 애플이 이들과 다른 사업 모델과 제한된 데이터 수집으로 ML 성과를 내기 어렵다고 지적한다.

지안난드레아 부사장은 "데이터센터의 더 큰 모델에 대한 이런 인식이 어떻게든 더 정확하다는 것은 이해하지만, 사실은 틀렸다"며 사실 기술적으로 잘못된 것"이라고 반박했다. 그는 "데이터를 이동하기보다는 모델을 데이터에 가깝게 실행하는 것이 좋다"며 "데이터의 출처에 가까이 있는 것이 더 낫고, 따라서 사생활 보호도 된다"고 덧붙였다.

데이터센터에서 이같은 작업을 수행하면 개인정보보호가 어렵다는 단점이 있으며, 디바이스에서 직접 이뤄지는 로컬 프로세싱의 효율이 더 높다는 얘기다.

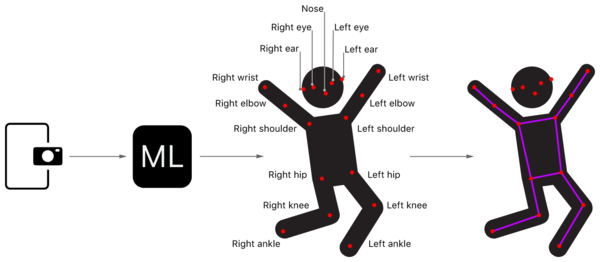

지안난드레아는 '가장 중요한 것은 대기 시간'이라고 강조했다. 데이터센터로 긴 거리를 주고받는 것은 실시간처리가 불가능하기 때문이다. 사람들이 움직이는 것을 알아내고, 그들의 다리와 팔이 어디에 있는지 알아내는 것 같은 고성능 API(Application Program Interface)를 구동시키기 위해서는 데이터센터가 아닌 디바이스에서 이뤄질 수밖에 없다는 이야기다. 이에 애플은 앱스토어에 포즈 추정(pose estimation) 등과 같은 기능을 탑재한 다수의 애플리케이션을 제공한다.

예를 들어, 카메라로 사진을 찍기 전 카메라는 모든 사물을 실시간으로 보고 있다. 이는 사용자가 언제 사진을 찍어야 할지에 대한 결정을 내리는 데 도움을 줄 수 있다. 만약 서버에서 그런 결정을 내리길 원한다면 소비자는 카메라에 담긴 모든 프레임을 서버에 보내야 한다. 비효율적이기 때문에 디바이스에서 작동하는 AI 기능이 필요한 것이다.

애플은 아이폰8과 아이폰X 이후 모든 아이폰에 포함된 ANE(애플 뉴런 엔진)과 같은 맞춤형 실리콘이 앞서 말한 디바이스 내 처리를 위한 전제조건이라고 강조했다. ANE는 애플이 특정 종류의 머신러닝 과제를 처리하기 위해 고안한 옥타코어 신경처리장치(NPU)다.

◇AI 앱 소프트웨어 개발자를 위한 애플의 지원은?

애플은 보다 활발한 AI 기능 개발을 위해 애플리케이션 개발자들이 아이폰의 ML 기능에 접근할 수 있는 소프트웨어 개발 API를 제공한다고 강조했다. 애플에 따르면 CoreML로 불리는 API는 애플이 지원하는 ML 모델, 런타임 모델의 종류를 명확하고 개략적으로 설명한다. CoreML은 파이토치나 텐서플로 같은 유명 ML 언어를 지원한다.

또한 CoreML은 디바이스 내 모델을 실행할 부품을 지정할 수 있다. ANE에서 ML 모델을 실행하는 것이 옳을 수도 있지만, GPU나 CPU에서 모델을 실행하는 것이 나을 수도 있기 때문이다.

아르스테크니카는 "ML 칩이 내장되어 있는 것은 애플 기기뿐만이 아니다"며 "삼성, 화웨이, 퀄컴은 모두 칩 시스템에 NPU를 포함하고 있다. 구글 역시 기계학습 API를 개발자들에게 제공한다"고 지적했다.

애플은 구글뿐만 아니라 다른 휴대폰 제조사와도 AI 전략에 차이점이 있다고 강조했다. 얼마 전 애플은 WWDC에서 '애플 실리콘'을 공개했다. 애플은 인텔을 벗어나 ARM 기반으로 자체 프로세서를 개발한 배경에는 ANE를 탑재해 ML 기능을 강화하겠다는 이유도 포함됐다는 것이다.

지안드레아는 애플의 AI와 ML에 대한 투자가 앞으로 더욱 커질 것이라고 강조했다. 그는 아르스테크니카와의 인터뷰에서 "애플에는 훌륭한 ML 실무자들이 많이 근무하고 있지만 계속 채용하고 있다"며 "ML이 사용자들을 위한 경험을 만드는 데 중요하게 쓰인다는 것이 제품에서 점점 더 분명해지고 있다"고 말했다.