트위터가 이미지 크롭 알고리즘의 인종 편향성 논란에 대해 사과했다.

트위터는 자사 자동 이미지 크롭 알고리즘이 흑인보다 백인 사진을 더 선호해 인종 차별을 조장한다는 사용자 지적이 나오자 사과 입장을 표명했다고 21일(현지시간) BBC 등 주요 외신이 전했다.

이번 논란은 최근 일부 트위터 사용자가 흑인 얼굴과 백인 얼굴을 함께 올린 게시물의 이미지 미리보기에서 백인의 얼굴을 더 자주 보여준다는 사실을 발견하면서 불거졌다. 백인인 콜린 매들랜드 박사과정생은 트위터에 자신과 흑인인 동료의 사진을 올렸는데 매들랜드의 얼굴만 모바일 앱 미리보기에 계속 선택된다는 것이다. 이미지 순서를 바꿔도 마찬가지였다.

즉 백인과 흑인 두 장의 사진이 한 게시물에 있을 때 트위터 알고리즘은 모바일 앱에서 자동으로 백인 얼굴만 보여주는 경우가 많다는 이야기다. 이에 다른 트위터 사용자들도 실험해보니 유사한 결과가 나왔다.

예를 들어 한 트위터 사용자가 미치 매코널 미국 공화당 상원의원의 얼굴과 버락 오바마 전 미국 대통령의 얼굴을 나란히 올려본 결과, 트위터 알고리즘은 미리보기 이미지로 매코널 상원의원의 얼굴을 우선시해 더 선호하는 것으로 나타났다.

이러한 알고리즘의 편향성은 실제 인물뿐 아니라 흑인 만화 캐릭터와 백인 만화 캐릭터 간에서도 나타났다. 심지어 밝은 털 색깔의 개 이미지가 어두운 털색 개 이미지보다 더 우선시됐다.

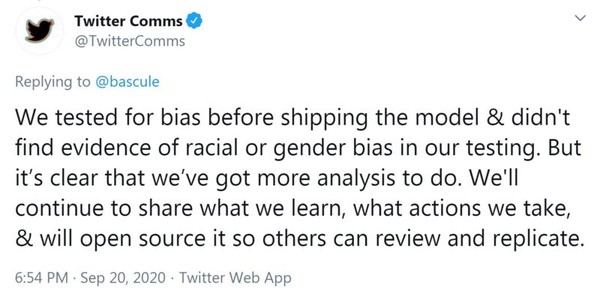

트위터 측은 이 같은 알고리즘의 편향성이 밝혀진 것과 관련해 해당 알고리즘의 문제점을 인정했다. 트위터 대변인은 “알고리즘을 개발하는 과정에서 인종‧성 편향성에 대한 테스트를 거쳤다”면서도 “이에 대한 더 많은 분석이 필요하다”고 재검토 의사를 밝혔다.

한편 AI 알고리즘의 인종 편향성 쟁점이 화두에 오른 것은 이번 트위터 사건뿐만이 아니다. 지난 2015년 구글의 사집 앱 이미지 인식 알고리즘도 흑인 두 명을 고릴라로 표시해 논란이 됐다. 이번에는 백인과 흑인 간 인종 편향성 문제가 주요 쟁점이 됐으나 다른 유색인종에 대한 인종 차별적인 알고리즘을 향한 비판 역시 꾸준히 제기돼왔다.

실제 지난해 미 상무부 기술관리국 산하 미국표준기술연구소(NIST)의 연구보고서에 따르면 안면인식 소프트웨어 알고리즘 대다수가 안면인식 정확도에 있어 인종‧성‧연령별로 편차를 보였다. 특히 백인에 비해 아시아인과 아프리카계 미국인에 대한 안면인식 오류율이 더 높은 것으로 나타냈다. 알고리즘에 따라 오류 편차는 있으나 최소 10배에서 최대 100배 차이를 보이기도 했다.

[관련기사] 페이스북, 인종차별 조장 알고리즘 개선 모색

[관련기사] 영국, '인종 편향적' 비자 신청 처리 알고리즘 사용 중단

[관련기사] 사진만으로 범죄자 예측?…AI 편향성 논란 재점화