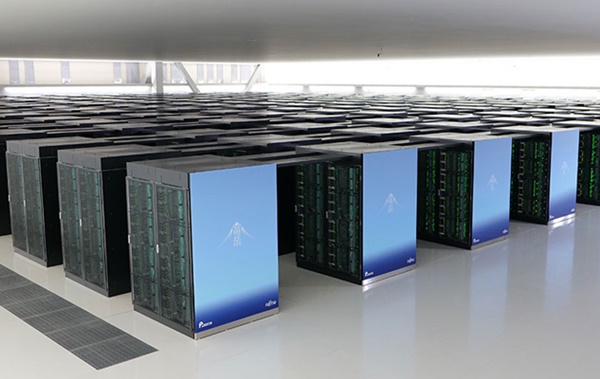

올해 상반기에 이어 하반기에도 세계최고 성능 슈퍼컴은 일본 후지쯔가 만들어 리켄 계산과학연구센터에 설치한 후가쿠(富岳·후지산)슈퍼컴이었다. 그러나 최근 뜨는 새로운 평가 기준으로는 세계 14위 슈퍼컴 ABCI가 1위를 차지했다. 그 기준이란 인공지능(AI)모델 훈련을 얼마나 단시간 내에 달성하느냐다. 점점 더 많은 과학분야 컴퓨터에서 AI 신경망을 얼마나 빨리 훈련시켜 이를 통해 성과를 내도록 할 수 있는지가 중요해진 데 따른 새로운 슈퍼컴 평가 기준인 ML퍼프(MLPerf) 벤치마크테스트(BMT)다.

HPC와이어·지디넷 등은 18일(현지시각) 전세계 상위 슈퍼컴퓨터들이 가장 정교한 과학 연구 문제 해결을 위해 점점 더 많이 AI 신경망을 통합하고 있으며, 이에 ML퍼프 BMT가 슈퍼컴 성능 평가의 주요 기준으로 급부상했다며 주목했다.

이러한 노력은 슈퍼컴퓨터가 전통적인 과학 문제 계산에 점점 더 딥러닝 형태의 AI를 통합하고 있다는 사실을 반영한다. 세계적 고성능 슈퍼컴들은 자신의 컴퓨팅 시간을 측정할 수 있는 자체 테스트 세트를 갖게 됐다.

이와 관련, AI의 서브세트인 머신러닝(기계학습)을 실행하는 데 걸리는 시간을 측정하는 이 분야 업계 컨소시엄 ML퍼프(MLPerf.org)가 18일 기계학습 과제를 실행하는 고성능컴퓨터(HPC) 시스템을 위한 첫 시험 결과를 발표했다.

이로써 새로운 ML퍼프 BMT는 기존의 두 벤치마크 테스트, 즉 일반 서버 시스템에 대한 기계학습 훈련 측정 결과와 서버 및 모바일 장치 상에서 기계학습 추론 및 예측을 측정한 결과와 함께 새로운 슈퍼컴 성능 평가 기준에 합류했다.

데이비드 칸터 ML퍼프 대표는 “우리는 사람들이 기계학습 훈련을 잠재적인 HPC 작업 부하, 또는 그것과 연계되거나, 그것을 구성하는 요소로 보기 시작했을 때 (ML퍼프같은) 더 과학적인 작업부하가 없다는 점을 놓치고 있다는 것을 알았다”고 말했다.

◆슈퍼컴에 대한 ML퍼프 테스트는?

이 테스트를 설계한 ML퍼프 직원들은 18일 미국 샌디에이고에서 열리는 슈퍼컴퓨팅행사인(SC20)에서 이 노력을 반영하기 위한 가상 세션을 열었다.

이 시험은 특히 슈퍼컴퓨터가 코스모플로(CosmoFlow)와 딥캠(DeepCAM)이라는 두 가지 과제를 숙련되게 딥러닝 네트워크를 훈련하는 데 얼마나 많은 시간(몇 분)이 걸리는지를 측정한다.

인텔, HPE 크레이 사업부, 미국 에너지부 국립에너지연구과학컴퓨팅센터(NERSC)가 협업해 만든 코스모플로는 3차원 합성곱 신경망(CNN)을 이용해 우주의 우주적 매개 변수를 결정한다.

엔비디아와 로렌스 버클리 국립연구소(LBN), 오크리지 국립연구소(ORNL)가 협업해 만든 딥캠(DeepCAM)은 ‘극한’ 기상현상을 예측하는 법을 배우는 영상분할 신경망 애플리케이션이다.

새로운 BMT 추진력의 일부는 슈퍼컴을 사용하는 연구소로부터 나왔다. 이들은 칩 제조업체인 인텔, 엔비디아, AMD 칩을 포함하는 슈퍼컴퓨팅 장비 공급업체들이 판매하는 모든 기술 사양을 시험하기 위해 BMT를 원했다.

칸터 대표는 “입찰, 품질평가, 승인시 ML퍼프 훈련을 활용하는데 관심가진 슈퍼컴퓨팅 센터 두어 곳의 연락을 받았다”고 말했다. 그는 “총 10억 달러(약 1조1160억 원)가 넘는 규모의 슈퍼컴 입찰 과정에서 ML퍼프 구성요소가 사용됐다”고 말해 ML훈련 시간이 슈퍼컴 성능 평가의 주요 요소로 떠올랐음을 시사했다.

ML퍼프 BMT에 참여한 시스템에는 올해 하반기 세계 상위 500대 슈퍼컴퓨터 1위에 오른 세계 최고속 슈퍼컴인 후지쯔의 후가쿠와 세계 9위 슈퍼컴인 텍사스대 텍사스단컴퓨팅센터에 있는 프론테라-RTX(세계9위)도 포함돼 있다.

◆ML퍼프 기준은 “얼마나 짧은 시간내에 정확도 달성하는가”

이 ML퍼프 BMT는 측정 방식에 대한 일부 변화를 수용해야 했다.

서버컴퓨터에서의 ML퍼프 훈련은 초당 처리 가능한 이미지 수를 일반적 평가 기준으로 삼아 더 많은수록 더 좋지만, 이와 달리 슈퍼컴퓨터 상의 ML퍼프 과제는 정확도에 도달하기 위한 실제 시간을 계산하는데, 수치가 더 작을수록(시간이 짧을수록) 더 좋다.

BMT결과 코스모플로 문제 해결을 위한 신경망 개발 최소 시간은 13분이었다. 이를 달성한 슈퍼컴은 기존 기준으로 세계 14위 연산능력을 가진 일본 산업기술총합연구원(AIST)가 보유한 AI브리징클라우드인프라컴퓨터(ABCI)였다. 이 슈퍼컴은 인텔 제온 CPU 1024개와 엔비디아 V100 GPU 2048개를 조합해 만들어졌다. 컴퓨팅 성능의 절반을 사용하는 두 번째 ABCI 시스템은 딥캠에서 영상 분할 작업을 훈련 시간을 가장 빠른 10분 30초 만에 마쳤다.

◆벤치마크 보고시간에 슈퍼컴 작업시 입출력 소요 시간도

그러나 슈퍼컴퓨터의 본질, 그리고 그들의 작업과 관련해 좀 더 구체적인 변화들이 있다.

예를 들어 입력-출력은 결과에 더 큰 영향을 미칠 수 있기 때문에 슈퍼컴퓨터 벤치마크에서 더 신중하게 측정되어야 한다. 스티브 패럴 ML퍼프 공동대표이자 NERSC의 기계학습 엔지니어는 “우리는 대규모 HPC 시뮬레이션에서 나올 수 있는 대형 과학 데이터 세트, 복잡한 데이터 구조, 시공간 데이터 세트를 가지고 있다. 이미지넷(ImageNet)과 같은 일반적인 ML퍼프 과제에 대한 테스트와는 다르다”고 말했다.

패럴은 “데이터 이동, 그 부분의 이야기는 HPC에 매우 중요하다”고 말했다. 그는 “코스모플로와 딥캠은 각각 5테라(1테라=약 1조·1024기가)바이트와 9테라바이트의 데이터 세트를 가지고 있다”고 말했다. 그는 “우리가 규칙에 추가한 것은 일반 파일 시스템에서의 모든 데이터 이동이 벤치마크 보고 시간에 포함돼야 한다는 것이며, 우리는 준비 과정에서 소요된 시간을 포착해냈다”고 말했다.

- 네이버 AI 연구소장 하정우 “GPT-3 규모 AI 만들겠다”

- 엔비디아+Arm, 18개월간 HPC 성능 26배 향상…'Arm 인수 성공적?'

- 엔비디아, 메모리 2배↑ 슈퍼컴퓨팅용 GPU ‘A100 80GB GPU’ 공개

- 日 '후가쿠' 세계 최고 슈퍼컴 등극

- 과기정통부 AI 그랜드 챌린지, 운영ㆍ평가 방식 미숙 논란 ...참가자들 공정성 문제 잇따라 제기

- [특별 기획] AI, 저널리즘을 부탁해! ③ : 외근(취재)부서의 명암

- [2020 결산] 주목할만한 AI업계 10대 인수합병 뉴스

- [AWS 리인벤트] '인텔 CPU+엔비디아 GPU' 서버 시스템 공식 바꾼 AWS