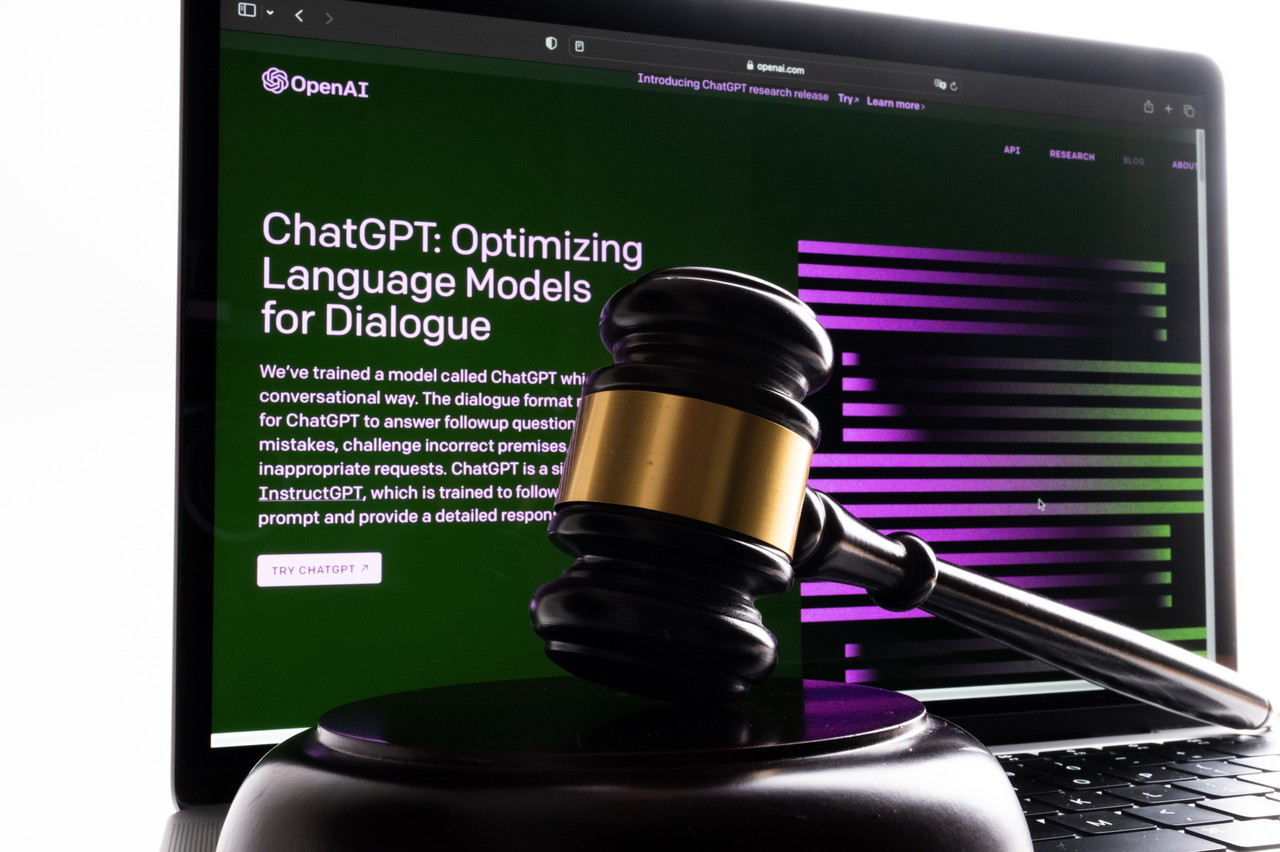

챗GPT 개발을 주도한 오픈AI의 최고기술책임자(CTO) 입에서 "챗GPT를 규제해야 한다"는 경고의 메시지가 나왔다. 매우 이례적인 일이라 그 배경에 관심이 모아진다.

포춘과 타임지 등 외신이 5일(현지시간) "챗GPT와 같은 제품은 너무 강력해 사회에 미치는 영향이 매우 심할 것이기 때문에 규제 당국이 개입해야 한다"는 미라 무라티 오픈AI CTO의 말을 타전했다.

이와 관련해서는 오픈AI도 동일한 입장을 표명했다. 규제에 모두가 동참해야 한다는 내용이다.

챗GPT가 가져올 파급력이 오픈AI 혼자서는 감당하지 못할 정도로 크니 사회에 규제의 틀을 만들어 달라는 요청으로 읽힌다. 사전에 책임을 나누자는 의도다.

실제로 무라티 CTO는 "인공지능(AI)을 책임있는 방식으로 대중에게 제공해야 하는데 우리는 소수이고 AI 시스템에는 기술을 넘어서는 정보가 훨씬 더 많이 필요하다"면서 "AI 시스템이 가져올 사회적 영향에 대해 철학자, 사회과학자, 예술가, 인문학자들의 다양한 목소리를 끌어들이는 것이 중요하다"고 말했다.

챗GPT와 관련한 규제 논의가 너무 이르다고 생각하지 않느냐는 질문에는 "이르지 않다"고 단언했다. 모든 사람이 참여하기 시작하는 것이 중요하다는 것이다.

챗GPT 기능이 강력한 만큼 사회에 미칠 부작용이나 악용 위험을 우려하는 목소리도 많았다. 사이버 공격에 사용될 것이라는 경고가 있었고, 허위정보 확산 도구로 악용될 수있다는 지적도 나왔다.

특히 챗GPT 스스로도 자체 결함을 인정하고 어떤 형태로든 적절한 규제가 필요하다는 답변을 내놓기도 했다.

유럽연합(EU)의 산업 부문 집행위원인 피에르 브루통이 AI 규제를 위한 법안에서 챗GPT를 둘러싼 위험을 시급하게 다뤄야 한다고 지적했다. 로이터가 지난주말 전한 뉴스다.

EU는 AI 규제를 위한 법 제정을 추진하고 있지만 이처럼 고위 관리가 챗GPT를 콕 짚어 규제가 필요하다고 발언한 것은 처음이다.

그는 "챗GPT 사례가 보여주듯이 AI 솔루션은 기업과 일반인들에게 큰 기회를 제공하는 반면 위험도 노출한다"면서 "이것이 신뢰할 만한 AI를 구축하기 위해 견고한 규제 틀이 필요한 이유"라고 말했다.

EU가 법제화 절차를 밟고 있는 AI법안에 의거하면 챗GPT는 고위험 AI로 분류된다. 법안은 AI를 위험도에 따라 분류해 위험도별로 규제한다. 고위험 AI는 다양한 목적으로 광범위하게 사용될 수 있는 도구로, 자칫하면 많은 사람에게 해를 끼칠 수 있는 AI다.

브레통 위원은 오픈AI에 고위험 AI에 부과되는 규제를 챗GPT 채택 기업들이 지킬 수 있도록 긴밀한 협조를 당부했다.

정병일 위원 jbi@aitimes.com