대다수 인공지능(AI) 알고리즘이 여성의 몸이 드러나는 이미지를 무조건 선정적이라고 평가하는 경향이 짙은 것으로 확인됐다.

이로 인해 소셜미디어에서 여성 신체가 포함된 이미지 노출이 억제되는 등 피해가 우려된다. 여성에 대한 편견이 반영된 결과라는 지적도 나오고 있다.

가디언은 8일(현지시간) 뉴욕대학교 힐케 쉘만 교수가 AI기업 대표인 지안눌카 마우로와 구글 및 마이크로소프트(MS) 등이 개발한 AI 알고리즘의 선정성 평가 기준을 시험해 본 결과 이같은 편견을 발견했다고 보도했다.

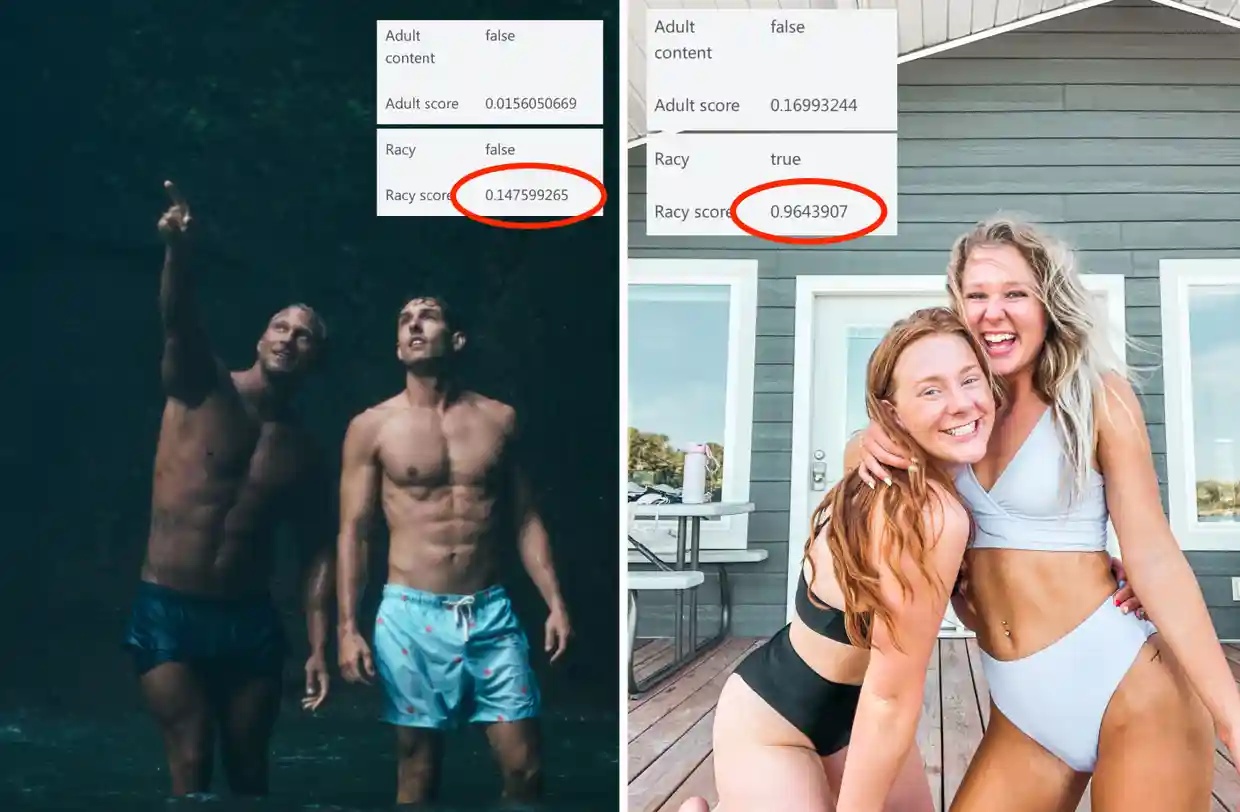

쉘만 교수 등은 속옷을 입고 운동하는 남녀 사진 수백장과 유방암 진단을 받는 여성의 상반신이나 임산부의 배와 같이 신체 노출이 있는 의료 사진을 데이터로 활용했다. 실험 결과 AI 도구들은 여성 사진을 모두 선정적이라고 판단했다.

바닷가에서 긴바지와 브래지어를 착용하고 스트레칭 자세를 취한 여성 사진을 두고 구글 AI는 5점 척도에서 가장 높은 5점을 매겼고, MS AI는 98% 선정적이라고 평가했다.

반면 실내에서 상반신을 드러내고 운동하는 남성 사진에 대해서는 각각 3점과 3%라고 결과값을 내놓았다.

또 실험자인 마우로가 직접 긴 바지를 입고 상체를 드러낸 채 사진을 찍었을 때 MS의 알고리즘은 선정성을 22% 미만으로 평가했으나, 브래지어를 착용하자 97%로 높아졌다. 브래지어를 실험자 옆에 둔 사진에 대해선 99%로 평가했다.

실험자들은 이런 알고리즘을 활용하는 소셜 미디어들이 여성의 신체가 포함된 이미지에 대해 ‘그림자 금지(shadowbanning)’ 기능으로 노출을 억제한다는 사실도 확인했다. 그림자 금지는 게시자에게 알리지 않고 콘텐츠 노출을 억제하는 것을 말한다.

예를 들어 실험자들이 소셜 미디어의 하나인 링크드인에서 속옷을 입은 여성과 남성의 사진을 시험삼아 올리자 1시간 동안 여성 사진은 조회사가 8회에 그친 반면 남성 사진은 655회를 기록했다.

이런 그림자 금지의 피해 사례는 많다. 호주의 사진작가인 벡 우드는 인스타그램에 모유 수유 등 어머니와 자녀간의 친밀한 모습을 보여주는 장면을 찍은 작품들을 2018년부터 올렸으나 이내 게시 금지 통보를 받았다. 그는 이에 따라 사진을 자체 검열하게 됐다고 불만을 토로했다.

영국에서 폴 댄스 강사와 대학 연구원으로 일하는 캐롤리나 아레는 인스타그램을 통해 댄스 교습 회원을 모집해 왔으나 2019년부터 자신의 사진이 일부 삭제되거나 해시태그로 검색되지 않는 사실을 발견했다.

그는 자신은 물론 소셜 미디어로 작품을 판매해 생계를 이어가는 장애인과 같은 이들에게 이런 그림자 금지는 큰 피해를 입힌다고 강조했다.

AI 개발회사인 허깅페이스의 마가렛 미첼 수석 윤리과학자는 기술대기업이나 소셜 미디어가 활용하는 이런 알고리즘이 사회적 편견을 재현하고 있다고 말했다. 그는 “여성이 남성보다 자신을 더 많이 가려야 한다는 생각이 들게 할 수 있고 이는 다시 여성에게 사회적 압력을 가하게 된다”고 알고리즘의 폐해를 지적했다.

정병일 위원 jbi@aitimes.com