모레(대표 조강원)가 'moreh/MoMo-72B-lora-1.8.7-DPO' 모델로 글로벌 오픈 LLM 리더보드에서 장기간 상위권을 지키고 있다.

이 모델은 지난 몇달 간 10위권에 랭크됐다. 21일 기준으로는 11위다.

또 지난 1월에는 이전 버전인 1.8.5, 1.8.6 모델로 허깅페이스 1~2위를 나란히 차지한 바 있다. 올해 들어 6개월 간 글로벌 리더보드 상위권을 차지한 셈이다.

모델 개발에는 모레의 머신러닝(ML) 엔지니어 두명이 나섰다. 모델 학습 방법론 탐색, 적용, 실험 및 개선 등을 거쳤다. 이어 ML 시스템 엔지니어 세명이 빠르고 간편한 ML 시스템 개발을 위해 추가 작업을 진행했다.

특히 AMD GPU에서 자체 개발한 ML 프레임워크 및 시스템을 개발하고 있다. 오픈AI에서도 ML 프레임워크와 시스템을 자체 개발해 사용하는 만큼, 이는 중요한 요소라고 덧붙였다. 이어 세계적인 수준의 시스템 엔지니어 인력을 보유한 것이 고성능 AI 모델 제작의 비결이라고 밝혔다.

모델 훈련에는 독자적 인공지능(AI) 트레이닝 플랫폼 '모아이(MoAI)'를 사용했다.

구체적으로는 '가독미세조정(SFT)' 기법을 먼저 사용해 1차적인 성능 향상을 확보한 뒤 '직접선호최적화(DPO)' 방법론을 적용했다고 전했다.

모레 관계자는 "장기간 글로벌 차트 상위권에 오른 것보다, '라마3'가 등장하기 전까지 리더보드 상위 모델들이 전부 모레의 독자 모델(MoMo)을 기반으로 만들어졌다는 것이 흥미로웠다"라고 소감을 전했다.

한편 모레는 현재 모델 개발 역량을 바탕으로 고성능 한국어 대형언어모델(LLM), 의료특화 LLM, 법률특화 LLM 등을 개발 중에 있으며, 곧 서비스할 예정이다.

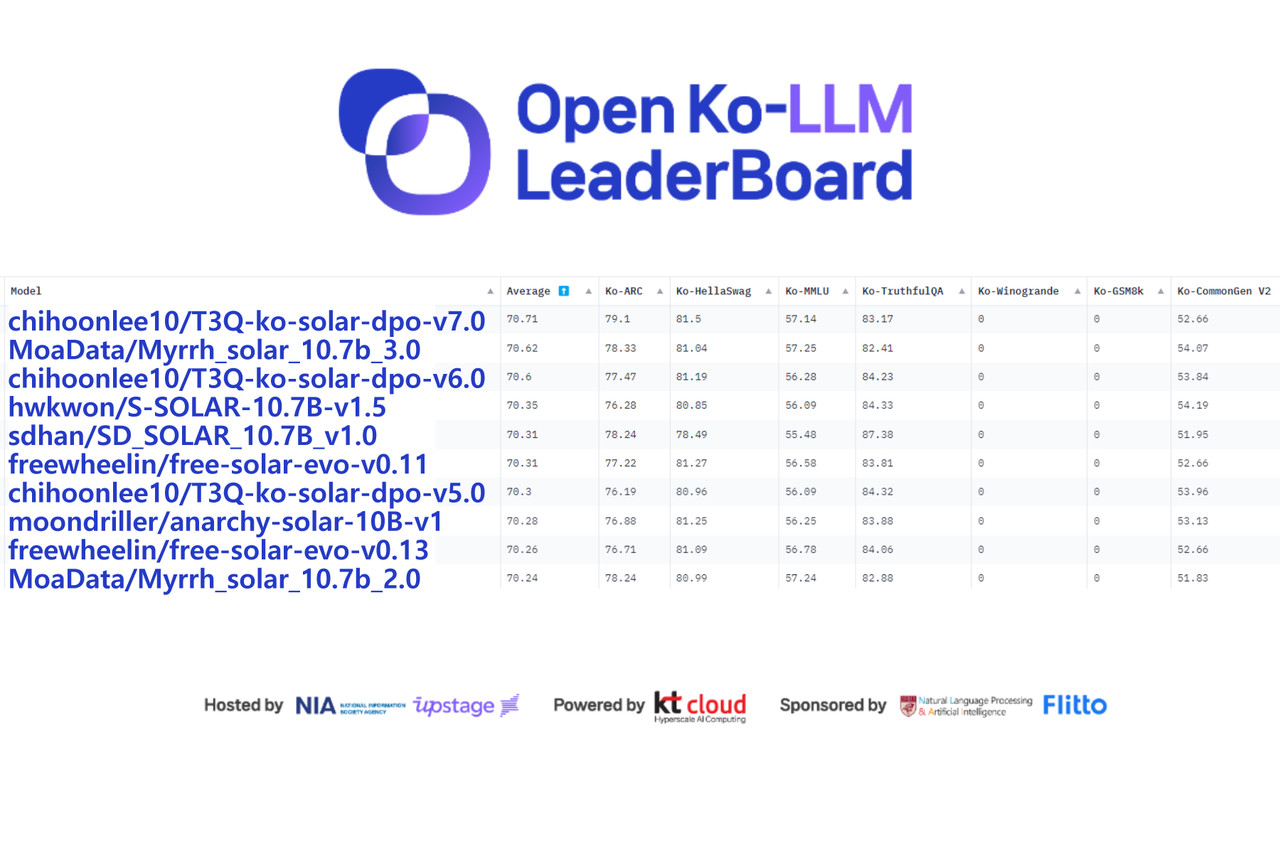

한편 국내 오픈 Ko-LLM 리더보드는 여전히 상위권 안정세를 보이고 있다.

새로운 평가지표 항목 두개가 추가된 상태로, 아직 점수 집계는 진행되지 않았다. 이후 새 점수가 추가되면 국내 리더보드에도 순위권 변동이 대폭 이뤄질 전망이다.

장세민 기자 semim99@aitimes.com