LG AI연구원(원장 배경훈)이 추론 인공지능(AI) 모델 ‘엑사원 딥(EXAONE Deep)’을 18일 공개했다.

자체 추론 모델은 오픈AI와 구글, 중국 딥시크와 알리바바 등 파운데이션 모델을 보유한 소수의 기업만이 자체 추론 AI를 개발하고 있다고 강조했다. 엑사원 딥은 이들과 경쟁할 수 있는 국내 첫 모델이라는 설명이다.

‘엑사원 딥-32B’는 매개변수 6710억개인 '딥시크-R1'의 5% 규모 만으로도 우수한 성능을 보였다고 설명했다.

복잡한 수학 문제(AIME 2024, AIME 2025)에서는 R1을 능가하거나 동등한 성능을 보였다. 2025학년도 수능(CSAT 2025) 수학 영역에서 94.5점으로 최고점을 기록했으며, 선택과목(확률과 통계, 미적분, 기하) 모두에서 1등급을 달성했다.

물리학, 화학, 생물학 등 박사 수준의 과학 추론 능력을 평가하는 지표(GPQA)와 코딩 능력을 평가하는 라이브코드벤치에서는 R1에 뒤졌다.

LG AI연구원은 엑사원 딥이 수학과 과학, 코딩 등 전문 분야 평가 지표에서 높은 성능을 보인 만큼 각종 연구와 교육 현장에서 활용도가 높아질 것으로 기대하고 있다.

특히 엑사원 딥-32B는 오픈 소스 공개와 동시에 미국 비영리 AI 연구 기관인 에포크(Epoch) AI 선정 '주목할 만한 AI 모델(Notable AI Models)' 리스트에 등재됐다.

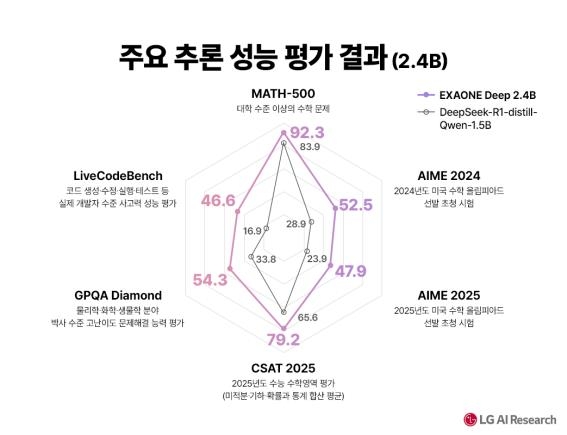

한편, 이날에는 소형언어모델(sLM) ‘엑사원 딥-7.8B’과 온디바이스용 ‘엑사원 딥-2.4B’도 오픈 소스로 공개했다.

sLM은 32B의 24% 정도 크기로도 성능을 95%까지 유지하며, 온디바이스 모델은 7.5% 크기에 성능은 86%에 달한다고 강조했다. 높은 경제성과 실용성을 동시에 갖췄다는 설명이다.

LG AI연구원 관계자는 “지난달 국가인공지능위원회에서 열린 간담회에 참석해 조만간 딥시크-R1 수준의 모델을 오픈 소스로 공개한다고 예고한 뒤 1달여 만에 엑사원 딥을 발표했다”라며 “LG AI 기술의 핵심은 모델 크기를 줄이면서도 성능을 유지하는 것”이라고 말했다.

실제로 sLM 7.8B의 성능은 오픈AI의 'o1-미니'의 성능을 상회했으며, 온디바이스 모델 2.4B도 동급 모델 중 세계 최고 수준의 성능을 보였다는 설명이다.

또 온디바이스 모델은 보안과 개인정보 보호 측면에서 강점이 있기 때문에 휴대폰과 자동차, 로봇 등 다양한 산업에서 활용될 것으로 전망했다.

LG AI연구원은 LG전자와 LG유플러스 등 계열사들과 모델을 고도화, 온디바이스 AI 시장을 주도해 나갈 예정이라고 밝혔다.

장세민 기자 semim99@aitimes.com