알리바바 최초의 매개변수 1조개 이상 모델로 화제를 모았던 '큐원3-맥스(Qwen3-Max)'가 정식 출시됐다. 미리보기(preview) 출시 당시 예고한 대로 각종 벤치마크에서 오픈AI 나 앤트로픽, xAI 등 폐쇄형 모델들과 맞먹거나 능가하는 첨단 성능을 보였다.

알리바바는 24일 자체 모델 중 최대 규모이자 가장 강력한 모델인 큐원3-맥스를 출시했다고 발표했다. '큐원3-맥스-인스트럭트'의 미리보기 버전이 공개된 지 18일 만이다.

이 모델은 전작과 달리, 오픈 소스가 아니다. 최근 메타가 밝혔듯, 알리바바도 첨단 성능의 플래그십 모델은 폐쇄형으로 출시하겠다는 의도를 나타낸 것으로 볼 수 있다.

이번에 공개된 정식 버전은 파운데이션 모델인 '큐원3-맥스-베이스(Qwen3-Max-Base)'를 바탕으로 한다.

이를 통해 비추론 모델인 '큐원3-맥스-인스트럭트(Qwen3-Max-Instruct)'와 추론 모델인 '큐원3-맥스-싱킹(Qwen3-Max-Thinking)' 2가지를 개발했다. 인스트럭트 버전은 짧은 지연 시간으로 채팅이나 코딩에 집중했으며, 싱킹은 도구 호출을 강화해 에이전트 사용 사례를 겨냥한 것이다.

이번에 출시된 인스트럭트 정식 버전은 큐원 챗이나 API를 통해 사용할 수 있다. 싱킹 버전은 아직 개발을 마치지 않았다.

이 중 베이스 모델은 1조개 이상의 매개변수를 갖췄으며, 36조개의 토큰으로 사전 학습했다.

기존 큐원3 시리즈처럼 전문가 혼합(MoE) 방식을 채택했으며, 학습 안정성과 효율성을 강화했다. 또 새니티체크(SanityCheck), 이지체크포인트(EasyCheckpoint), 스케줄링 파이프라인 최적화 등 기법을 통해 대규모 클러스터에서 하드웨어 장애로 인한 시간 손실을 '큐원2.5-맥스' 학습 시 발생했던 시간의 5분의 1로 줄였다고 전했다. 활용한 AI 칩에 대한 언급은 없다.

컨텍스트 창도 캐싱을 통해 최대 26만2000(262K) 토큰까지 지원, 대규모 문서와 코딩 처리가 가능하다고 밝혔다.

앞서 선보인 인스트럭트 버전의 미리보기는 현재 LM아레나의 텍스트 부문 리더보드에서 '제미나이 2.5 프로'와 '클로드 오퍼스 4.1' 등에 이어 8위를 기록 중이다. 'GPT-5-챗(비추론 모드)'나 '클로드 오퍼스 4-싱킹'보다 앞서 있다.

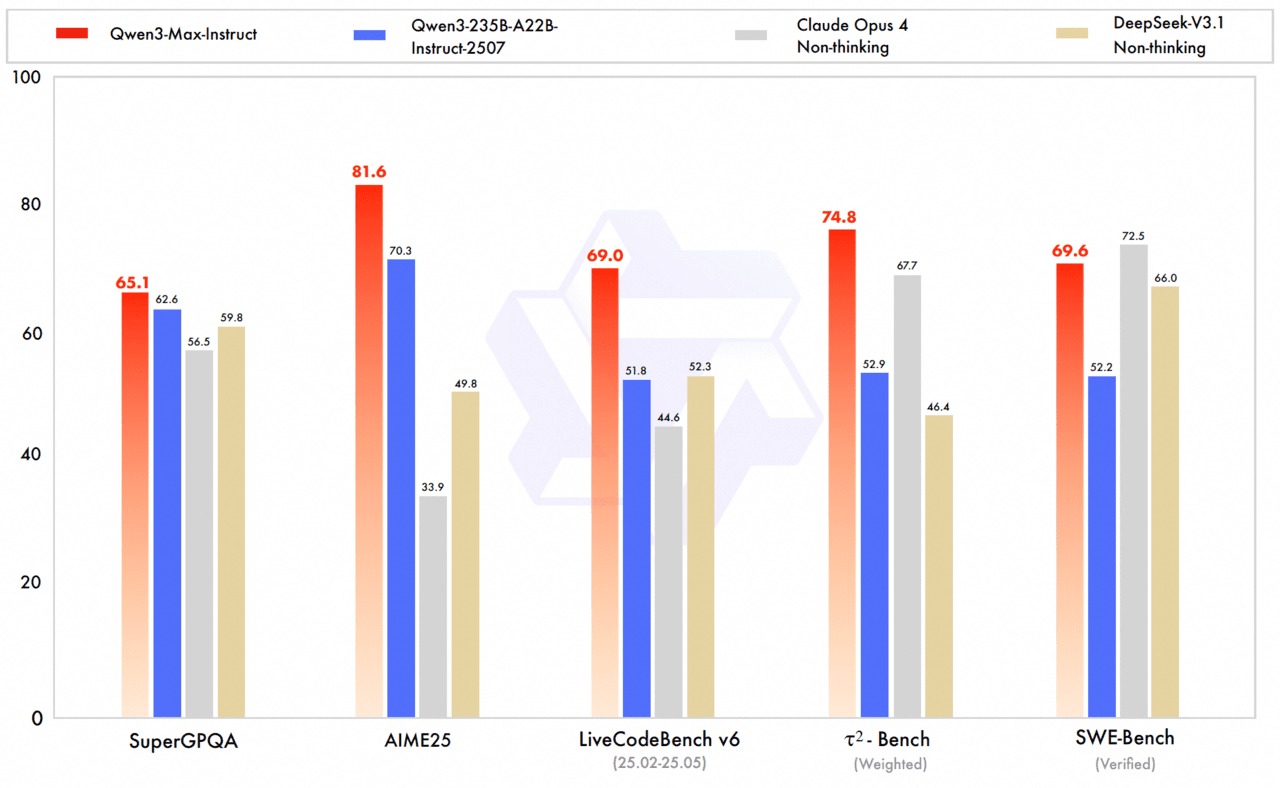

정식 인스트럭트 버전은 코딩과 에이전트 성능이 향상됐다고 강조했다.

실제로 코딩 성능을 테스트하는 'SWE-벤치 베리파이드'에서 69.6점으로, 클로드 4 오퍼스(72.5점)에 뒤진 2위를 차지했다. 에이전트 도구 호출 능력을 평가하는 '타우2-벤치(Tau2-Bench)'에서는 클로드와 '딥시크 V3.1'을 모두 넘어섰다.

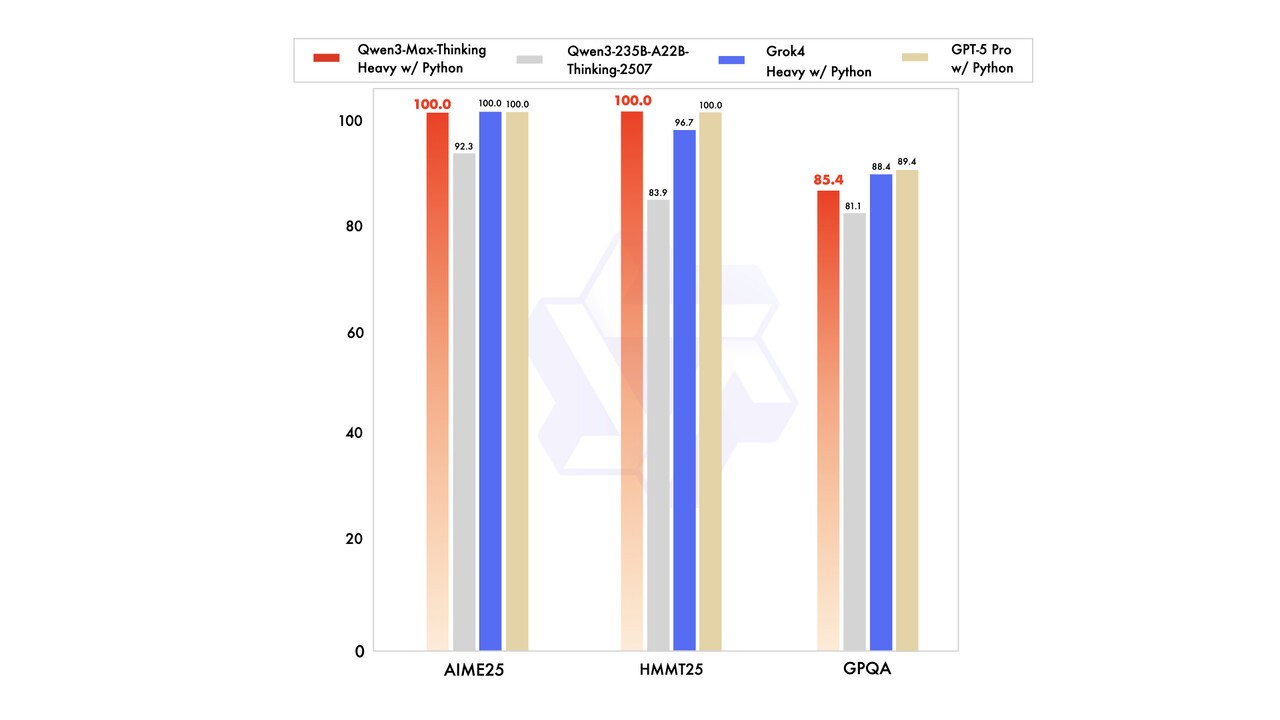

현재 추가 학습이 진행 중인 싱킹 버전의 벤치마크도 공개했다. 수학 벤치마크인 'AIME25'와 'HMMT'에서 100%의 정확도를 달성했다. 이는 '그록-4'나 'GPT-5 프로'와 같거나 일부 앞서는 성적이다. 알리바바는 "싱킹 버전은 현재 집중적인 교육이 진행 중이며, 곧 선보일 수 있기를 기대한다"라고 덧붙였다.

출시된 지 몇시간이 지나지 않은 관계로, 아직 커뮤니티의 본격적인 평가는 등장하지 않았다. 그러나 이전 큐원 시리즈의 성능이나 벤치마크 결과를 감안하면, 이번에는 오픈AI나 앤트로픽 첨단 모델을 따라잡았을 것이라는 기대가 많다.

한편, 알리바바는 이날 브라질과 프랑스, 네덜란드에 첫번째 데이터센터를 열 계획이라고 밝혔다. 내년에는 국내를 비롯해, 멕시코와 일본, 말레이시아, 두바이로 시설을 확대할 계획이라고 덧붙였다. 앞으로 3년간 AI 인프라에 3800억위안(534억달러)을 투자할 계획이다.

또 데이터 합성 및 처리, 모델 학습, 환경 시뮬레이션 강화 학습 및 모델 검증 테스트를 포함하는 피지컬 AI를 개발하기 위해 엔비디아와 파트너십을 체결했다고 발표했다.

알리바바는 하루 전인 23일 단일 모델에서 텍스트, 이미지, 오디오, 비디오를 동시에 처리할 수 있는 ‘큐원3-옴니(Qwen3-Omni)’를 공개한 바 있다. 이는 오픈 소스에서 거의 최초로 출시된 옴니 모델로, 한국어를 포함한 119개 텍스트와 19개 음성 입력, 10개 음성 출력을 지원한다.

특히, 3B 매개변수에 불과해 휴대폰이나 스마트 안경 등에 탑재하기에 적당하다.

임대준 기자 ydj@aitimes.com