인공지능(AI) 에이전트가 과거 경험에서 얻은 유용한 전략과 추론 정보를 메모리에 저장해 반복 활용할 수 있도록 개발된 메모리 프레임워크가 공개됐다.

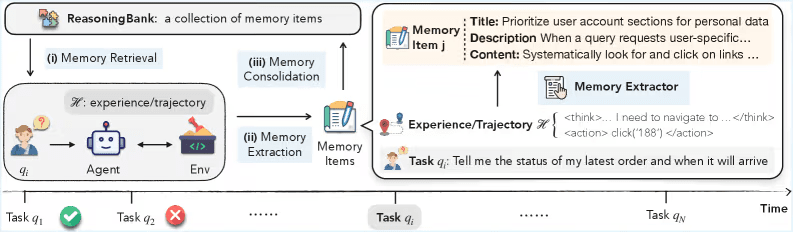

구글 클라우드와 일리노이대학교 어바나-샴페인 캠퍼스 연구진은 9일(현지시간) 대형언어모델(LLM)이 경험을 체계적으로 저장하고 활용할 수 있는 새로운 메모리 프레임워크 ‘리즈닝뱅크(ReasoningBank)’를 온라인 아카이브를 통해 공개했다.

이 기술은 에이전트가 시간이 지남에 따라 복잡한 과제를 더 효율적으로 해결하도록 돕는다.

에이전트의 문제 해결 시도에서 성공과 실패를 모두 분석해 일반화 가능한 추론 전략을 추출한다. 새로운 과제를 수행할 때 에이전트는 이 메모리를 활용해 과거 실수를 반복하지 않고, 더 나은 의사결정을 내릴 수 있다.

또 MaTTS(Memory-aware Test-Time Scaling)이라는 기법을 제안했다. 이는 다중 시도를 통해 다양한 경험을 생성하고, 이를 리즈닝뱅크에 저장함으로써 메모리 품질을 향상하는 방식이다. 기존 테스트-타임 스케일링은 독립적 시도만 반복했지만, MaTTS는 경험 간 비교와 반복 학습을 통해 더 효율적이고 풍부한 추론 전략을 확보할 수 있다는 설명이다.

리즈닝뱅크를 통해 에이전트는 새 과제를 수행할 때 관련 메모리를 검색해 시스템 프롬프트에 삽입하고, 과제 수행 후 새로운 경험을 추출해 메모리에 추가한다.

이 과정이 반복되면, 에이전트는 점차 능력이 향상된다. 예를 들어, 특정 제품 검색에서 실패한 에이전트는 리즈닝뱅크를 통해 검색 쿼리 최적화나 카테고리 필터링 전략을 학습하고, 비슷한 과제에 적용할 수 있다.

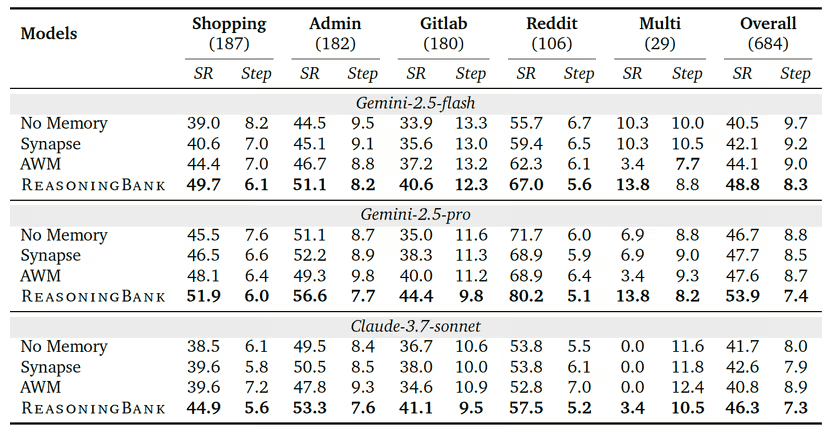

연구진은 웹 브라우징 능력을 테스트하는 '웹아레나(WebArena)'와 소프트웨어 엔지니어링 벤치마크 'SWE-벤치 베리파이드(SWE-Bench-Verified)'에서 구글의 '제미나이 2.5 프로', 엔트로픽의 '클로드 3.7 소네트' 등 모델을 활용해 이 프레임워크를 테스트했다.

실험 결과, 리즈닝뱅크는 모든 데이터셋과 LLM 백본에서 우수한 성능을 보였다.

웹아레나에서는 기존 메모리 기반이나 메모리 없는 에이전트보다 성공률이 최대 8.3% 향상됐으며, 복잡하고 도메인이 다른 과제에서도 높은 일반화 능력을 보였다. MaTTS와 결합하면 성능이 더 강화, 필요 작업 단계 수를 줄여 운영 비용 절감 효과도 나타났다.

연구진은 “리즈닝뱅크와 MaTTS는 경험 기반 자기 진화 학습의 새로운 차원을 제시하며, 장기 운영 AI 에이전트 구축에 실용적인 길을 제공한다”라고 강조했다.

또 “에이전트가 개별 과제에서 학습한 모듈형 기술을 조합해 더 복잡한 작업을 스스로 수행할 수 있는 미래가 가능하다”라고 덧붙였다.

한편, LLM의 역할이 과거 단답형에서 이제는 복잡한 작업으로 구성된 에이전트로 확대되며, 메모리를 통한 성능 향상 연구가 활발해지고 있다.

최근에는 인도 출신 19세 개발자가 AI 애플리케이션을 위한 장기 기억 솔루션으로 300만달러(약 42억4000만원)의 프리 시드 투자를 유치한 사실이 화제가 됐다.

박찬 기자 cpark@aitimes.com