신뢰(Trust)ㆍ친절(Kindness)ㆍ팩트(fact)는 검색시장 IT기업들의 지향점이지만, 수익성 앞에 외면 받아온 가치이기도 하다. 광고 수익에 기반한 구글과 검색 시장에서 겨루겠다는 당돌한(?) 스타트업이 등장했다.

"근본적으로 구글이 할 수 없는 방법(구글이 버릴 수 없는 광고 수익 모델을 선택하지 않음)을 채택함으로써 혁신기업의 창조적 파괴를 구현하겠다."고 포부를 밝힌 “YOU.COM 창업자 리처드 소처(Richard Socher).

소처는 스탠포드대 컴퓨터 공학박사 출신으로 클라우드 컴퓨터 솔루션 제공 업체 세일즈포스(Salesforce) 전 수석 과학자로 활동하며 인공지능 기반 CRM 플랫폼 아인슈타인AI 개발 프로젝트를 이끌어 왔다.

그는 지난 7월 "오랫동안 꿈꿔온 비전을 위해 새로운 회사를 차릴 것"이라는 트윗과 함께 퇴사했고, 9일(현지 시간) “새로운 인터넷을 만들자”며 구글을 겨냥한 검색 엔진 개발을 발표했다.

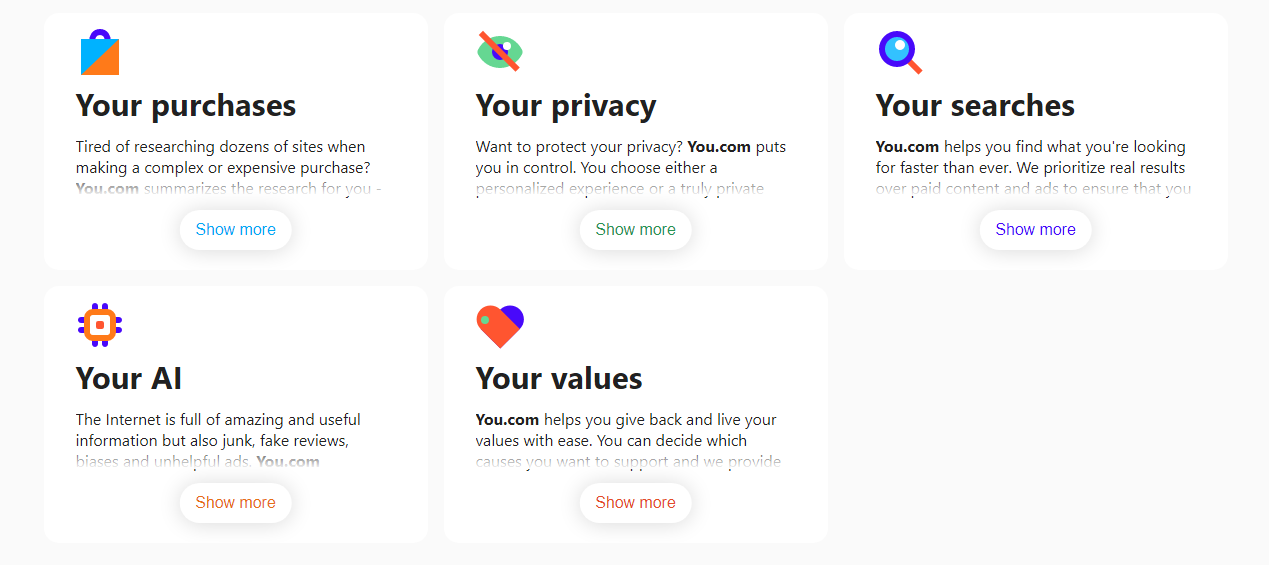

YOU.COM은 구글 검색엔진과는 다른 방향을 추구한다. 광고와 사용자 정보와 데이터에 의존하지 않는 새로운 검색 서비스를 제공한다는 것.

소처는 미 테크 전문 미디어 테크크런치(TechCrunch)와의 인터뷰를 통해 “우리는 YOU.COM을 개발 중이다. 오늘부터 접속할 수 있다. 믿을 수 있는 검색엔진이다. 우리는 클릭 유도가 만연하지 않고 안심하고 클릭할 수 있는 인터넷을 만들기를 목표한다.”고 밝혔다.

그는 "박힌 돌을 빼는 게 어려울 것"이라고 전제하면서도 "SNS를 통한 무분별한 가짜뉴스 공유와 편향 강화 문제 해결을 위해 개인별 URL 부여 등 정확성과 신뢰도를 높이는 새로운 기술을 강구 중”이라고 말했다.

https://t.co/2tfrBwhwOc

— Richard Socher (@RichardSocher) December 8, 2020

Let's build a new internet together.

YOU.COM을 개발하게 된 이유는 ▲인터넷 초심자들에게는 너무 많은 정보가 제공되지만 누구도 그 많은 정보를 한 번에 처리할 수 없고 ▲그 많은 정보가 정확하고 믿을 수 있는지 알 방법이 없으며 ▲편의성을 높이기 위한 개인정보 공개를 어느 수준까지 허용할 것인가 등 난제를 해결하기 위해서라고 설명했다. 그는 "인공지능과 자연어처리 기술을 활용한 소비자 중심의 검색엔진은 이 문제를 해결할 수 있을 것“이라고 자신했다.

한편 YOU.COM 사이트 개설 발표를 접한 누리꾼들은 "도메인이 멋지다, 입사지원 하겠다", "언제 상장(IPO)하냐?" 등 칭찬과 격려가 줄을 이었다. 반면, "신뢰 친절 등 모두 정말 좋지만 돈은 어디서 구하나" 등 수익성에 의구심을 갖는 의견도 속출했다.

이에 대해 소처는 “세일즈포스의 창업자 마크 베니오프로부터 사람들의 신뢰를 얻으며 돈을 벌 수 있다는 사실을 배웠다”고 답했다.

한편, 리처드 소처는 3월 17일 세일즈포스 블로그 포스트를 통해 신뢰할 수 있고 윤리적인 인공지능의 개발 과정 속 사람의 중요성을 강조, 주목 받은 바 있다.

(The danger’s not the algorithm, it’s the human)

나는 인공지능에 의해 인류가 위협받지 않는다고 생각한다. 하지만 우리는 이 기술을 사용함으로써 발생할 수 있는 의도되지 않은 결과들을 생각해봐야 한다.

인공지능은 지각이 없다. AI는 도구이고 도덕적으로 중립이다. 인공지능이 해가 되는건 인공지능이 원인이 아니라 사람이 어떻게 사용하느냐에 달려있다.

AI는 사람의 편향을 증폭할 수 있다.

AI의 알고리즘이 사람의 편향을 가진 데이터셋을 통해 학습을 하게 되면 문제가 된다. 알고리즘이 학습을 거듭할수록 편향의 영향은 더 악화된다.

은행이 AI를 통해 누구에게 대출할지 결정을 하는 경우를 상상해보자. 과거 그 은행이 여자들에게 대출 승인을 한 데이터가 적다면 알고리즘이 남녀 대출 승인을 공평하게 판단하지 않게 된다.

알고리즘의 성능은 학습하는 데이터에 따라 고객들을 대하는 태도가 달라진다. 인공지능은 사람의 편향을 증폭시키거나 연장할 수 있다.

물론, 알고리즘은 미세하게 조정될 수 있다. 하지만 데이터가 중요하다는 사실은 변치 않는다. 인공지능을 학습시킬 시에는 항상 데이터의 검증이 필요하다. 인터넷에서 무작정 데이터를 주입하기 시작하면 인터넷에 있는 편견, 편향, 가짜 사실들을 확대하고 대변하게 될 수 있다.

편향의 위험성을 완화하는 방법

위에서 언급했듯이 알고리즘 자체가 편향을 가지는 게 아니라 데이터가 편향을 만들어낸다. 그러므로 사람들이 할 것은 어떤 데이터를 써야 하는지 무엇을 무시하고 제외할지를 지정하는 것이다.

동시에 기업들은 숨어있는 편향을 찾아내야 한다. '인종'이란 직접적인 데이터가 아니어도 간접적으로 이를 명시할 수 있는 데이터가 포함될 수 있다. 예를 들어 특정 인종이 많이 사는 지역에 거주하는데 사람의 '거주지역' 데이터를 포함한다면 인공지능은 또 다른 편향이 생길 수 있다.

인공지능을 이롭게 하기 위해선 기술을 이해하는 것이 아니라 사람을 이해해야 한다.

AI타임스 장준하 기자 juny6287@aitimes.com