언어마다 문법, 특히 어순이 다르다. 예를 들어 영어로 “I ate an apple”은 한국어로 “나는 사과를 먹었다”이다. 문장 첫 번째 단어인 주어는 순서가 같지만 문장 마지막 단어는 서로 다르다. 이같은 언어간 어순 차이는 실시간 음성 번역에 어려움을 가중시키는 요소다. 이를 구글이 개선했다.

26일 (현지시간) 구글 AI 블로그는 구글 라이브 음성 인식 번역 서비스 업데이트 소식을 전했다. (원문기사)

구글 라이브 음성 인식 번역 초기 버전에서 음성 번역된 문자는 실시간으로 여러 번 수정됐다. 구글은 문장 끝에 있는 단어가 번역된 문장 시작 부분에 있는 단어에 영향을 주었기 때문에 이와 같은 문제가 있었다고 밝혔다. 반복된 수정은 사용자들이 문장을 바로 이해하는 데 어려움을 주었다.

현재 업데이트된 버전에서는 빈번한 수정이 이루어지지 않는다.

구글은 업데이트된 버전을 실현시키기 위해 두 가지 방법을 썼다.

◆ 번역에 맞는 평가 체제 공식화

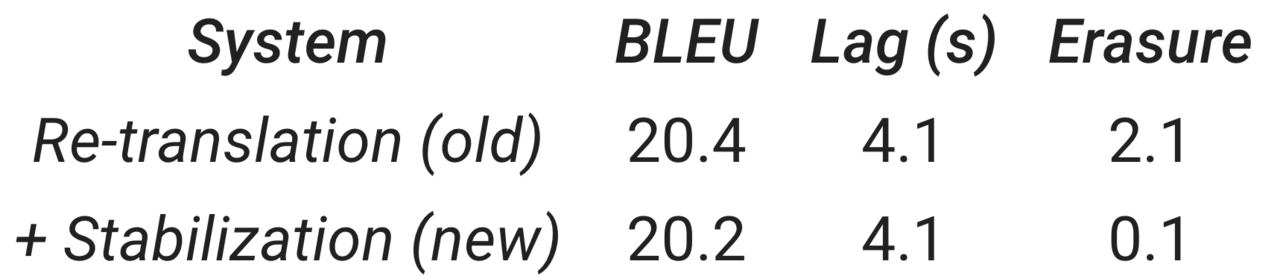

구글은 ▲BLEU(이중 언어 평가ㆍBilingual Evaluation Understudy) 점수 ▲지연(Lag) ▲삭제된 단어 수(Erasure)와 같은 항목을 만들어서 개선점을 찾았다.

BLEU는 최종 번역본의 정확도를 측정하는 점수다.

지연 항목은 음성을 번역하고 여러 번의 수정에 거쳐 최종 번역에 이르기까지의 평균 시간을 측정한다.

삭제된 단어 수는 불안정한 번역 시스템으로 인해 사용자가 추가로 읽어야 하는 단어 수를 측정한다. 최종 번역에 이르기까지 지워지고 대체되는 평균 단어 수.

◆ 재번역 안정화

구글은 스트리밍 번역 (Streaming Translation)모델 STACL와 MILK를 개발했다. 이 모델들은 어문에서 미리 나올 말을 예측하는 학습을 거쳐 더 빠르게 번역을 할 수 있도록 도왔다.

기존 BLEU 점수는 20.4였지만 업데이트된 버전에서는 20.2로 줄었다. 삭제된 단어 수도 평균 2.1에서 0.1로 확연히 줄었다.

한편 구글은 여러 사람이 동시에 말할 때 문자로 번역시켜주는 서비스도 개발 중이다.

AI타임스 배준영 기자 jybae0127@aitmes.com