행동지능이란 로봇이 사람의 마음과 상황 맥락을 이해하고 인간 친화적인 방식으로 행동하도록 만든 인공지능이다.

행동지능은 사람 간의 사회적 교류 행동 모델을 근간으로 사람의 사회적 행동을 이해하고 로봇을 통해 적합한 사회적 행동을 지속적으로 생성하는 과정이다. 외모, 음성, 몸짓 등 외적으로 관찰 가능한 사람의 행동 단서들이 인상, 감정, 의도, 친밀감, 신뢰 등 다양한 사회적 신호를 어떻게 전달하는지 연관성과 인과성을 분석 설계한다. 그 결과를 활용해 사람의 행동 단서들을 자동으로 검출하고 해석하여 사실적, 정성적 측면에서 사회적 맥락을 포괄적으로 이해한다. 행동지능은 사람과 로봇이 상호 협력하며 공존하는 미래 사회에서 로봇이 갖춰야 할 필수 기능이다.

◆기술동향

행동지능의 첫 단계인 포괄적 사회 맥락 인지에서 현재 상황 분류와 사실적 맥락 이해 연구가 활발히 진행 중이다. 정성적 속성과 인과 정보를 이해하는 연구가 선구적으로 이루어지고 있음

사회적 교류 행위 생성은 딥러닝 생성 모델을 기반으로 사람의 행동 패턴을 모사한 발화 제스처와 비언어 교류 행위 생성의 초기 연구가 활발하다. 사회 친화적 행위 계획은 자율 주행과 물체 조작 분야를 중심으로 사람의 움직임과 의도를 반영해 로봇의 의도를 표현하는 연구가 꾸준히 진행되고 있다.

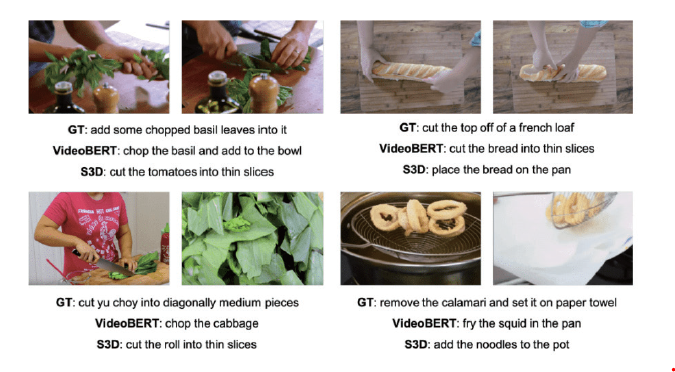

사실적 맥락 인식은 ‘단순 맥락 인식’에서 영상을 보다 상세한 문장으로 묘사하는 ‘영상 캡션 생성’과 영상 속 사물, 사람, 관계를 인지해 정형화된 지식을 생성하는 ‘장면 그래프 (Scene Graph) 생성’으로 발전하고 있다. 각 기술의 성능은 딥러닝을 통해 크게 향상되었지만 아직 실제 문제 해결에 활용할 수 있는 수준에 도달하지 못했다.

구글 리서치는 영상과 음성 텍스트로부터 추출한 특징을 BERT 모델로 결합 학습하는 VideoBERT 모델을 통해 YouCook2 데이터셋을 대상으로 세계 최고 수준의 캡션 생성 정확도를 달성했다.

맥락의 정성적 상태와 사건의 전후 관계 인지는 사람의 감정 상태, 행동의 동기와 결과를 이해하는데 필수적인 기능으로 최근 연구의 필요성이 대두되고 있다. 이에 따라 맥락의 정성적 상태 인식을 위한 다양한 데이터셋이 구축되고 있다.

사회적 교류 행위 표현은 상호 교류를 위한 행동 지능의 핵심 요소지만 행위 목표가 불명확하고 형식이 비정형적이다. 최근 딥러닝 기반 생성 모델의 발전으로 사람의 교류 행위 표현 방식을 학습, 자동 생성이 가능해졌다. 학습 데이터 미비, 생성 결과의 표현력 부족, 교류 맥락 반영 방법의 부재 등 연구 이슈가 여전히 존재.

사회친화적 행위 계획은 로봇이 사람의 상황과 의도를 고려해 사람에게 유리한 방식으로 행동하도록 만든다. 최근 로봇의 안전성 확보와 협동 효율 증진을 목적으로 연구가 활발히 이루지고 있다. 점차인간-로봇 공존을 위한 사회 규범/윤리의 학습과 준수로 범위가 확장되고 있다.

미국 Waymo LLC와 스탠포드대는 역강화학습을 통해 사람의 주행 의도를 예측한다. 사람과의 암묵적ㆍ명시적 교류를 통해 로봇의 주행 의도를 표현함으로써 로봇에 대한 이해도와 신뢰도를 높이고 주행 효율을 개선하는 사회적 주행 기술을 발표했다.

◆시장 동향

1)서비스/소셜 로봇

신종 코로나바이러스 감염증으로 인해 ‘언택트(비대면)’ 기술과 서비스에 대한 요구가 커졌다. 이에 따라 요리, 서빙, 배달, 안내 등 다양한 분야에서 서비스 로봇 도입이 확산되고 있다.

2014년 일본 소프트뱅크 산하 프랑스 개발업체 알데버란에서 감정인식로봇 ‘페퍼’ 개발했다. 인간의 느낌을 인식하고 흉내내며, 다른 페퍼들과 클라우드로 연계하며 새로운 지식과 기능을 습득한다. 한편 일본의 도요타는 2015년 로봇 분야 인공지능 기술개발을 위해 TRI(Toyota Research Institute)를 설립, 노인이나 장애인 보조를 목적으로 하는 가정용 로봇 HSR(Human Support Robot)을 개발해 시험 운영 중.

2017년 미국 MIT에서 내장 카메라를 이용해 가족을 인식, 인공지능을 통해 인간과 대화를 하는 등 페퍼보다 소셜 기능을 강화한 지보(Jibo)를 개발했다. 인간의 성격과 감성을 이해하고 행복, 슬픔, 놀람 등의 감정 표현을 시도한다.

2)협동 로봇

덴마크의 유니버설 로봇은 사람과 로봇이 상호 협업 가능한 유연한 관절 구조와 사람 중심의 UX를 갖춘 제품으로 제조용 협동로봇 시장을 주도 중. 자동차(BMW), 전자(GE), 화장품(P&G) 등 다양한 글로벌 기업들이 가공, 전자 부품 조립, 포장 등에 협동 로봇의 적용을 늘려가고 있다

유니버설 로봇은 고객들이 원하는 다양한 산업 자동화 요구에

부응하는 방대한 글로벌 유통 네트워크를 구축했다.

킴 포블슨 유니버설 로봇 CEO

◆발전전망

사람의 단순 행위 의도를 고려한 행위 계획과 이를 통한 안전성, 편의성 확보에 연구가 집중되어 있고 성과가 나오고 있다. 하지만 복 합적인 사회적 맥락 이해를 근간으로 한 행위계획은 아직 본격적으로 이루어지지 않고 있다. 사람의 복합적인 반응의 진의를 이해하고 그 변화 양상에 대응하면서 행동 정책을 학습하기 위한 연구가 필요한 상황.

단기(2020~2022년)적 목표는 장면 내 사람, 사물의 역할과 관계 자동 검출하며 사실적 상황 맥락을 이해하는 것이다. 다중단서를 기반으로 발화 제스처 생성 기술을 연구한다.

중기(2023~2026년)에는 동영상을 기반으로 행동의 정성적 상태를 인식, 맥락의 변화 양태를 지식 그래프로 생성하는 것이 목표다. 로봇 행동의 의도와 내용을 효과적으로 사람에게 전달하는 가독 가능한(Readable, Legible) 로봇 행위를 계획한다.

장기(2027~2030년)적으로 발화, 표정, 제스처, 자세 등 확장된 모달리티를 포괄하여 유기적으로 행동을 생성, 실행할 수 있도록 한다. 인과성을 기반으로 미래 맥락을 유추하고 사회적 규범, 규칙, 예의 등을 결합 적용한 로봇 행동 정책 학습이 목표다.

◆주요 프로젝트

[해외]

①오픈AI 'Five'

연구시기 : 2017~2019년

②University of Southern California(USC) 'Multi-Agent Path Planning'

연구시기 : 2017~2020년

③Microsoft Research 'Deep Communicating Agents for Natural Language Generation'

연구시기 : 2017년~

④Microsoft Research 'Project Malmo'

연구시기 : 2016~2020년

⑤인텔 'MADRaS : Multi Agent DRiving Simulator'

연구시기 : 2018년~

⑥NSF, USDA, NASA 'NRI(National Robotics Initiative)2.0: Ubiquitous Collaborative Robots)'

연구시기 : 2020년~

⑦DARPA 'OFFSET'

연구시기 : 2017~2020년

⑧DARPA 'CODE'

연구시기 : 2015~2019년

[국내]

①서울대, GIST '조립 대상물의 작업계획이 주어진 상태에서 실환경의 물체를 인식하고 실제 조립을 수행하는 지능 로봇 기술 개발'

연구시기 : 2019년~

②KETI '5G 드론 시스템 및 원격운영시스템 개발'

연구시기 : 2020~2024년

③LG전자 '다수 로봇의 지능을 통합 고도화하는 클라우드 로봇 지능 증강공유 및 프레임워크 기술'

연구시기 : 2020~2023년

④카이스트 '무인이동체 자율 임무계획 기술 개발'

연구시기 : 2020~2027년

⑤카이스트 '군집 임무 계획 알고리즘 개발'

연구시기 : 2019~2024년

"인공지능과 자연지능 연계 집중할 때" AI 기술청사진 연구 총괄 IITP 박상욱 팀장

[특별기획] 인공지능 기술 청사진 2030 연재순서 표

AI타임스 임채린ㆍ정윤아 기자 lynnlim@aitimes.com