미국의 인공지능( AI) 스타트업 갓잇AI가 새로운 유형의 소형 언어 모델을 출시했다. 기존 대형언어모델(LLM)과 비교해 운영 비용을 대폭 줄이면서도 효율은 높인 것이 특징이다.

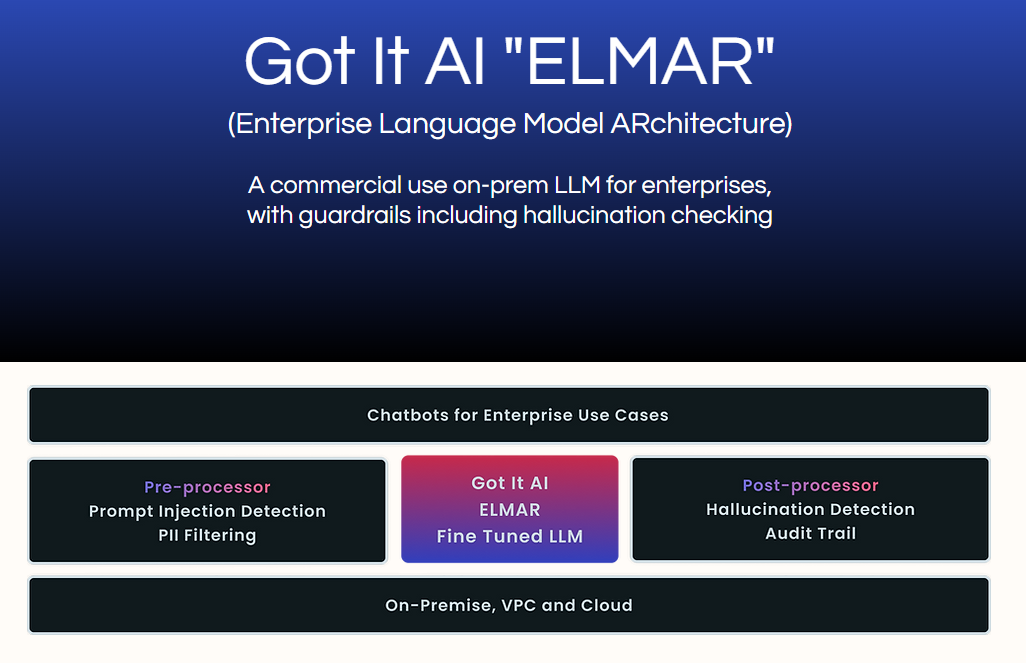

벤처비트는 30일(현지시간) 갓잇AI가 챗봇 애플리케이션에 적용할 수 있는 기업용 소형언어모델 '엘마(ELMAR)'를 출시했다고 보도했다.

갓잇AI는 엘마를 "'GPT-3'보다 눈에 띄게 작으며, 클라우드가 아닌 온프레미스(사내구축형) 형태의 가성비 높은 솔루션"이라고 소개했다.

이런 소규모 LLM은 70억개의 변수를 사용한 메타의 '라마'를 시작으로 최근 속속 출시되고 있다. 스탠포드대학교의 '알파카', 데이터브릭스의 '돌리', 세레브라스의 오픈소스 모델 등이 있다.

오픈AI도 기업용으로 기존 챗GPT보다 10배 저렴한 'GPT-3.5 터보' 모델을 내놓았다.

이번에 갓잇AI가 출시한 제품은 미세조정 과정을 통해 성능을 높일 수 있는 것이 특징이다. 훈련 및 운영 비용은 대형언어모델과는 비교할 수 없을 정도로 저렴하다.

피터 레란 갓잇AI 회장은 "모든 기업이 크고 강력한 모델이 필요한 것은 아니며, 데이터가 외부로 반출되는 것을 원하지 않는 기업이 많다"면서 "엘마는 사내에 구축해 가볍게 실행할 수 있으면서도 미세 조정을 통해 다른 LLM의 성능을 따라잡을 수 있도록 한 모델"이라고 설명했다.

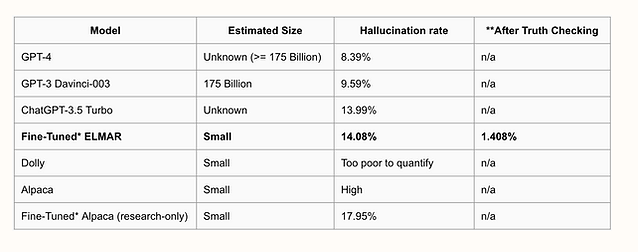

이 회사는 성능이 떨어지지 않는다는 점을 입증하기 위해 100개의 데이터셋에 대한 '환각률(오답률)' 벤치마크 테스트를 진행, 오픈AI의 '챗GPT(GPT-3.5 터보)' 'GPT-3' 'GPT-4'와 돌리, 알파카 등을 비교 평가했다.

테스트 결과 소형언어모델은 미세 조정을 해주지 않으면 특정 작업에서 성능이 크게 떨어졌다.

이에 갓잇AI는 "'진실 체크기'라는 미세 조정 프로세스를 추가해 보완했고, 미세 조정 후에는 GPT-3 터보와 동등한 결과를 얻었다"면서 "공개한 데이터에 따르면 환각률은 14.08%에서 1.408%로, 10분의 1로 줄어들었다"고 밝혔다.

AI타임스 임대준 기자 ydj@aitimes.com