글로벌 인공지능(AI) 스타트업 투플랫폼(대표 프라나브 미스트리)은 ‘책임 있는 AI 원칙’을 제정하고 AI 소셜앱 ‘재피’와 AI 모델 '수트라'에 적용한다고 20일 밝혔다.

투플랫폼이 발표한 책임 있는 AI 원칙은 ▲인간 중심 ▲공정성 ▲책임성 ▲안전성 ▲보안성 ▲지속적인 연구와 개선 등 총 6가지 항목으로 구성됐다.

첫번째 원칙은 인간의 존엄성과 가치를 존중하며 인류에게 이로운 방향으로 AI를 개발 및 활용한다는 것이다. 또 편견이나 차별 없이 공정하게 AI를 사용하며, AI 시스템 개발과 배포 및 사용에 대한 책임을 명확하게 규명한다는 점을 전면에 내세웠다. 더불어 AI 사용에 있어 잠재적 위험을 최소화하고 개인정보 보호 및 데이터 보안을 최우선 하는 것은 물론, 모니터링과 통제 체계 또한 구축해 윤리적인 AI 구현을 연구하고 개선해 나갈 것을 약속했다.

이번에 발표한 원칙을 가이드라인으로 삼아 재피 서비스의 AI 윤리 강화를 위한 체크리스트를 만들어 실무진들의 업무에 적용한다는 방침이다. 또 투플랫폼의 생성 AI모델인 ‘수트라(SUTRA)’에도 책임 있는 AI 원칙이 적용된다. 책임성과 보안성, 안전성 등을 포함한 것은 물론, 기술 이전 및 판매시에도 오용 가능성을 면밀히 검토하도록 규정하고 있다.

투플랫폼은 글로벌 빅테크는 물론 작은 스타트업이라도 AI를 다루는 기업이라면 누구나 그 영향력을 인지하고 윤리적 개발과 사용에 최선을 다해야 한다고 강조했다.

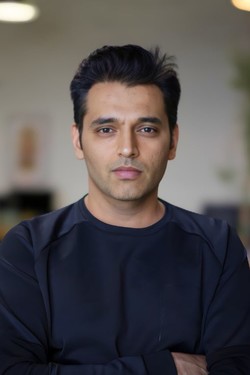

프라나브 미스트리 대표는 “책임 있는 AI 원칙을 기준으로 삼아 AI 기술이 더욱 안전하고 신뢰할 수 있는 방향으로 발전할 수 있도록 할 것”이라며 “투플랫폼은 사용자들에게 더 나은 AI 경험을 제공하기 위해 노력하고 있으며, 앞으로도 지속 가능한 기술 발전을 위해 사회적 의무를 다하겠다”라고 말했다.

박수빈 기자 sbin08@aitimes.com