한국과학기술원(KAIST, 총장 이광형)은 전기및전자공학부 김준모 교수 연구팀이 스스로 이미지 변환을 학습해 높은 시각 정보 이해 능력을 보이는 시각 인공지능 모델 STL(Self-supervised Transformation Learning)을 개발했다고 13일 밝혔다.

STL은 이미지 변환의 종류를 인간이 직접 알려주면서 학습하는 기존 방법론들을 통해 학습한 모델이 이해할 수 없는 세부적인 특징까지도 습득, 기존 방법 대비 최대 42% 우수한 성능을 보여줬다고 전했다.

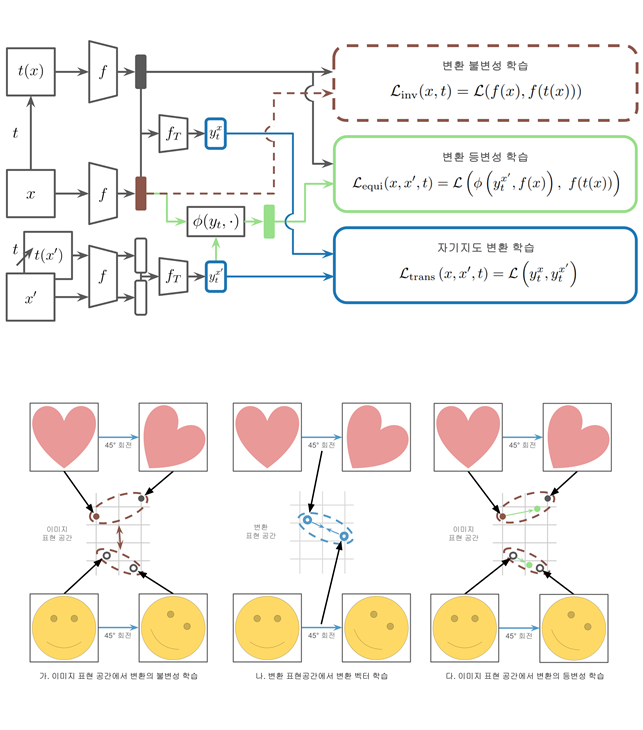

기존 방법들은 이미지 변환(transformations)을 활용해 학습하며, 이를 통해 다양한 시각적 변화를 일반화하고 의미를 유지하는 데 초점을 맞췄다. 그러나 변환에 따른 시각적 세부 사항을 무시하는 경향이 있어 범용 시각 AI 모델로서 한계가 있었다는 지적이다.

연구팀이 제안한 STL은 변환 라벨 없이 변환 정보를 학습할 수 있도록 설계된 새로운 학습 기법이다. 라벨 없이 변환 민감 특징을 학습할 수 있고 기존 학습 방법 대비 학습 복잡도를 유지한 채로 효율적인 최적화할 수 있는 방법을 제안했다.

실험 결과 STL은 정확하게 객체를 분류하고 탐지 실험에서 가장 낮은 오류율을 기록했다. 또 STL이 생성한 표현 공간은 변환의 강도와 유형에 따라 명확히 군집화돼 변환 간 관계를 잘 반영하는 것으로 나타났다는 설명이다.

김준모 교수는 "이번에 개발한 STL은 복잡한 변환 패턴을 학습하고 이를 표현 공간에서 효과적으로 반영하는 능력을 통해 변환 민감 특징 학습의 새로운 가능성을 제시했다”라며 "라벨 없이도 변환 정보를 학습할 수 있는 기술은 다양한 AI 응용 분야에서 핵심적인 역할을 할 것”이라고 말했다.

KAIST 전기및전자공학부 유재명 박사과정이 제1 저자로 참여한 이번 연구는 최고 권위 국제 학술지 ‘신경정보처리시스템학회(NeurIPS) 2024’에서 이달 중 발표될 예정이다.

한편, 이 논문은 2024년도 과학기술정보통신부의 재원으로 정보통신기획평가원(IITP)의 지원을 받아 수행된 연구 성과물이다.

박수빈 기자 sbin08@aitimes.com