구글이 온디바이스 인공지능(AI) 모델에 적용할 개발자용 API를 공개할 예정이다. 이 API를 활용하면, 개발자들은 클라우드 연결 없이도 휴대폰에서 탑재된 온디바이스 모델을 통해 기존에는 클라우드에서만 사용할 수 있었던 기능까지 실행할 수 있게 된다.

구글은 17일(현지시간) 머신러닝 개발 도구인 ML 키트(Kit) SDK에 '제미나이 나노(Gemini Nano)'를 활용한 API 추가 업데이트 문서를 조용히 공개했다.

이를 통해 요약, 문장 수정, 재작성, 이미지 설명 등 기존에는 클라우드 서버를 거쳐야만 가능했던 AI 기능까지 기기 안에서 지원한다.

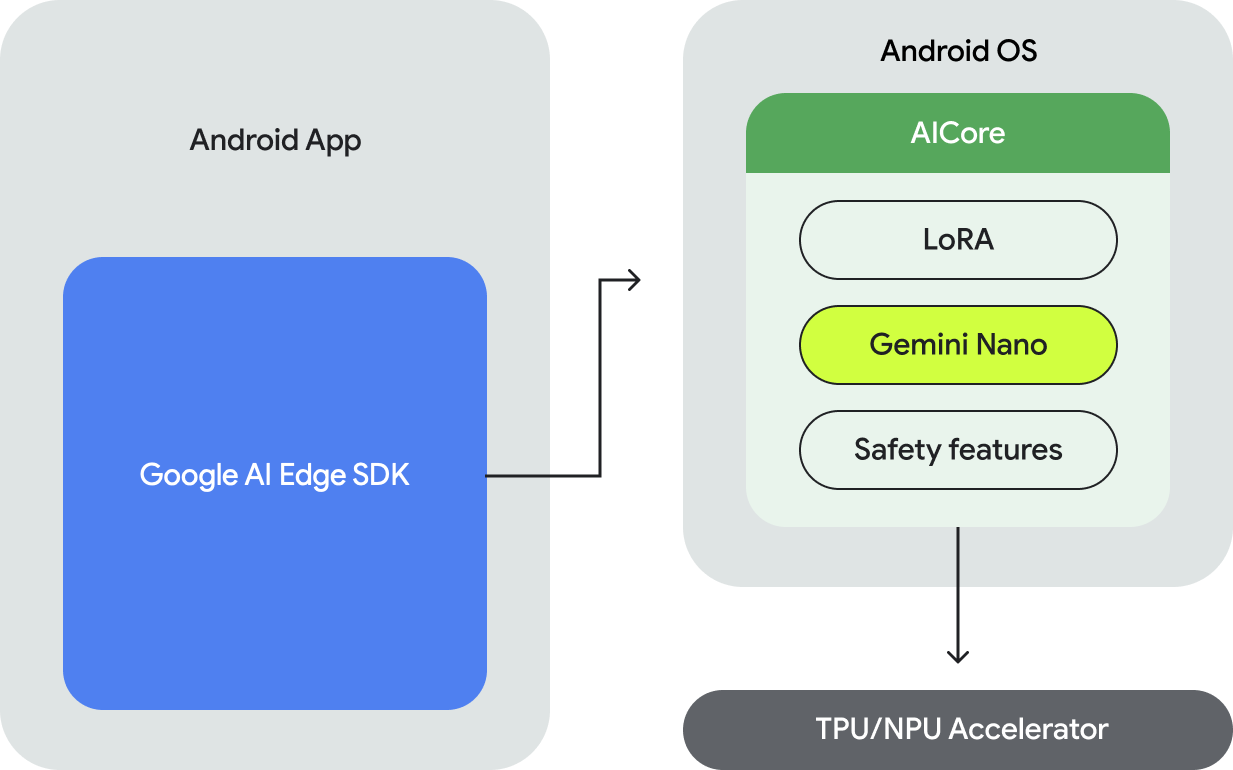

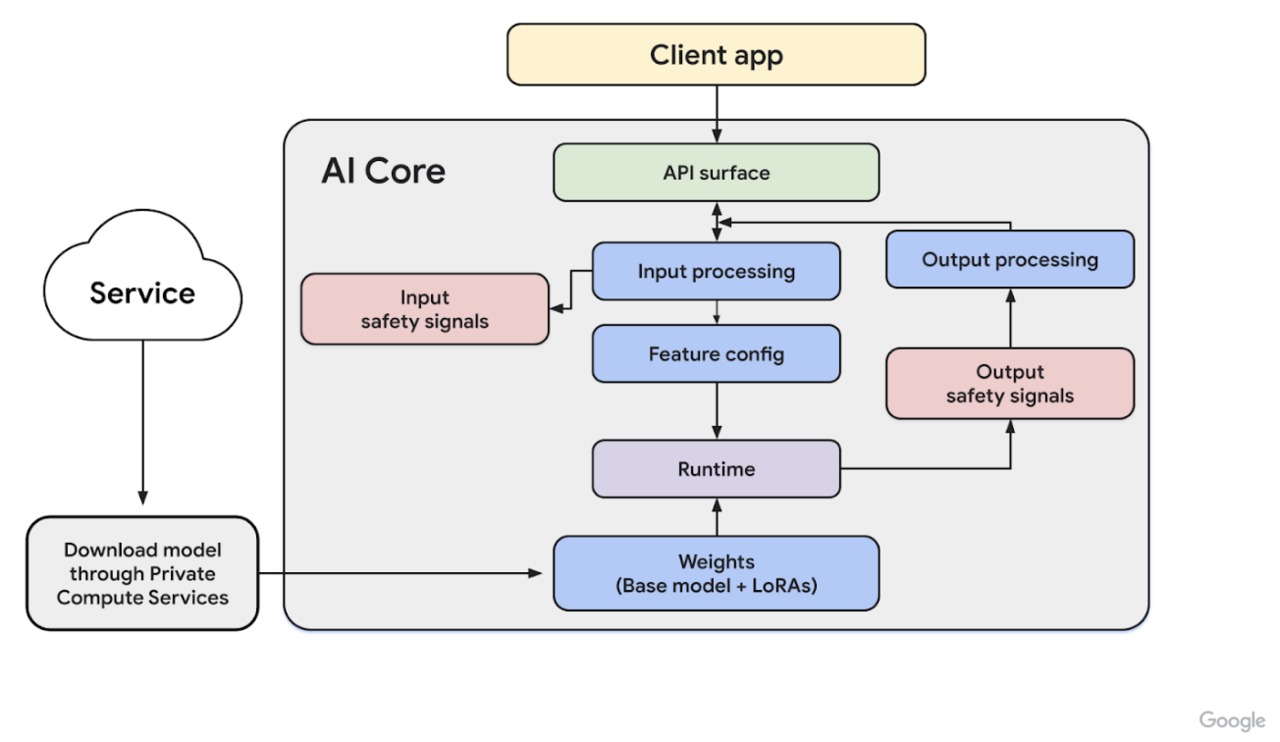

이번 기능은 안드로이드 시스템 서비스인 AI코어(AICore)를 통해 실행되며, 사전에 정의된 기능 세트를 기존 모델에 통합해 개발자들이 쉽게 구현할 수 있도록 설계돼 있다.

AI코어는 하드웨어를 활용해 짧은 지연 시간으로 추론을 수행하며, 안전 필터링과 모델 업데이트도 제공한다. 이로써 사용자의 민감 데이터가 클라우드로 전송되지 않고도 AI 서비스를 이용할 수 있다는 설명이다.

온디바이스 AI의 한계도 존재한다. 제미나이 나노는 클라우드 기반 모델보다 성능이 제한된다. 예를 들어 요약 기능은 최대 세개 항목으로 제한되고, 이미지 설명은 영어로만 지원된다.

또 휴대폰에 탑재된 제미나이 나노의 버전에 따라 결과물의 품질도 달라질 수 있다. 표준 버전인 '제미나이 나노 XS'는 약 100MB 크기이며, '픽셀(Pixel) 9a' 폰에 탑재된 '제미나이 나노 XXS'는 그보다 4배 작고 텍스트 전용에 짧은 컨텍스트만 다룰 수 있다.

이번 API 공개는 구글 픽셀을 넘어 제미나이 나노를 탑재한 전 모델에 적용된다. 삼성전자의 '갤럭시 S25'를 비롯해 해외용으로 설계한 중국 오포의 '원플러스 13'과 '샤오미 15' 등 다양한 안드로이드 기기들이 포함된다.

구글은 이미 개발자회의(I/O)에서 ‘안드로이드에서 제미니 나노: 온디바이스 생성 AI 구축하기(Gemini Nano on Android: Building with on-device gen AI)라는 세션을 예고했다.

여기에서는 새로운 API를 활용한 텍스트 요약, 교정, 재작성, 이미지 설명 기능을 자세히 소개할 예정이다.

이처럼 구글은 안드로이드 운영 체제를 활용하는 모든 하드웨어에 제미나이를 확대 적용한다는 계획을 가지고 있다.

박찬 기자 cpark@aitimes.com