구글 딥마인드가 비전-언어 모델(VLM) ‘팔리젬마 2(PaliGemma 2)’의 미세조정 버전인 ‘팔리젬마 2 믹스(Mix)’를 오픈 소스로 공개했다. 이전 버전인 '팔리젬마 2'보다 세분화된 매개변수 버전으로 구성됐으며 다양한 해상도 지원과 손쉬운 미세조정으로 유연성을 대폭 확장한 것이 특징이다.

구글 딥마이드는 19일(현지시간) 허깅페이스를 통해 다양한 시각 언어 작업에 특화된 VLM ‘팔리젬마 2 믹스’ 모델 제품군을 공개했다.

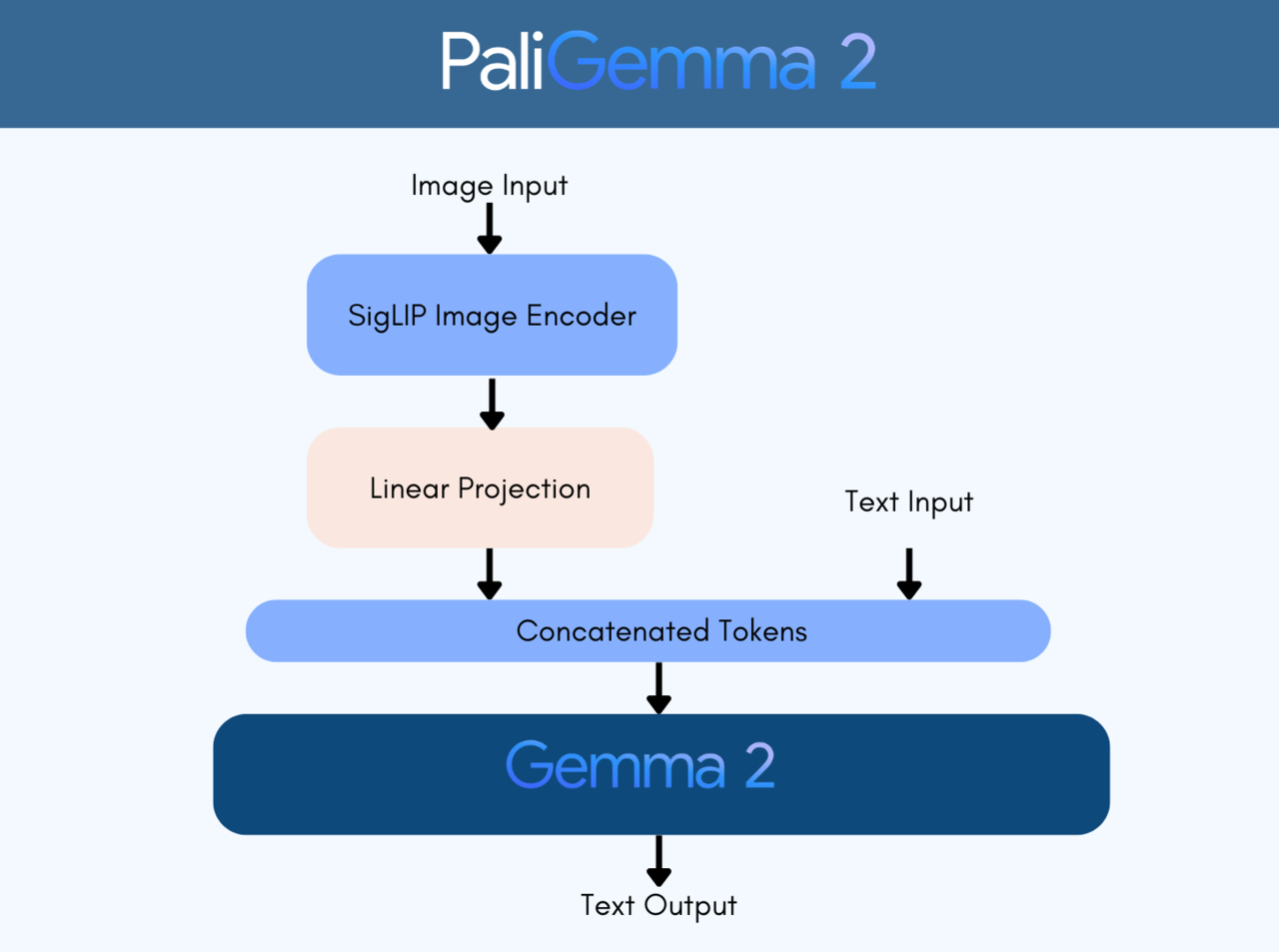

구글은 지난해 12월 텍스트 이해와 객체 감지 및 분할, 이미지 캡션 생성, 시각적 질문 응답(VQA) 등의 기능을 지원하는 오픈 소스 VLM 팔리젬마 2를 공개한 바 있다. ‘시그립(SigLIP)’ 비전 모델과 ‘젬마 2’ 언어 모델을 결합, 정교한 이미지 분석이 가능하며 감정과 동작을 인식하고 장면의 전체적인 맥락을 파악하는 능력을 갖추고 있다.

이 모델은 출시 당시 개발자 사이에서 꽤 인기를 끌었다. 따라서 딥마인드는 기존 버전에서 발생한 피드백을 바탕으로 성능을 향상하고 다양한 활용 사례에 적용할 수 있도록 모델을 세분화했다.

우선, 팔리젬마 2 믹스는 30억, 100억, 280억 매개변수 등 3가지 버전으로 제공되며, 모두 224P와 448P, 896P 해상도를 지원한다. 이전 버전은 30억 매개변수 모델 하나뿐이었다.

또 광학 문자 인식(OCR)과 긴 캡션 및 짧은 캡션 등 다양한 시각 언어 작업에 맞춰 미세조정했다. 이를 통해 다양한 비전-언어 작업에서 쉽게 적용할 수 있으며, 동시에 높은 성능을 발휘할 수 있다는 설명이다.

HF 트랜스포머스 및 JAX 프레임워크를 지원하며, 다양한 하드웨어 환경에 맞춰 bfloat16 및 4비트 양자화(bitsandbytes) 등 여러 정밀도 형식으로 실행할 수 있다.

또 해상도를 자유롭게 조절할 수 있어 작업 특성에 맞는 최적의 성능을 발휘할 수 있다. 예를 들어, 단순한 캡션 생성에는 낮은 해상도를 사용하고, OCR 작업에서 작은 글씨를 인식할 때는 높은 해상도를 활용할 수 있다.

특히 가중치를 공개(Open-weight), 연구자들이 자유롭게 활용할 수 있다. 따라서 제한 없는 변형으로 맞춤형으로 활용할 수 있다.

벤치마크에서도 기존 모델보다 뛰어난 성능을 보였다.

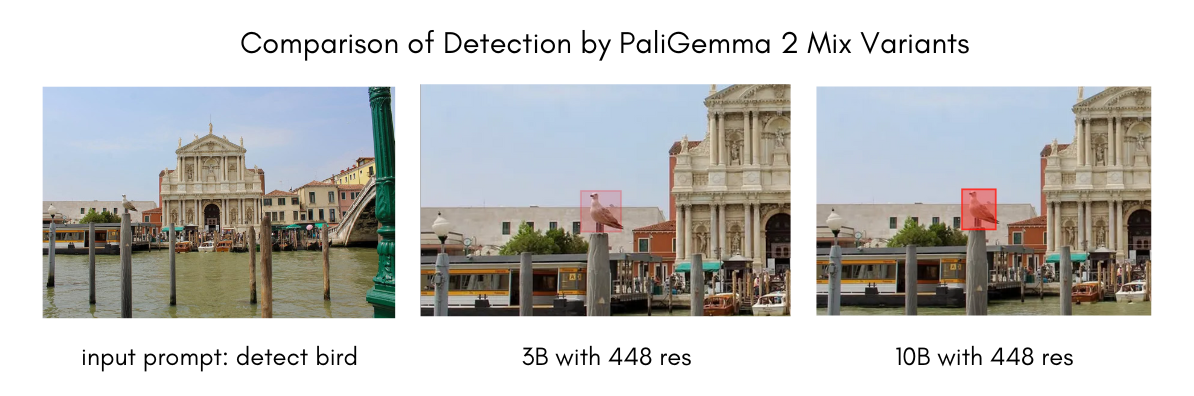

일반적인 비전-언어 작업, 문서 이해, 객체 탐지 및 위치 파악, 텍스트 인식 등 여러 테스트에서 성능 향상이 확인됐다.

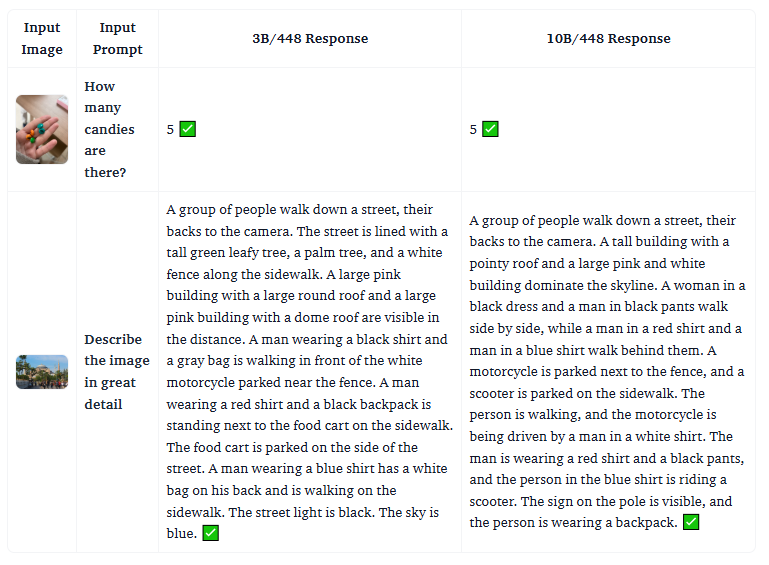

예를 들어, 복잡한 풍경을 설명하는 이미지 캡션 생성 테스트에서 3B 및 10B 모델은 객체와 공간적 관계를 정밀하게 식별, 캡션을 생성했다.

OCR 작업에서도 우수한 결과를 보였다. 특히, 영수증이나 티켓과 같은 복잡한 이미지에서도 날짜, 가격 등의 정보를 정확하게 추출했다. 모델 크기와 입력 해상도가 커질수록 성능도 향상됐다.

연구진은 "첫번째 팔리젬마는 여러 목적으로 커뮤니티에서 널리 채택됐다"라며 "이번 버전은 추가 변형의 유연성이 향상되고 사전 훈련된 품질이 더 좋아졌으므로, 이번에는 커뮤니티가 무엇을 할 수 있을지 기대가 크다"라고 밝혔다.

현재 팔리젬마 2 믹스 모델과 코드는 허깅페이스에서 다운로드할 수 있다.

박찬 기자 cpark@aitimes.com